扩散模型

模型权重、训练代码、数据集完全开源!BLIP3‑o:CLIP + Flow Matching,理解生成一条龙服务

解与生成两项功能在同一框架内统一支持。它采用了基于

CLIP 特征的 Diffusion Trans

被传疯的 AI Agent 实操指南:7步解锁大模型隐藏技能!

《动手做AI Agent》介绍了涵盖GPT-4、LangChain等前沿技术的7个完整项目,帮助读者掌握AI Agent开发技巧,并深入理解其在办公自动化、智能调度、知识整合及检索增强生成领域的应用。

ICML2025|多模态理解与生成最新进展:港科联合SnapResearch发布ThinkDiff,为扩散模型装上大脑

多模态理解与生成新方法ThinkDiff在ICML2025上提出,仅需少量数据和计算资源,让扩散模型具备推理能力,并通过视觉-语言训练和掩码策略传递VLM的多模态推理能力,大幅提高图像生成质量。

一张图,穿梭任何场景!AniCrafter开源登场,让角色动画真正做到“无缝生成”

AniCrafter 通过引入3DGS Avatar + 背景视频作为条件控制视频扩散模型,实现任意角色在任意场景下的动画化任务。项目和代码链接已提供。

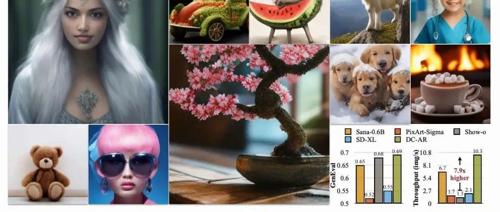

ImageNet FID 从14干掉到4!ARFlow:自回归嵌入流式图像生成,混合线性注意力破解长程依赖难题

模引入流模型,借助“因果有序噪声序列”与“chunk‑wise 混合线性注意力”,在ImageNet

再看文档古籍修复前沿方案:定位、预测、图像重建三阶段融合思路

2025年7月11日,北京晴。文章介绍了文档智能在历史文献修复中的应用,包括数据合成和三阶段模型(OCR辅助的损坏定位、损坏内容预测、历史外观恢复)。AutoHDR-Qwen2-1.5B等开源项目展示了这种方法的效果。

ICCV 2025 腾讯优图实验室8篇论文入选,涵盖风格化人脸识别、AI生成图像检测、多模态大语言模型等方向

结果公布,腾讯优图实验室共有8篇论文入选,涵盖风格化人脸识别、AI生成图像检测、多模态大语言模型等前