学术

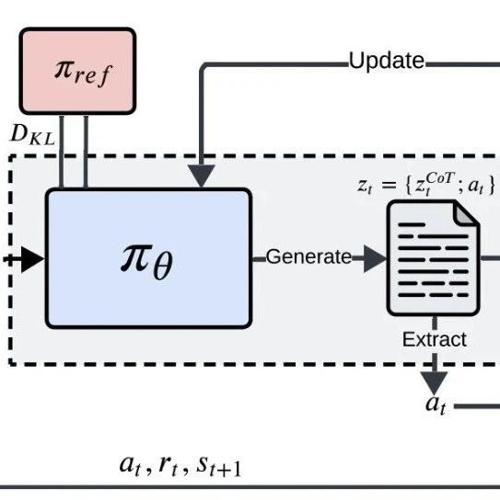

谷歌发现LLM是Greedy Agent,提出用RL调教出理性决策

MLNLP社区是国内外知名的机器学习与自然语言处理社区,旨在促进学术界、产业界和爱好者的交流与进步。最新论文揭示了大模型决策中的三大缺陷,并通过强化学习微调结合思维链技术提升其决策能力。

Synthetic-Data-Zero-RL:让 RL 左脚踩右脚

MLNLP社区致力于促进自然语言处理领域的学术与产业交流合作。通过PromptCoT等方法生成高质量数据集,提高模型性能。近期实验表明基于PromptCoT合成的数据可用于零样本强化学习训练,提升效果接近官方预训练模型。

我国仅有4所“纯211”,被称为“984.5”大学,综合实力强悍,超越寻常985!

MLNLP社区介绍其愿景是促进国内外NLP学术、产业界的交流与进步,重点关注初学者成长。文章提及了四所211工程高校:南京理工大学、上海财经大学、西安电子科技大学和北京邮电大学,详细描述了它们的优势学科及学生就业前景。最后邀请关注者加入MLNLP社区技术交流群。

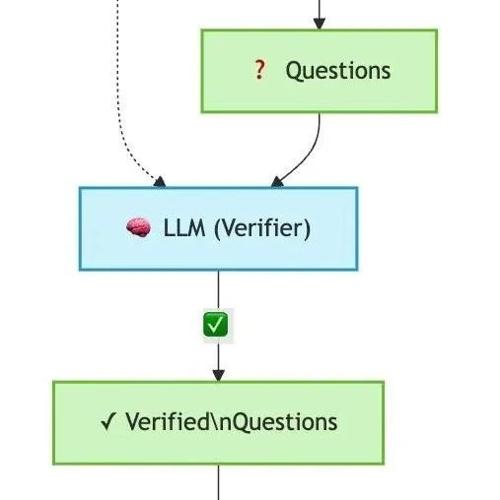

经验分享!从0开始做一篇Benchmark

MLNLP社区致力于推动自然语言处理领域的学术交流与进步,涵盖硕博生、高校老师及企业研究人员等多个群体。文章详细介绍了如何构建高质量的Benchmark,包括数据准备、清洗、审核、模型评估等步骤及其重要性。

第五届中国情感计算大会邀您共襄盛举

第五届中国情感计算大会(CCAC 2025)将于7月18-20日在四川成都举办,邀请多位知名学者作特邀报告,并汇聚青年才俊展示最新成果与动态。会议涵盖特邀报告、前沿趋势论坛等多环节,同时提供学生研讨会和闭幕式等活动。

李开复加入福建福耀科技大学

MLNLP社区致力于促进国内外机器学习与自然语言处理的交流合作。福建福耀科技大学聘请李开复博士为理事会理事,助力‘高等教育+AI’创新教育模式。李开复分享了AI在教育领域的应用,并期望培养具备创新能力和全球视野的人才。

CVPR 2025 CV 微调卷出天际,Mona:我小、我强、我省资源

本文提出了一种名为Mona的方法,通过引入多认知视觉滤波器和优化输入分布,在调整少于5%的骨干网络参数的情况下,显著提升了视觉识别任务的效果。

被Transformer光芒掩盖的论文,Meta科学家回顾十年前创新之作

这篇论文是2015年发布的《End-to-End Memory Networks》,它包含了当前大型语言模型的许多要素,如完全用注意力机制替代RNN、引入带键值投影的点积软注意力机制和堆叠多层注意力等。尽管其影响力不及后来的《Attention is all you need》