量子位

量子位

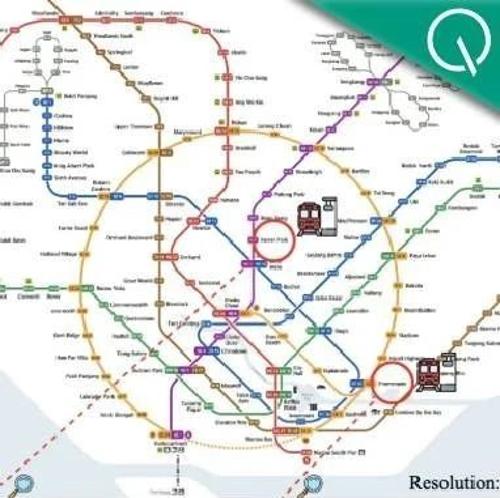

多模态模型挑战北京杭州地铁图!o3成绩显著,但跟人类有差距

近年来多模态大模型在理解和复杂推理任务中取得进展,但其对高分辨率图像(如地铁图)的理解能力仍存争议。为此,西湖大学、新加坡国立大学等团队提出ReasonMap评测基准,聚焦于高分辨率交通图的多模态推理,发现当前开源模型存在性能瓶颈,并指出强化学习后训练模型在某些维度上优于现有模型。

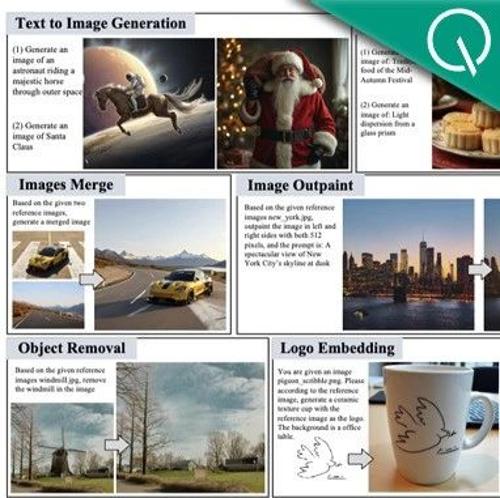

生图效果媲美GPT-4o,一键搞定各类视觉生成任务丨港科广&字节全新框架

港科大(广州)和字节联合出品的开源框架ComfyMind,能够根据一句描述生成高质量图像或视频。它结合树状规划与局部反馈执行机制,性能超越现有开源方法并接近闭源GPT-4o-Image。

马斯克祸不单行!擎天柱负责人突然离职,特斯拉蒸发万亿市值

特斯拉员工Milan Kovac因个人原因离职,Optimus项目负责人职务暂由Ashok Elluswamy接任。马斯克和特斯拉面临新挑战,近期股价波动加剧了公司的经营压力。

金融大模型升级决策平台!马上消费发布“天镜”3.0破解经验碎片化难题

马上消费常务副总经理蒋宁在2025消费金融生态大会上发布升级后的金融大模型“天镜”3.0,强调其从个体智慧到群体智慧的系统性突破。该模型覆盖了智能营销交互、数据决策支持等八大应用场景,并具备协同进化能力。

多模态推理新基准!最强Gemini 2.5 Pro仅得60分,复旦港中文上海AILab等出品

复旦大学及香港中文大学MMLab联合上海人工智能实验室等多家单位提出了MME-Reasoning,全面评估多模态大模型的推理能力。该基准分为三类推理:演绎、归纳和溯因,并涵盖三种问题类型。评测结果显示当前最优模型得分仅60%左右,显示了对逻辑推理能力的要求极高。

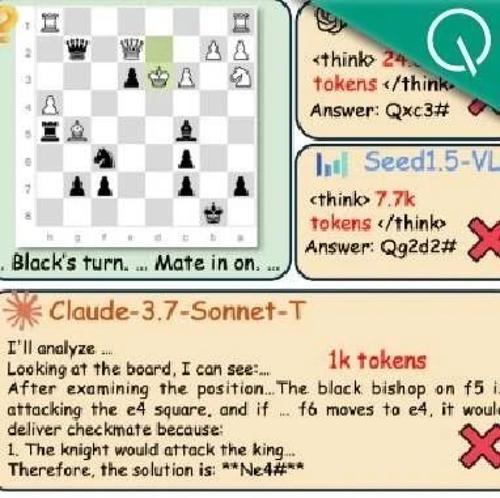

首个多模态专用慢思考框架!超GPT-o1近7个百分点,强化学习教会VLM「三思而后行」

研究团队提出VL-Rethinker模型,通过优势样本回放和强制反思技术解决多模态推理中的优势消失和反思惰性问题。该模型在多个数学和科学任务上超过GPT-o1,并显著提升Qwen2.5-VL-72B在MathVista和MathVerse上的性能。

AI文本转语音进入“Next Level”!独角兽ElevenLabs发布Eleven v3:狠狠拿捏情感控制

ElevenLabs发布的新版TTS模型Eleven v3支持70多种语言,还能进行多人对话聊天。它通过引入音频标签控制情绪表达,并且已进入内部测试阶段。