机器学习算法与自然语言处理

机器学习算法与自然语言处理

早鸟票倒计时1天NLPCC2025和第十届语言与智能高峰论坛注册开启

MLNLP社区是国内外知名的机器学习与自然语言处理社区,其愿景是促进学术界、产业界和爱好者之间的交流和进步。2025年8月的NLPCC会议即将举行,社区提供多种注册选项并邀请多位知名学者担任特邀报告人。

梁科@国防科技大学、周思航@国防科技大学共同担任MLNLP第三十三次学术研讨会主席

MLNLP社区举办第三十三次学术研讨会,会议将于2025年7月27日举行,大会主席是国防科技大学计算机学院教授刘新旺。该研讨会由国防科技大学计算机学院梁科老师和国防科技大学智能科学学院周思航研究员担任程序委员会主席。

ICML2025|多模态理解与生成最新进展:港科联合SnapResearch发布ThinkDiff,为扩散模型装上大脑

多模态理解与生成新方法ThinkDiff在ICML2025上提出,仅需少量数据和计算资源,让扩散模型具备推理能力,并通过视觉-语言训练和掩码策略传递VLM的多模态推理能力,大幅提高图像生成质量。

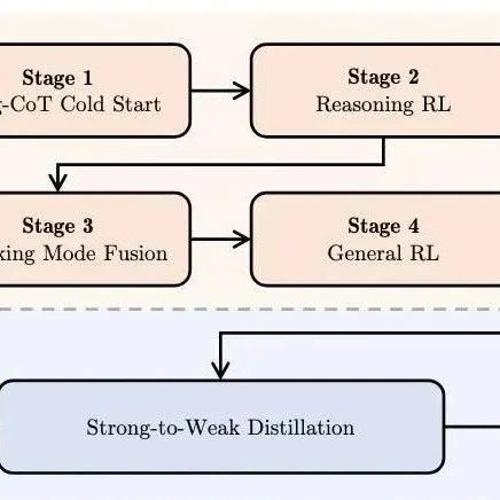

快慢Reasoning综述!

MLNLP社区致力于促进国内外NLP学术与产业发展间的交流合作。文章介绍了一种双层效率优化框架,包括可控计算(L1)和自适应计算(L2),通过大量实验揭示了语言模型在复杂推理任务中的低效性问题,并提出了一系列解决方案以提升其效能。