Qwen

DeepSeek团队新作:把代码变成思维链,大模型推理各种能力全面提升!

DeepSeek团队通过CODEI/O项目,利用300多万个实例将代码转换为思考过程训练大模型,提升其在多种推理任务中的性能,并证明了这种训练方法对不同规模和领域模型的有效性。

组团开源,Qwen2.5-VL转角遇见DeepSeek Janus-Pro!

今天除夕,阿里千问开源了Qwen2.5-VL模型,包含3B、7B和72B三个尺寸,并具有感知丰富世界、作为视觉Agent、理解长视频和捕捉事件、精准的视觉定位及结构化输出等新特性。

Qwen开源首个长文本新模型,百万Tokens处理性能超GPT-4o-mini

阿里云Qwen模型首次将上下文扩展至1M长度,实现了长文本任务的稳定超越GPT-4o-mini,并提升了推理速度7倍。该模型分为长上下文训练、长度外推和稀疏注意力机制三大步骤。

阿里Qwen2.5-1M开源,仅320G可推理14B百万token

阿里千问开源了Qwen 2.5-1M模型及其对应的推理框架,支持百万Token上下文处理,并分享了训练和推理框架的设计细节及消融实验结果。

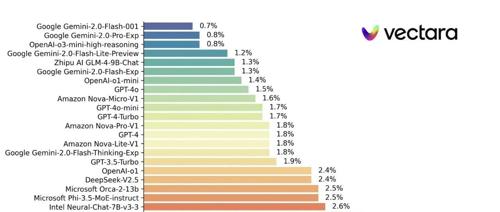

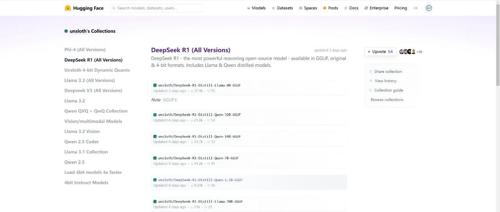

DeepSeek R1 – 最强大的开源推理模型:包含经过蒸馏优化的 Llama 和 Qwen 模型

DeepSeek R1开源模型发布,包括Llama和Qwen蒸馏版本,支持GGUF格式和4位量化,7B模型压缩至4.68G。