学术

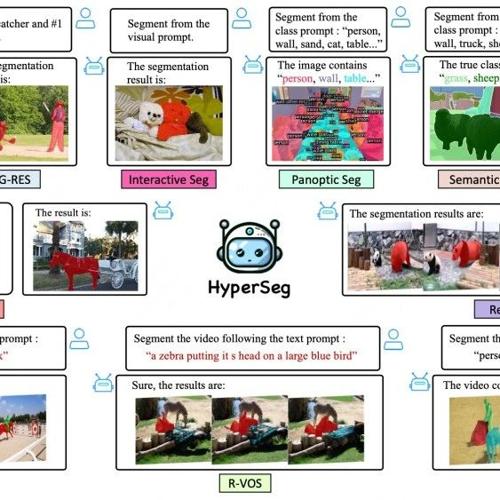

大模型助力分割,刷新10项SOTA!清华和美团提出HyperSeg:通用分割框架

首个基于视觉大语言模型(VLLM)的通用分割模型HyperSeg,能够处理像素级图像和视频感知任务,并具备复杂的推理和对话能力。在多个分割任务中刷新了10项SOTA,展现了卓越性能。

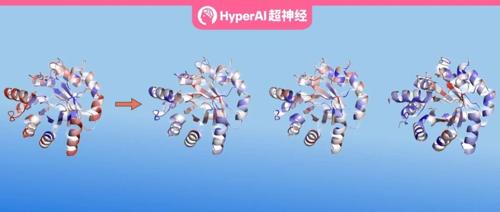

分享NeurIPS 2024投稿经验!浙大团队用DePLM模型助力蛋白质优化,论文一作在线展示demo

作者:王泽元

编辑:十九

转载请联系本公众号获得授权,并标明来源

Meet AI4S 第五期邀请到了

GPT-4其实根本听不懂声音?港中文、斯坦福等联合打造视觉听觉评估新基准

多模态大模型在听觉任务上表现不佳,甚至无法正确分辨明显不同的声音大小。研究团队提出了DeafTest和AV-Odyssey基准测试,揭示了现有模型在音频感知上的短板,并激发了对未来AI模型的改进方向。