量子位

量子位

Agent创业来了位13岁的CEO

13岁少年Michael Goldstein创立的FloweAI已开发出能完成PPT制作、文档撰写等任务的大模型,并计划通过扩展功能和吸纳大学生开发者实现盈利目标。

大模型“拼好题”,45K数据撬动18%提升,数学问题拒绝死记硬背 MathFusion

MathFusion团队提出了一种新的方法,通过指令融合增强大语言模型解决数学问题的能力。仅使用45K的合成指令,在多个基准测试中平均准确率提升了18.0个百分点。MathFusion通过顺序、并列和条件三种融合策略将不同数学问题巧妙结合生成新问题,显著提升模型性能与数据效率,并在in-domain和out-of-domain基准测试中均表现出优越表现。

不用千亿参数也能合成高质量数据!这个开源框架让小模型“组团逆袭”,7B性能直追72B

上海人工智能实验室与中国人民大学提出GRA框架,通过多人协作机制让小模型协同生成高质量训练数据,其生成的数据质量媲美甚至优于单个大型语言模型。

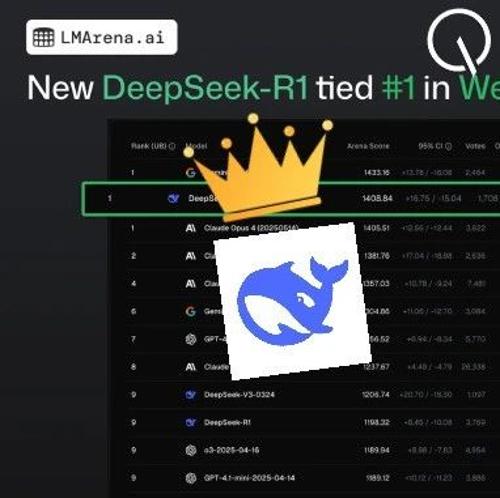

网页编程众测排名:DeepSeek-R1超越Claude 4加冕全球第一

DeepSeek新版R1-0528在编程能力测试中表现突出,能在网页编程上击败Claude Opus 4。实测显示其能快速生成太阳系动画、AGI主题网站及俄罗斯方块游戏代码,并且对国内用户更为友好。

Kimi新模型拿下代码开源SOTA,仅仅72B,发布即开源

Kimi发布开源代码模型Kimi-Dev,在SWE-bench Verified上取得60.4%成绩,参数量只有72B。该模型采用BugFixer和TestWriter两种角色的结合进行训练,目前权重和代码均已发布。

性能比肩DeepSeek-R1,MiniMax仅花380万训出推理大模型性价比新王|开源

国产推理大模型MiniMax-M1开源,支持高达10万token生成。其混合注意力架构和CISPO算法提升了训练效率,并在多个基准测试中表现优异。

细粒度视觉推理链引入数学领域,准确率暴涨32%,港中文MMLab打破多模态数学推理瓶颈

香港中文大学MMLab团队发布视觉推理方案MINT-CoT,专为解决数学视觉推理难题设计。该方法通过引入Interleave Token实现细粒度、轻量级的视觉交错CoT推理,显著提升多模态大模型在数学视觉推理任务中的表现。