CVPR

何恺明CVPR最新讲座PPT上线:走向端到端生成建模

何恺明在CVPR会议上分享了关于识别模型演进与生成模型未来方向的见解,他提出了一种名为MeanFlow的新方法用于实现单步生成任务,并介绍了多种研究方向和问题。

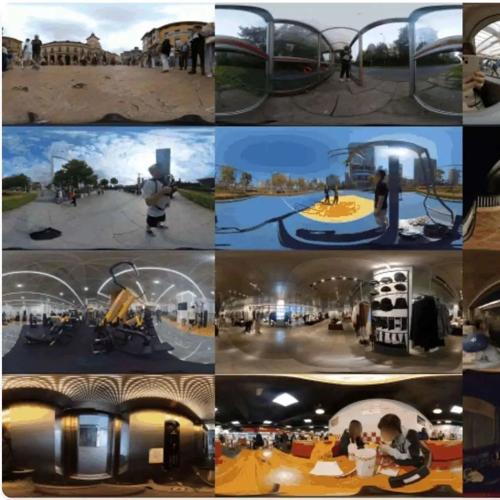

ICCV 2025|BinEgo‑360:融合全景与双目第一视角的多模态场景理解workshop及挑战赛现已启动

BinEgo-360Workshop及挑战赛旨在探索融合全景与双目第一视角下的多模态视频理解任务,大赛包括两个赛道:复杂场景理解和时序动作定位。参赛者需基于360+x数据集完成相关任务,涵盖视觉、空间音频等多种模态信息。

从视频生成到世界模型:CVPR 2025 重磅教程来了!

本文介绍了一次视频生成的教程,探讨了其作为世界模型的强大潜力,涵盖学术界和产业界的顶尖研究者分享,涉及生成建模、3D理解、强化学习与物理推理等方向。

ICML 2025 全局池化+局部保留,CCA-Attention为LLM长文本建模带来突破性进展

的高效上下文建模。在 128K 超长序列上下文建模任务中,CCA-Attention 的推理速度是标

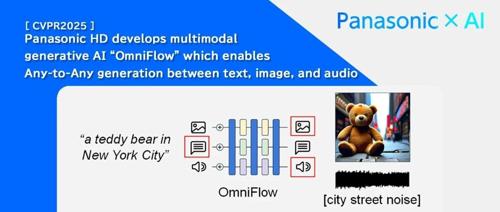

松下HD开发多模态生成式AI“OmniFlow”,可实现文本、图像和音频之间的任意生成

松下研发的OmniFlow多模态生成式AI技术能够自由转换文本、图像及音频等多种数据格式,即使少量包含所有三种模态的数据也能学习高精度模型,显著降低创建训练数据的成本。

全日程公布|谷歌Veo 3惊艳发布后,这场CVPR分享会值得每个AI人「听个声」

CVPR 2025 论文分享会将在北京举办,主题包括多模态和视频生成。邀请顶级专家、论文作者参加Keynote演讲和圆桌对话,同时发布部分论文的摘要。