量子位

Qwen新开源,把AI生图里的文字SOTA拉爆了

通义模型家族开源Qwen-Image,一个200亿参数的图像生成基础模型。主打复杂文本渲染能力,能准确生成图文混合布局、海报等高质量图像,并在多项公开基准测试中表现出色。

Qwen3小升级即SOTA,开源大模型王座快变中国内部赛了

Qwen官方发布了235B参数量的新模型Qwen3,相比Kimi K2提升了基准测试性能,并且不再使用混合思维模式。新模型支持非思考模式,已可以上线网页版使用。

大模型自信心崩塌!谷歌DeepMind证实:反对意见让GPT-4o轻易放弃正确答案

研究发现,大语言模型如GPT-4o和Gemma 3在面对反向意见时过度敏感,并且会轻易改变初始答案,这与其记忆机制有关。研究表明,缺乏记忆的模型可能更容易动摇。

苹果向英伟达生态妥协了!MLX框架主动适配CUDA

苹果为MLX框架增加对CUDA的支持,以利用英伟达GPU训练模型。此举标志着苹果正式向英伟达生态妥协,尽管此前因禁用部分MacBook的英伟达显卡而与英伟达产生过矛盾。

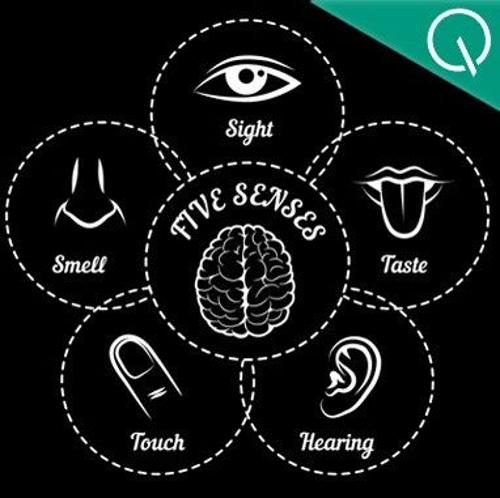

AI有味觉了:分辨可乐和咖啡,只需“尝一尝”丨Nature

近日,科学家研发出一种基于石墨烯的人工味觉系统,能准确分辨酸、甜、苦、咸及可乐和咖啡等味道,相关研究已发表于《美国国家科学院院刊》(PNAS)。该系统采用氧化石墨烯作为传感器材料,具有优异的电导性与分子敏感度。