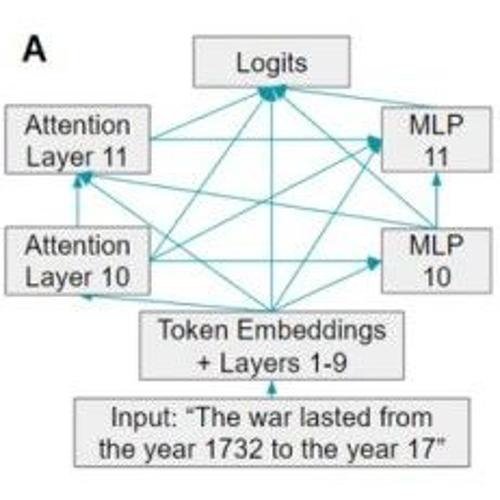

Transformer

神经网络理论与技术学习以及工具

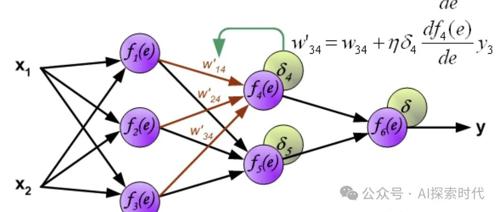

文章介绍了神经网络模型的学习方法,包括数学计算工具(如PyTorch和TensorFlow)以及神经网络模型结构。强调了理论基础的重要性,并提到了训练过程中的损失计算、反向传播等步骤。学习建议是从案例开始实现自己的神经网络模型,理解其工作机制再深入实践。

关于神经网络的一些思考与感受

文章讲述了神经网络模型的重要性以及设计不同类型模型来解决不同问题的必要性。文章还提到了训练数据的质量和使用TensorFlow或PyTorch框架的技术实现,强调了实践对于理解神经网络运作机制的重要性。

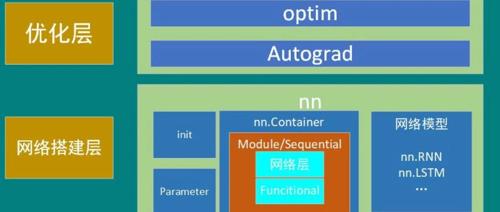

神经网络技术栈介绍——PyTorch,Transformer,NLP,CV,Embedding

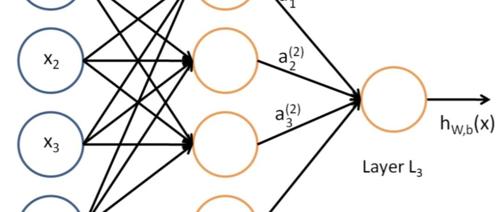

文章介绍了神经网络的基本概念及其在不同任务领域中的应用,包括RNN、CNN和Transformer等模型。指出PyTorch和TensorFlow是实现这些思想的具体工具,并强调了神经网络与自然语言处理(NLP)和计算机视觉(CV)任务结合的重要性。同时提醒学习者不要过分依赖神经网络技术来解决NLP和CV的问题。

激进架构,400万上下文,彻底开源:MiniMax-01有点“Transformer时刻”的味道了

作者

|

王兆洋

邮箱

|

wangzhaoyang

@pingwest.com

“MoE”加上“前

怎么学习设计和训练一个大模型——也就是神经网络?

设计大模型需要先从技术点切入。建议初学者选择合适的工具(如PyTorch框架)和理论(如Transformer架构),专注于学习一种技术方向,并逐步理解其核心思想。