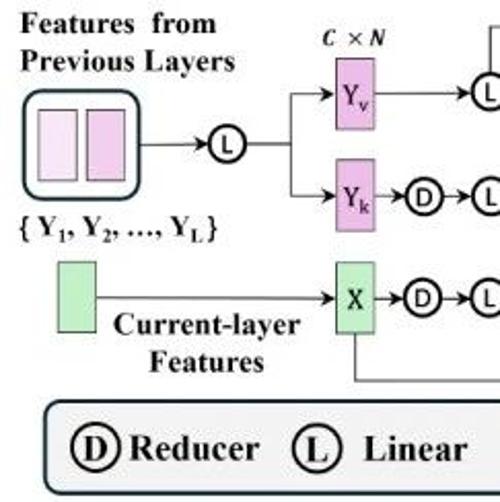

AAAI’25 SparX: 用于强化Vision Mamba&Transformer Backbone的稀疏跳跃连接机制!

arX稀疏跨层连接机制,通过交替堆叠高复杂度“神经节层”与轻量“常规层”并限制跨层窗口,显著增强Vi

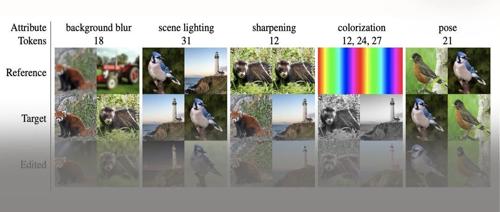

ICML 2025 何恺明团队提出:高度压缩的Tokenizer可直接用于图像生成

本文提出仅用32个一维离散 token 的高度压缩 TiTok tokenizer,无需训练额外生成模型,通过测试时梯度优化即可完成图像生成、编辑和修复任务。发现极致压缩提高了生成质量,挑战了传统“先压缩后生成”范式。

通义千问深夜更新!Qwen3升级版迈向“分离训练”时代,性能全面超越Kimi-K2,Agent能力亮眼

新版本模型Qwen3-235B-A22B-Instruct-2507-FP8在多项核心能力上实现飞跃,超越Kimi-K2等顶级开源和闭源模型。通义千问团队宣布告别混合思维模式,迈向分离训练时代,并留下大招悬念,暗示复杂推理的Thinking模型可能也在路上。

技术狂热过后,人形机器人下半场开拼:谁的订单先落地?

大摩认为人形机器人行业已从技术狂热转向关注实际商业落地。2025年下半年订单获取和应用将成驱动市场情绪的关键因素,多数集成商设定了2025年数百至数千台的交付目标。

Universal Audio 宣布对其免费 DAW Luna 进行了更新,引入了多项 AI 驱动的辅助功能

Universal Audio 的 LUNA 1.9 引入多项 AI 功能,包括语音控制、乐器检测、节奏监听和提取等,大幅提升音乐制作效率和自然感。

WAIC Vibe场域|当 AI 撞上青春主场:WAIC 2025 的 N 种打开方式,年轻人说了算!

-29日

地点:世博中心、世博展览馆、徐汇西岸等

硅星人今年的展位在世博展览馆 H3-E819

接