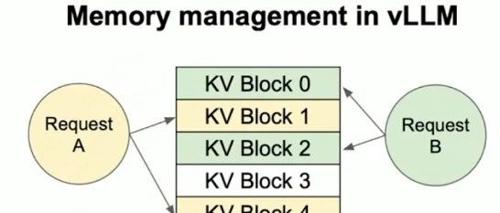

KV Cache

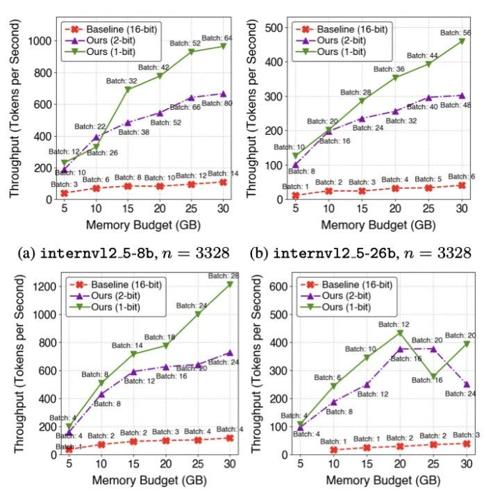

1比特KV量化,10倍吞吐提升无损性能:多模态适用的KV cache量化策略来了,即插即用无需改原模型

读

在InternVL-2.5上实现10倍吞吐量提升,模型性能几乎无损失。

>>

加入极市CV技术交

10倍吞吐提升无损性能:多模态适用的KV cache量化策略来了,即插即用无需改原模型

CalibQuant团队在InternVL-2.5模型上提出了一种1比特量化方法,通过校准策略缓解了低比特数量化带来的失真问题。实验结果显示,在多种任务和内存限制下,该方法相比基线有显著的性能提升。

焱融YRCloudFile发布面向AI推理的分布式KV Cache特性

专注于AIGC领域的专业社区报道了焱融科技YRCloudFile支持大模型推理场景的KVCache特性,显著提升推理性能和效率。