月度归档: 2025 年 5 月

火遍全网的AI在线生成前端页面DeepSite开源替代LocalSite

LocalSite AI 现已支持思维模型。一款现代化网页应用,利用AI生成HTML、CSS和JavaScript代码。支持多供应商API,包括Ollama本地模型。

重磅!微软宣布开源Copilot!用 5000 万用户直接碾压 Cursor和Windsurf?

微软宣布GitHub Copilot扩展项目开源,并采用MIT许可证。此举使开发者能够免费访问AI编程助手的完整源代码并参与功能改进。微软指出大模型能力提升、通用UI组件统一设计和成熟开源生态是开源的几个理由。Copilot代理现在可以自动完成修复bug、添加功能等任务,提升了开发效率。

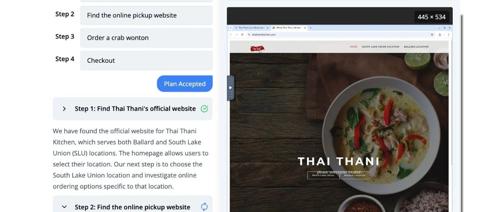

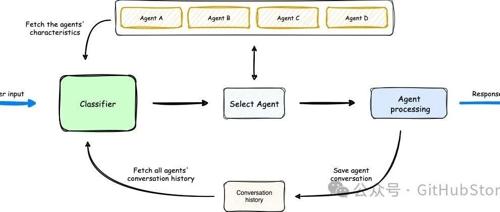

微软开源Magentic-UI协同解决复杂的Web任务,利用大型语言模型,自动生成学术论文的独立评审

Magentic-UI通过多智能体协作解决复杂Web任务;NLWeb简化网站对话式界面构建和自然语言交互;TypeAgent展示利用LLM构建个人代理架构的方法;AI Peer Review辅助学术论文同行评审生成元评审报告;AI看线提供基于历史数据的量化分析与走势预测工具。

鸿蒙折叠 PC 亮相:华为正式发布 MateBook Fold 非凡大师

华为在成都发布鸿蒙 PC 家族新成员——华为 MateBook Fold 非凡大师。这款笔记本采用折叠屏设计,有多种使用形态,售价23999-26999元。它不仅填补国产桌面操作系统的空白,还打破了 Windows 和 macOS 的主导局面,推动“三足鼎立”新格局的形成。