学术

AI生成视频总不符合物理规律?匹兹堡大学团队新作PhyT2V:不重训练模型也能让物理真实度狂飙2.3倍!

团队完成。第一作者为匹兹堡大学的一年级博士生薛琪耀。

当前文本生成视频(T2V)技术正在从注重视觉质

Index-AniSora:B站开源动画生成模型,斩获多项SOTA入选IJCAI25

B 站开源动画视频生成模型 Index-AniSora,支持多种二次元风格视频生成。该工作包括高质量数据集、统一扩散生成框架和评估基准等技术方案。

博士第六年,还没有毕业?

写论文之初最难的是找到一个不错的idea。本文推荐了咕泡科技的一站式科研辅导服务,包括顶会Best Paper提名得主、Top50人工智能重点实验室等多位专家提供选题分析、实验设计、数据支撑等全流程辅导。

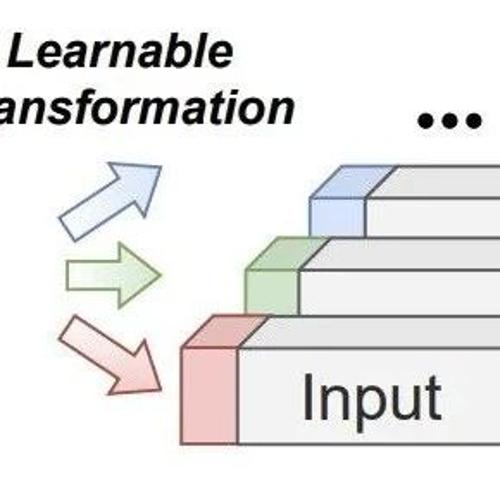

Qwen突破:用「并行计算」代替「堆参数」,新方法内存降22倍、延迟降6倍

MLNLP社区发布论文《Parallel Scaling Law for Language Models》提出ParScale技术,让模型在保持参数不变的情况下通过并行计算提升性能,推理效率提升22倍,实现高效省资源扩展。