AIGC开放社区

AIGC开放社区

面向营销人员的8大国外AI Agent

AI营销智能体能革新内容创作、推广及客户互动方式。介绍八款国外营销智能体功能和优势,包括StoryChief William、Kaya、Opencord AI、Dydas AI Agent等。

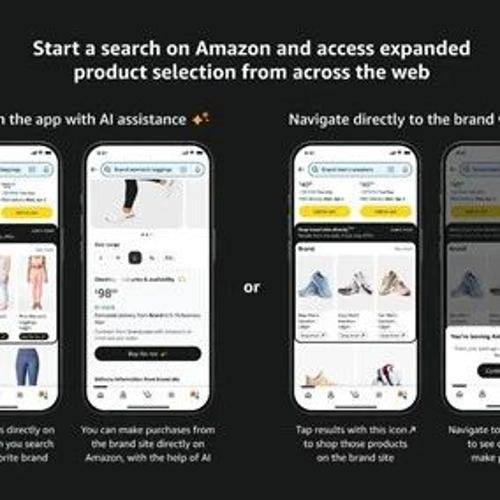

谷歌升级AI搜索,加入视觉搜索功能

谷歌扩大了Google One AI Premium订阅用户的AI搜索功能,新增视觉搜索,用户可通过文字、语音或图片提问,系统利用多模态功能分析照片中的上下文信息并提供相关链接。

4 月 11 日《1 小时 AI 公开课》,帮传统企业 “点亮” AI 魔法灯!

在AIGC开放社区推出的《1小时AI公开课》首期课程聚焦传统企业如何与AI结合的核心议题,由专业讲师李扬主讲。课程涵盖六大模块,帮助听众建立完整的认知框架,并提供免费专家咨询福利。

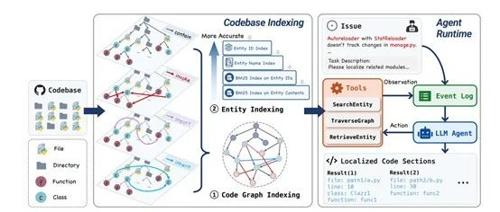

斯坦福等开源代码定位AI Agent,极大提升开发、维护效率

斯坦福大学等研究团队开源了智能体LocAgent,用于解决复杂代码库中的代码定位问题。LocAgent通过图基表示技术捕捉代码结构和依赖关系,并利用稀疏层次实体索引快速搜索与问题描述相关的代码片段。

AI Agent大变天!谷歌开源A2A,一夜改变智能体交互

昨晚,谷歌发布了首个标准智能体交互协议A2A,允许不同企业应用平台上的智能体能够安全自由地进行数据交换。首批加入的企业包括Atlassian、Box等50多家知名公司。A2A遵循五项原则,支持各种模态和提高用户体验协商功能,旨在打破系统孤岛,推动智能体生态快速发展。

媲美OpenAI-o3,刚刚开源模型DeepCoder,训练方法、数据集大公开

著名模型DeepCoder-14B-Preview开源,参数虽少但表现优异。该模型在LiveCodeBench测试中得分为60.6%,高于OpenAI的o1模型,接近o3-mini水平。Together AI不仅开源模型权重和训练数据集,还优化了训练方法和技术以提升性能。