关注我,记得标星⭐️不迷路哦~

关注我,记得标星⭐️不迷路哦~

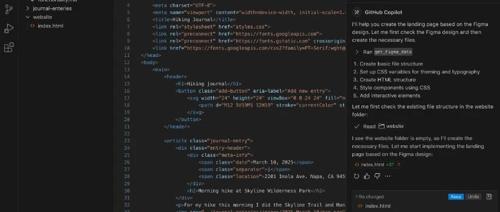

✨ 1: GitHub Copilot

AI编程伴侣

GitHub Copilot是一款先进的AI编程助手,旨在显著提高开发者的编码效率和代码质量,其核心功能围绕智能代码建议和交互式AI辅助展开。该工具能够根据用户的特定项目需求进行模型选择和聊天响应定制。它主要通过两个VS Code扩展提供服务:一是提供实时行内代码建议的GitHub Copilot,包括上下文感知的代码补全和预测下一步编辑的“Next Edit Suggestions”,帮助用户快速编写代码;二是GitHub Copilot Chat,一个对话式AI助手,允许用户使用自然语言在聊天界面提问,并根据当前代码库内容提供相关回答,同时还支持通过“Inline chat”直接将AI建议应用到代码中,实现代码重构或错误处理。此外,Copilot还提供强大的AI驱动编程会话模式,如允许通过自然语言在多文件间迭代代码的Copilot Edits,以及能够自主执行多步骤编码任务(包括错误处理和输出监控)的Agent模式。该服务广泛兼容Java、Python、JavaScript等各种主流编程语言和框架,并严格遵循隐私政策以保障用户代码的私密性。

地址:https://github.com/microsoft/vscode-copilot-chat

✨ 2: Gemini CLI OpenAI Worker

Gemini OpenAI API 适配器

Gemini CLI OpenAI Worker是一个基于Cloudflare Workers的项目,其核心功能是将Google Gemini模型转换为OpenAI兼容的API端点,使用户能够通过熟悉的OpenAI API模式(包括官方SDK和第三方客户端如Open WebUI)无缝访问Gemini的最新模型。该项目利用OAuth2认证机制,无需传统的API密钥,而是通过用户的Google账户进行身份验证,并智能地管理和缓存访问令牌。它支持多模态对话,可处理Base64编码或URL形式的图像输入,提供实时流式响应,并能通过Google Code Assist API利用Google的免费层服务,甚至为特定模型生成模拟的思考过程输出,作为一个高效的中间转换层。

地址:https://github.com/GewoonJaap/gemini-cli-openai

✨ 3: All Model Chat

全能模型聊天

All Model Chat 是一款专为 Google Gemini API 设计的强大网页聊天应用,旨在提供与 Gemini 家族模型(包括文本、图像、视频生成及文本转语音)的无缝交互体验。该项目主要功能和核心亮点体现在其全面的 AI 能力支持,允许用户动态切换模型、自由选择流式或非流式响应,并进行高级 AI 配置,如调整随机性参数、设置系统提示、查看模型思考过程、实现语音输入转录及文本转语音输出。同时,它具备卓越的多模态输入处理能力,支持用户通过拖放、粘贴、拍照、录音等多种灵活方式上传图像、视频、音频和多种文档格式,并提供智能的文件管理和实时预览。在用户体验方面,该应用通过浏览器本地存储实现聊天历史的持久化管理,用户可便捷地浏览、加载、删除过往对话,并能创建、导入及导出预设场景以快速定制会话环境。其消息渲染功能强大,全面支持 GitHub Flavored Markdown 和 LaTeX 数学公式,并提供交互式代码块,具备语法高亮、一键复制、下载以及 HTML/SVG 内容的实时预览等特性。此外,应用还提供了亮暗主题切换、个性化字体和语言设置、响应式布局、性能指标显示(如响应时间与Token使用)、丰富的键盘快捷键,并通过 Service Worker 实现了离线访问支持,整体构建在 React 19 和 TypeScript 技术栈上,保证了应用的现代化和高效性。

地址:https://github.com/yeahhe365/All-Model-Chat

✨ 4: Hunyuan-A13B

高效多专家大语言模型

Hunyuan-A13B是一个创新且开源的大语言模型,它基于细粒度MoE架构,旨在以130亿活跃参数(总计800亿参数)提供高效且可扩展的尖端性能,特别适用于资源受限环境下的高级推理和通用应用。其核心功能包括支持快慢思维的混合推理模式、原生256K超长上下文理解能力、以及在智能体任务上的卓越表现。该模型通过Grouped Query Attention (GQA) 和多量化格式实现高效推理,并且已开源预训练、指令微调、FP8和INT4量化版本。其在多项基准测试(包括数学、科学、编码、推理和智能体领域)中展现出强大的竞争力,并提供了使用Hugging Face Transformers进行交互、模型训练指南,以及通过TensorRT-LLM、vLLM和SGLang进行部署的详细支持,包括预构建的Docker镜像和量化模型部署方案。

地址:https://github.com/Tencent-Hunyuan/Hunyuan-A13B

✨ 5: n8n-MCP

AI赋能n8n工作流自动化与管理

n8n-MCP是一个Model Context Protocol (MCP) 服务器,旨在为AI助手(如Claude)提供对n8n工作流自动化节点的全面、结构化知识,从而显著提升AI创建和管理n8n工作流的能力。其核心功能包括提供对525个以上n8n节点的详细文档、属性和操作的访问,并能识别出可用于AI的工具节点。该项目具备智能节点搜索、提取节点关键属性以优化配置、预设任务模板、以及在部署前后对节点配置和完整工作流进行强大验证的能力。通过与n8n API的可选集成,AI助手还能直接管理工作流,例如创建、执行和关键的“基于差异”的部分更新功能,后者可节省80-90%的令牌消耗,大幅提高AI驱动工作流开发的效率和准确性。

地址:https://github.com/czlonkowski/n8n-mcp

(文:每日AI新工具)