卓越性能

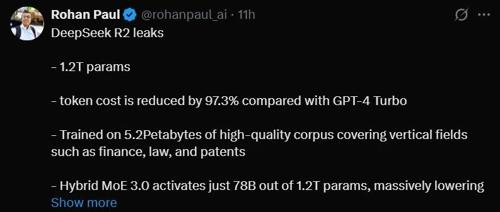

DeepSeek R2 参数被“意外”泄漏

DeepSeek R2参数量高达1.2万亿,采用Hybrid MoE 3.0架构,在保持模型能力的同时实现了计算资源的极致压缩,并引入了专门针对法律文书分析的新模块。其多模态精度达到92.4%,误报率低,部署优势明显,支持国产芯片优化,预计未来将减少对西方依赖。

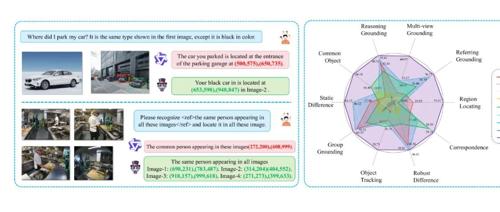

Migician:清华、北大、华科重磅出击!多图像定位大模型,安防与自动驾驶的“破局者”

在人工智能飞速发展的背景下,清华大学联合实验室研发的Migician多模态视觉定位模型解决了复杂场景下的目标定位难题。该模型能结合文本描述和图像信息,在安防监控、自动驾驶、医疗影像分析及机器人具身智能等多个领域实现高效准确的目标定位,显著提升系统的感知与决策能力。

Grok祭出首款生图模型Aurora!两位95后华人立大功,耗时6月自研MoE

新智元报道

编辑:桃子 好困

xAI发布自研图像生成模型Aurora,集成到Grok中。耗时6个月研发完成,采用MoE架构训练的自回归混合专家模型提升了Grok的图像生成能力。