分享

Yann LeCun:仅靠文本训练永远无法实现人类级AI

AI泰斗Yann LeCun批评大语言模型仅靠文本训练无法达到人类水平,指出视觉数据量远超文字。LeCun认为未来需关注多模态和现实世界理解能力,而不仅仅是信息量大小。

Transformer Lab:100%本地运行的LLM工作站,开箱即用的全能选手!

Transformer Lab 是一个专为 LLM 设计的实验平台,支持一键下载多种开源模型、微调训练、搭建 RAG 应用,并且在本地运行保证隐私安全。

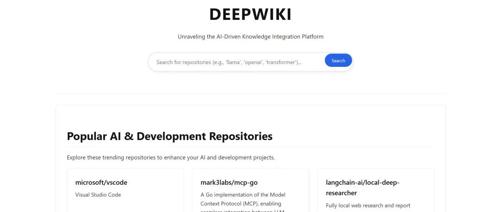

Devin团队开源DeepWiki:助你快速读懂所有GitHub代码库!

Cognition 团队开源 DeepWiki 项目,旨在自动生成 GitHub 项目的文档页面,帮助开发者快速理解代码库的核心架构、组件与依赖关系,改变软件工程师阅读和维护代码的方式。

传言:DeepSeek R2参数暴涨至1.2万亿、便宜97.3%!美股或将巨震!

DeepSeek R2参数达到1.2万亿,采用Hybrid MoE 3.0架构,并在成本上大幅下降。其多模态能力出色,视觉理解和工业质检表现优异,8bit量化压缩后仍保持较高精度。

字节跳动 Top Seed 大模型顶尖人才计划启动了

字节跳动启动2026届Top Seed校招计划,目标招募约30名顶尖博士,涵盖大语言模型、多模态生成等关键领域。此举揭示了对大模型时代底层基础设施的争夺战。

危险的游戏:只需一张照片,几行代码,O3就让你的生活暴露在大众眼中

文章介绍了西蒙·威利森利用AI模型分析照片拍摄地点的故事,展示了当前AI技术可以通过照片识别地理位置的安全隐患,并引发了对AI安全性的担忧。