量子位

量子位

360开源高质量图文对齐数据集!收纳1200万张图像+1000万组细粒度负样本,让模型告别“图文不符”

,避免“近视”?

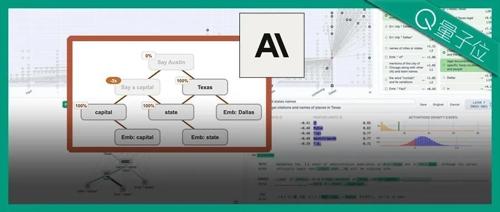

360人工智能研究团队提出了

FG-CLIP

,可以明显缓解CLIP的“视觉近视”

让AI学着“看菜下碟”!港中大等新框架让推理长度减少90%,准确率反增17%

香港中文大学与新加坡国立大学的研究者提出了一种名为TON的新颖选择性推理框架,让视觉语言模型可以自主判断是否需要显式推理。该方法显著减少了生成的思考链长度,提高了模型推理过程的效率,并且在不牺牲准确率的前提下提升了响应多样性。

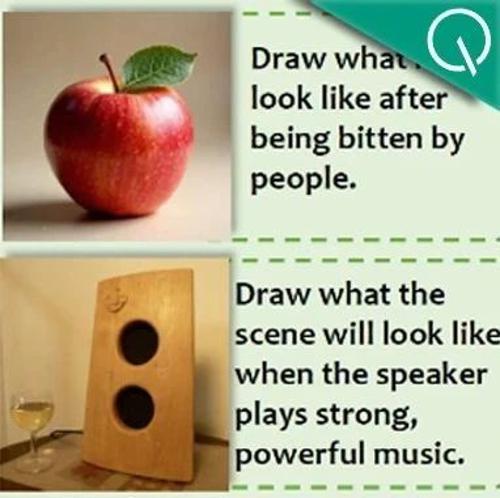

GPT-4o-Image仅完成28.9%任务!上海AI实验室等发布图像编辑新基准,360道人类专家严选难题

上海人工智能实验室等团队发布全新图像编辑评测基准RISE,评估了九个视觉编辑模型的复杂指令理解和执行能力。结果显示GPT-4o-Image仅能完成28.9%的任务,显著低于预期;RISEBench覆盖时间、因果、空间和逻辑四种核心推理类型,为视觉编辑模型的发展提供了新的视角。

AI生图大洗牌!流匹配架构颠覆传统,一个模型同时接受文本和图像输入

新模型FLUX.1 Kontext能接受文本和图像输入,具备角色一致性、局部编辑等特性。它被用于生成与修改上下文相关的图像,并通过官方试玩平台Flux Playground提供两种型号供选择。

全面评估多模态模型视频OCR能力,Gemini 准确率仅73.7%

MME-VideoOCR团队评估MLLM在视频OCR中的能力,构建精细任务体系和高质量数据集,揭示了当前模型的局限性,并提出了优化建议。

10个小模型并联跑赢GPT-4.1!无额外训练,方法仅4步

上海人工智能实验室联合团队提出Avengers框架,通过四个轻量步骤集合多个小型模型实现复杂任务的高效解决。结果证明,在无需额外训练的情况下,Avengers框架能够达到甚至在某些方面超越顶尖大型模型的水平。