在人工智能领域,大型语言模型(LLM)的发展日新月异。英伟达作为行业巨头,一直致力于推动技术的创新与突破。最近,英伟达开源了 OpenReasoning-Nemotron 系列模型,专注于数学、科学和代码领域的推理任务。这一开源项目为技术探索者和开发者提供了强大的工具,有望在多个领域带来深远影响。

一、项目概述

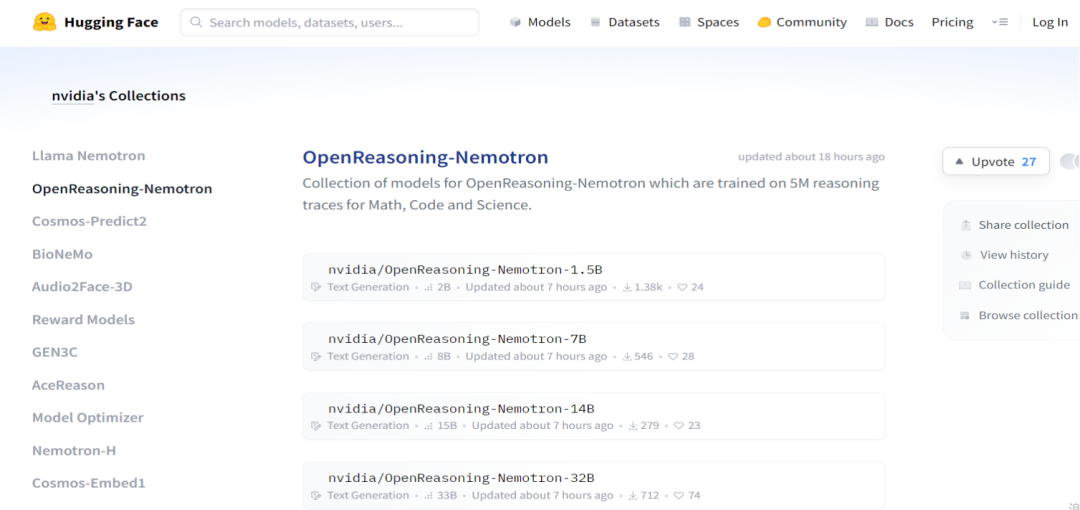

OpenReasoning-Nemotron 是英伟达开源的一系列推理能力强大的大型语言模型(LLM),基于 DeepSeek R1 0528 模型蒸馏而成。该系列模型涵盖 1.5B、7B、14B 和 32B 四种不同参数规模,专注于数学、科学和代码领域的推理任务。通过大规模数据蒸馏和有监督微调(SFT)训练,OpenReasoning-Nemotron 在多个基准测试中创下新纪录,展现出卓越的推理性能。其独特的“重型”推理模式基于 GenSelect 算法结合多个智能体的工作,进一步提升表现,为复杂任务提供了高效解决方案。

二、技术原理

(一)大规模数据蒸馏

OpenReasoning-Nemotron 的训练基础是 DeepSeek R1 0528 671B 模型生成的 500 万高质量推理解决方案,涵盖数学、科学和代码领域。这些数据通过大规模数据蒸馏技术,将复杂的推理任务分解为更简单的子任务,并将这些子任务的解决方案传递给 OpenReasoning-Nemotron 模型,从而提升其推理能力。数据蒸馏不仅提高了模型的泛化能力,还使其在特定领域的推理表现更加出色。

(二)有监督微调(SFT)

与许多依赖强化学习(RL)的模型不同,OpenReasoning-Nemotron 采用有监督微调(SFT)进行训练。SFT 方法通过标注数据对模型进行直接指导,使其能够快速学习特定任务的模式和规律。这种方法不仅提高了模型的训练效率,还避免了强化学习中可能出现的不稳定性和复杂性。通过 SFT,OpenReasoning-Nemotron 能够在短时间内达到较高的推理性能,为后续的强化学习研究提供了坚实的基础。

(三)多智能体推理(GenSelect)

OpenReasoning-Nemotron 的“重型”推理模式基于 GenSelect 算法。该算法能够启动多个并行推理过程,每个过程由一个智能体独立完成。这些智能体生成的解决方案会被汇总并评估,最终选择最佳的解决方案作为最终输出。这种多智能体协作的方式不仅提高了推理的准确性和可靠性,还能够处理复杂的多步骤任务,展现出强大的推理能力。

(四)模型架构

OpenReasoning-Nemotron 基于 Qwen 2.5 架构,结合了最新的 R1 模型生成的数据。这种架构设计确保了模型在推理任务上的高效性和准确性。Qwen 2.5 架构在处理复杂的推理任务时表现出色,能够快速生成高质量的解决方案。同时,结合 R1 模型的数据进一步优化了模型的性能,使其在数学、科学和代码领域表现出色。

三、主要功能

(一)高效推理

OpenReasoning-Nemotron 在数学、科学和代码等领域表现出色,能够生成高质量的推理解决方案。无论是在解决复杂的数学问题、进行科学推理,还是优化代码性能,该模型都能提供准确且高效的推理支持。

(二)多模型规模

OpenReasoning-Nemotron 提供 1.5B、7B、14B 和 32B 四种不同参数规模的模型,满足不同计算资源和任务需求。较小的模型适合资源受限的环境,而较大的模型则能够处理更复杂的任务。这种多样化的模型规模为开发者提供了灵活的选择。

(三)“重型”推理模式

基于GenSelect 算法结合多个智能体的推理结果,OpenReasoning-Nemotron 的“重型”推理模式进一步提升了性能。在数学和代码任务中,这种模式能够处理复杂的多步骤问题,提供更准确的解决方案。

(四)强大的基线模型

OpenReasoning-Nemotron 为未来基于强化学习(RL)的推理研究提供了强大的起点。其在有监督微调(SFT)阶段展现出的性能,为后续的强化学习研究提供了坚实的基础,助力开发更高效的推理技术。

(五)本地运行支持

OpenReasoning-Nemotron 支持在本地 100% 运行,基于 LM Studio 等工具进行部署和使用。开发者可以在本地环境中轻松部署该模型,无需依赖外部服务,提高了使用的灵活性和安全性。

四、应用场景

(一)数学问题解决

OpenReasoning-Nemotron 在教育、科研和竞赛中能够辅助解决复杂数学问题,提供详细解题步骤和推理支持。无论是解决高难度的数学竞赛题目,还是在科研中进行数学建模和分析,该模型都能提供强大的帮助。

(二)科学推理

在物理、化学、生物和环境科学等领域的复杂问题中,OpenReasoning-Nemotron 能够提供推理和解决方案。例如,在物理实验数据分析、化学反应机理推导或生物进化过程模拟中,该模型能够快速生成科学合理的推理结果。

(三)代码生成与优化

OpenReasoning-Nemotron 能够自动生成代码片段、优化代码性能并辅助代码调试,提升软件开发效率。开发者可以利用该模型快速生成高质量的代码,减少手动编写和调试的时间,提高开发效率。

(四)多智能体协作

OpenReasoning-Nemotron 的多智能体推理模式使其能够分解复杂任务,通过多智能体协作选择最优解决方案,优化系统性能。这种模式在处理复杂的多步骤任务时表现出色,能够显著提高系统的整体性能。

(五)研究与开发

OpenReasoning-Nemotron 为强化学习研究提供了强大的基线模型,支持新技术开发和推理算法探索。研究人员可以基于该模型进行进一步的优化和改进,开发出更高效的推理算法和技术。

五、性能表现

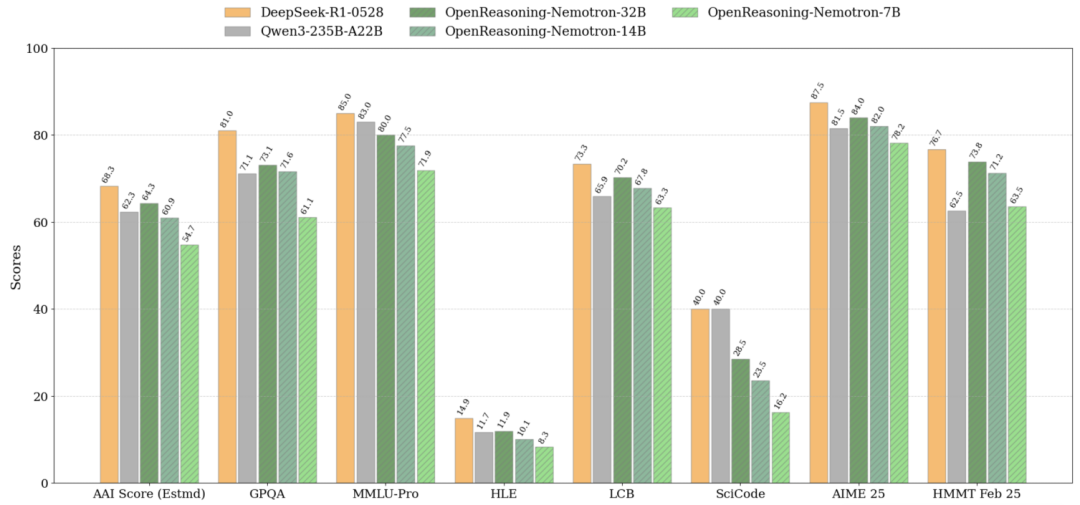

OpenReasoning-Nemotron 在多个基准测试中创下新纪录,特别是在数学领域,超越了 o3 等其他模型。其卓越的推理性能主要体现在以下几个方面:

1. 高准确率:在数学和科学推理任务中,OpenReasoning-Nemotron 的准确率显著高于其他同类模型。这得益于其大规模数据蒸馏和有监督微调的训练方式。

2. 高效性:该模型在处理复杂任务时表现出色,能够快速生成高质量的解决方案。其多智能体推理模式进一步提高了推理效率。

3. 适应性:OpenReasoning-Nemotron 能够适应多种任务和领域,展现出强大的泛化能力。无论是数学问题、科学推理还是代码生成,该模型都能提供可靠的解决方案。

六、快速使用

(一)环境准备

在本地部署OpenReasoning-Nemotron 模型之前,需要确保系统满足以下要求:

1. 硬件要求:推荐使用英伟达 GPU,如 NVIDIA A100 或 NVIDIA V100,以加速模型推理。

2. 软件环境:安装 Python 3.8 及以上版本,并确保安装了 PyTorch 和 Transformers 等相关库。

(二)模型下载

从Hugging Face 模型库下载 OpenReasoning-Nemotron 模型。访问以下链接,选择适合的模型版本进行下载:

https://huggingface.co/collections/nvidia/openreasoning-nemotron-687730dae0170059860f1f01

# Make sure git-lfs is installed (https://git-lfs.com)git lfs installgit clone https://huggingface.co/nvidia/OpenReasoning-Nemotron-1.5B

(三)安装依赖

运行以下命令安装必要的依赖库:

pip install torch transformers(四)推理示例

以下是一个基于transformers简单的推理示例:

import transformersimport torchmodel_id = "nvidia/OpenReasoning-Nemotron-1.5B"pipeline = transformers.pipeline("text-generation",model=model_id,model_kwargs={"torch_dtype": torch.bfloat16},device_map="auto",)# Code generation promptprompt = """You are a helpful and harmless assistant. You should think step-by-step before responding to the instruction below.Please use python programming language only.You must use ```python for just the final solution code block with the following format:```python# Your code here```{user}"""# Math generation prompt# prompt = """Solve the following math problem. Make sure to put the answer (and only answer) inside \\boxed{}.## {user}# """# Science generation prompt# You can refer to prompts here -# https://github.com/NVIDIA/NeMo-Skills/blob/main/nemo_skills/prompt/config/generic/hle.yaml (HLE)# https://github.com/NVIDIA/NeMo-Skills/blob/main/nemo_skills/prompt/config/eval/aai/mcq-4choices-boxed.yaml (for GPQA)# https://github.com/NVIDIA/NeMo-Skills/blob/main/nemo_skills/prompt/config/eval/aai/mcq-10choices-boxed.yaml (MMLU-Pro)messages = [{"role": "user","content": prompt.format(user="Write a program to calculate the sum of the first $N$ fibonacci numbers")},]outputs = pipeline(messages,max_new_tokens=64000,)print(outputs[0]["generated_text"][-1]['content'])

七、结语

OpenReasoning-Nemotron 是英伟达开源的一系列推理能力强大的大型语言模型,专注于数学、科学和代码领域的推理任务。通过大规模数据蒸馏和有监督微调训练,该模型在多个基准测试中创下新纪录,展现出卓越的推理性能。其“重型”推理模式和多智能体协作机制进一步提升了模型的表现,使其在复杂任务中表现出色。

项目地址:https://huggingface.co/collections/nvidia/openreasoning-nemotron-687730dae0170059860f1f01

(文:小兵的AI视界)