就在刚刚,Qwen团队推出Qwen3-Coder,开源模型中的Agent能力新王

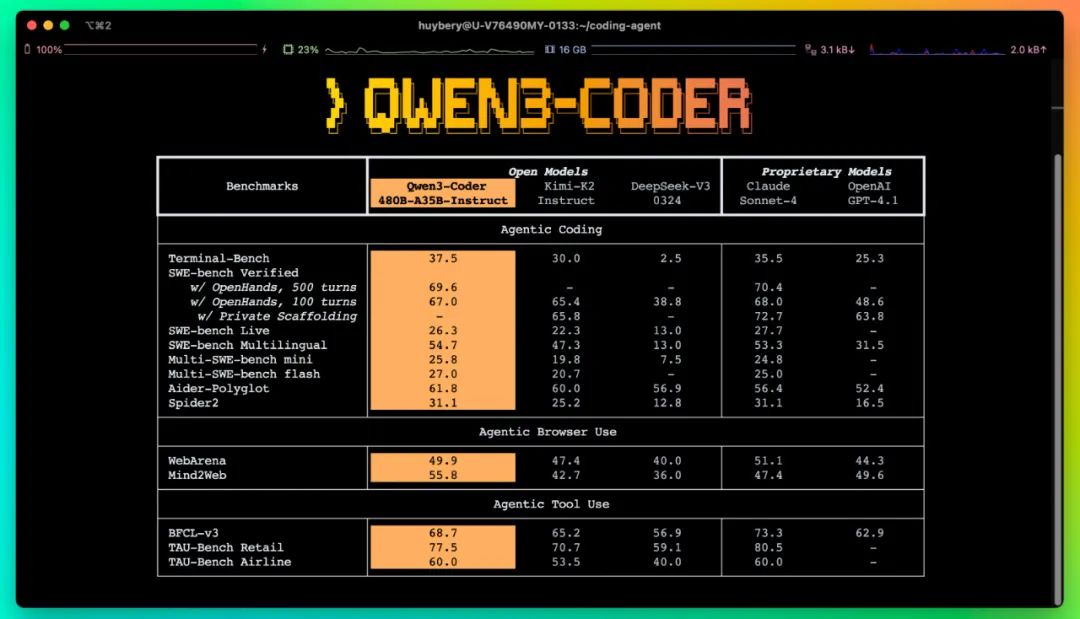

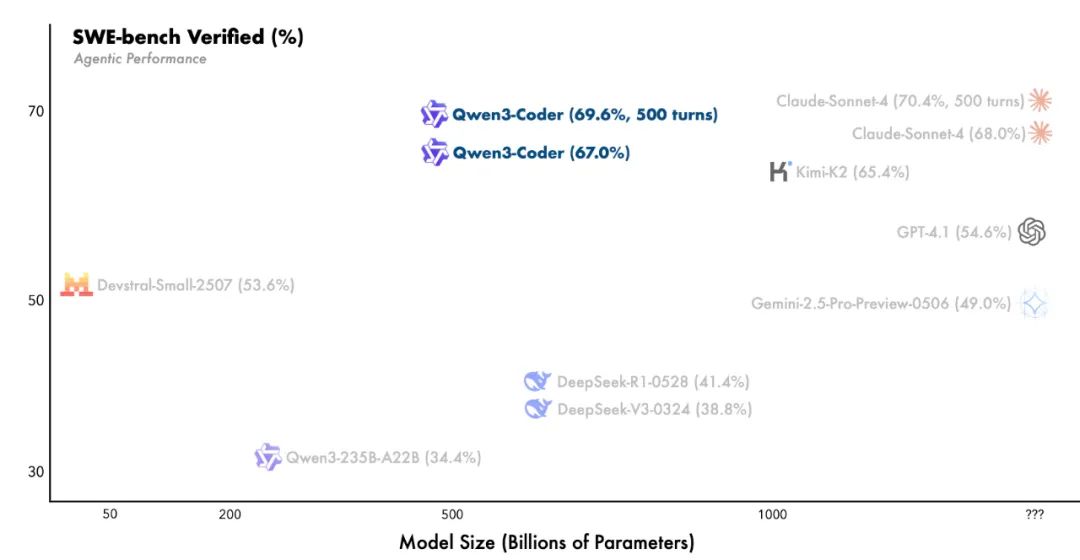

具体名称为Qwen3-Coder-480B-A35B-Instruct,总参数量 480B,激活 35B 的 MoE 模型,原生支持 256K token 的上下文并可通过 YaRN 扩展到 1M token,拥有强悍的代码和 Agent 能力。在 Agentic Coding、Agentic Browser-Use 和 Agentic Tool-Use 上取得了开源模型的 SOTA 效果,可以与 Cluade Sonnet4 媲美

在 SWE-bench Verified 也实现了开源模型 SOTA 的效果

网页端使用:

qwen团队还推出并开源了自己的命令行工具:Qwen Code。Qwen Code 基于 Gemini Code 进行二次开发,但进行了 prompt 和工具调用协议适配,使得 Qwen Code 可以最大程度激发 Qwen3-Coder 在 Agentic Coding 任务上的表现

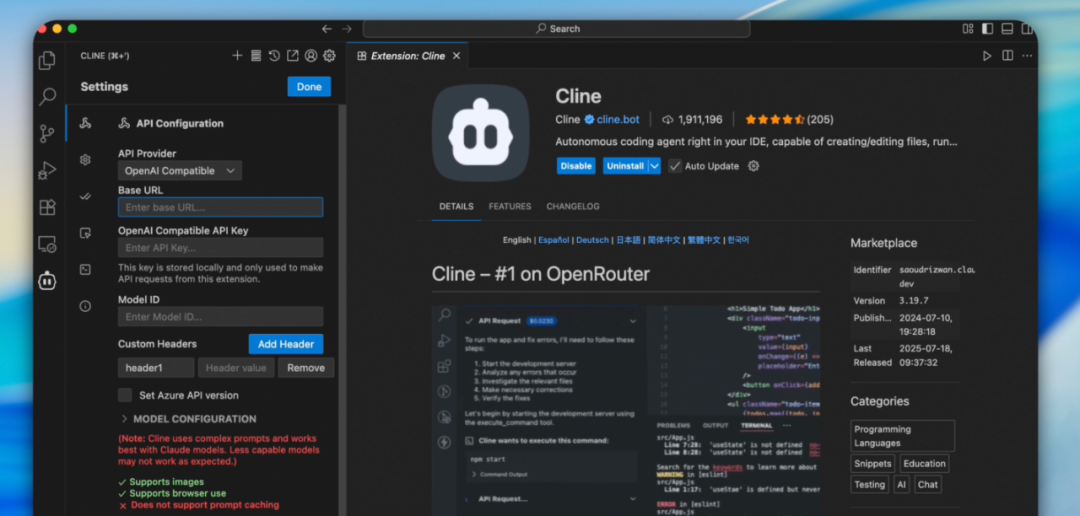

另外,可以在Claude Code、Cline 中调用Qwen3-Coder

命令行怎么用?官方『一条龙』保姆级服务已配齐,1分钟可上手

从命令行到API调用,各种姿势任你选,主打一个开箱即用!

官方定制命令行 Qwen Code使用

这是官方的“亲儿子”,专为Qwen3-Coder量身打造的CLI工具,让你在终端里就能和AI结对编程

第一步:安装 (需要先装好 Node.js 20+ )

两种方式:

懒人一键流:

# (这行是npm官方安装脚本,如果装过npm可跳过)

curl -qL https://www.npmjs.com/install.sh | sh

# 全局安装Qwen Code

npm i -g @qwen-code/qwen-code源码编译流 :

git clone https://github.com/QwenLM/qwen-code.git

cd qwen-code && npm install && npm install -g第二步:配置

Qwen Code支持OpenAI的SDK标准,所以你只需要从阿里云模型服务百炼平台获取API Key,然后配置一下环境变量就行:

export OPENAI_API_KEY="your_api_key_here"(或者直接写在项目根目录的 .env 文件里)

第三步:开干!

在终端里开始Vibe Coding:

qwenClaude Code 里调用

如果你是 Claude Code 的忠实用户,也完全没问题!官方提供了两种无缝接入方案

首先,你需要安装 Claude Code 本体:

npm install -g @anthropic-ai/claude-code然后,选择你的接入路径:

路径A:代理API法 (简单直接),只需配置两个环境变量,让Claude Code的请求直接指向Qwen的代理服务:

export ANTHROPIC_BASE_URL=https://dashscope-intl.aliyuncs.com/api/v2/apps/claude-code-proxy

export ANTHROPIC_AUTH_TOKEN=your-dashscope-apikey搞定!现在你的Claude Code已经有一颗“Qwen芯”了

路径B:路由配置法 (更灵活),这种方式通过一个路由工具来管理后端模型,配置更自由

# 安装路由和DashScope配置插件

npm install -g @musistudio/claude-code-router

npm install -g @dashscope-js/claude-code-config

# 运行一键配置命令,它会自动生成json配置文件

ccr-dashscope

# 通过路由启动Claude Code

ccr codeCline中使用

另一款神器 Cline 也支持!

-

1. 打开 Cline 的配置设置 -

2. API Provider: 选择 ‘OpenAI Compatible’。 -

3. OpenAI Compatible API Key: 填入你从Dashscope获取的API Key。 -

4. Use custom base URL: 打勾 ✔️ -

5. 在下方填入URL: https://dashscope-intl.aliyuncs.com/compatible-mode/v1 -

6. 输入模型名称: qwen3-coder-plus

保存,完事!

终极玩法,直接调API

对于想把Qwen3-Coder深度集成到自己应用里的开发者,直接调用API是最自由的方式。官方已经做好了OpenAI的兼容。

import os

from openai import OpenAI

# 客户端初始化,注意base_url

client = OpenAI(

api_key=os.getenv("DASHSCOPE_API_KEY"),

base_url="https://dashscope-intl.aliyuncs.com/compatible-mode/v1",

)

# 发起请求

completion = client.chat.completions.create(

model="qwen3-coder-plus",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "帮我创建一个在线书店的网页。"}

]

)

# 打印结果

print(completion.choices[0].message.content.strip())具体效果如何,请看后续我的测试

参考:

https://qwenlm.github.io/zh/blog/qwen3-coder/

(文:AI寒武纪)