作者:mumuu

编辑:李宝珠

转载请联系本公众号获得授权,并标明来源

「Voxtral-Mini-3B-2507 语音理解模型 Demo」现已上线 HyperAI超神经官网(hyper.ai)的「教程」板块,让我们一起开启语音交互「听得更准、懂得更深」的沉浸式体验,见证先进音频模型的全新突破!

语音作为「人类最自然的交互方式」,正逐渐成为人机交互的核心场景,随着语音互动的普及,音频模型也在针对需求不断创新优化。然而快速发展的同时伴随着市场供给的两极分化:低成本开源模型较容易出现错误率高、语义理解弱等问题,而高成本闭源模型通常价格高昂、存在部署局限,两者均难以满足多元需求。

基于此,Mistral AI 近期正式发布了首个先进音频模型 Voxtral,以开源高性能与低成本精准聚焦语音智能市场痛点。该模型提供 24B 和 3B 两种版本,前者适用于企业级规模化部署,后者则降低了个人轻量部署的准入门槛。在功能上,基于卓越的语音转录和深度理解能力,Voxtral 支持多语言、长文本上下文处理、内置问答和总结功能,其性能在多个 Benchmark 中超越现有开源音频模型。同时成本更低,广泛应用在各种场景,助力语音交互的普及。

Voxtral 正以技术普惠性推动语音交互模型实现从「可用」向「好用」的质变跃迁,不仅满足市场对高效能音频模型的需求,更拓宽了语音交互应用场景,真正构建起自然对话的智能生态基石。

「Voxtral-Small-3B/24B-2507 语音理解模型 Demo」现已上线 HyperAI超神经官网(hyper.ai)的「教程」板块,让我们一起开启语音交互「听得更准、懂得更深」的沉浸式体验,见证先进音频模型的全新突破!

教程链接:

* Voxtral-Mini-3B-2507 语音理解模型 Demo:

https://go.hyper.ai/5Q9uT

* Voxtral-Small-24B-2507 语音理解模型 Demo:

https://go.hyper.ai/p4X0s

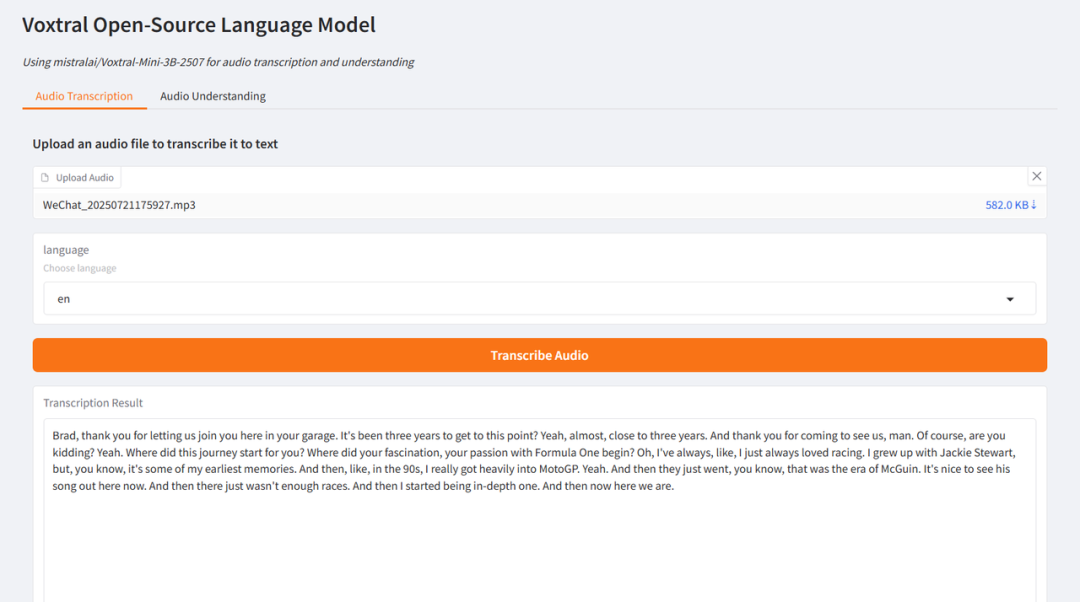

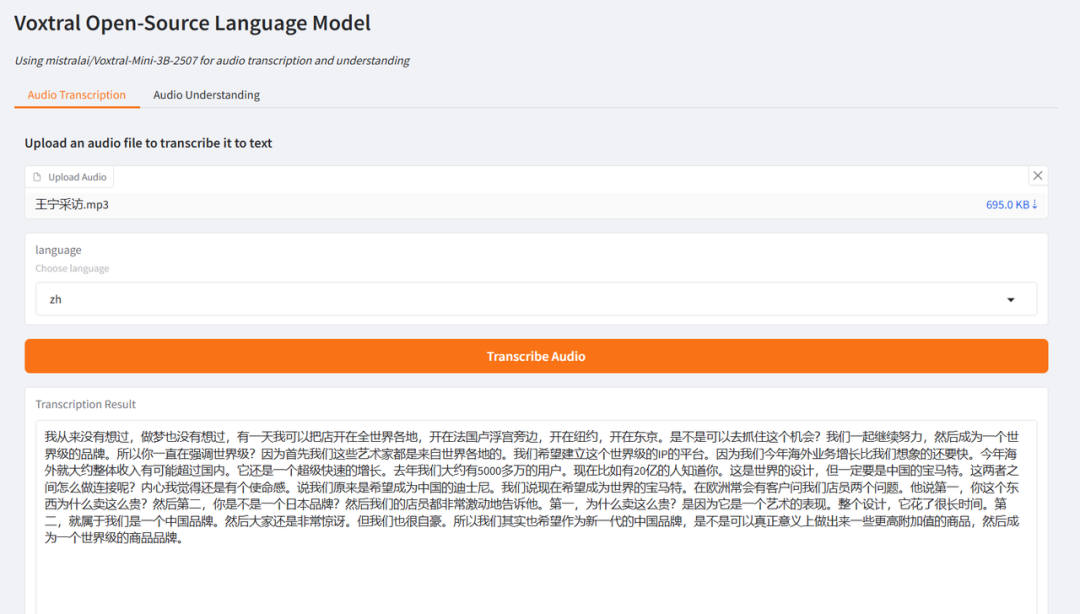

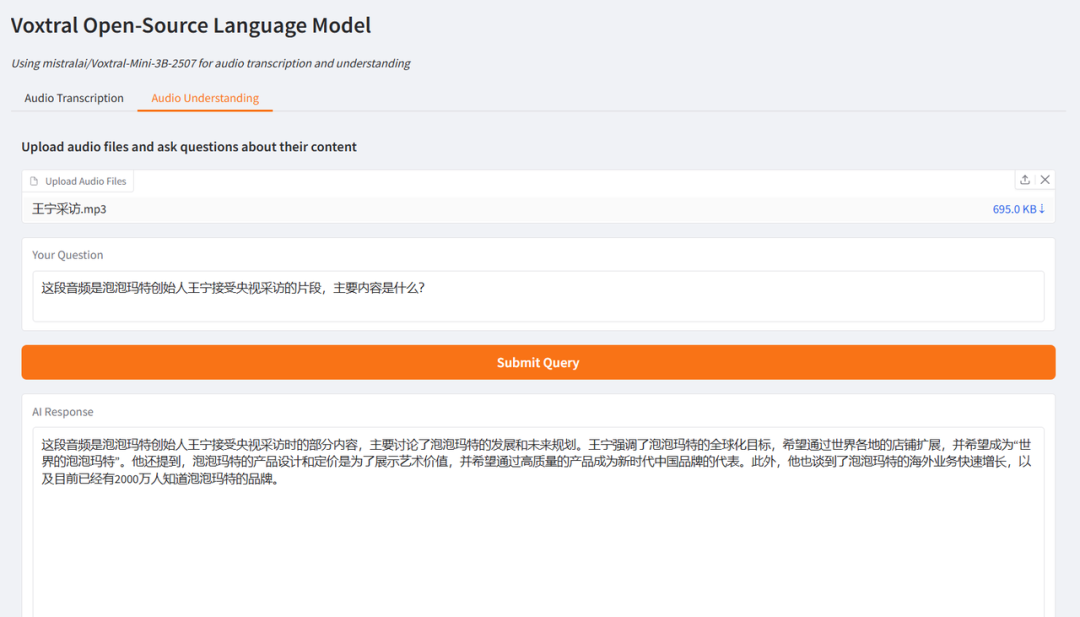

笔者分别使用《F1:狂飙飞车》领衔主演布拉德·皮特的采访片段、泡泡玛特创始人王宁的央视采访片段进行了测试,生成结果都很理想,验证了 Voxtral 的强大功能。

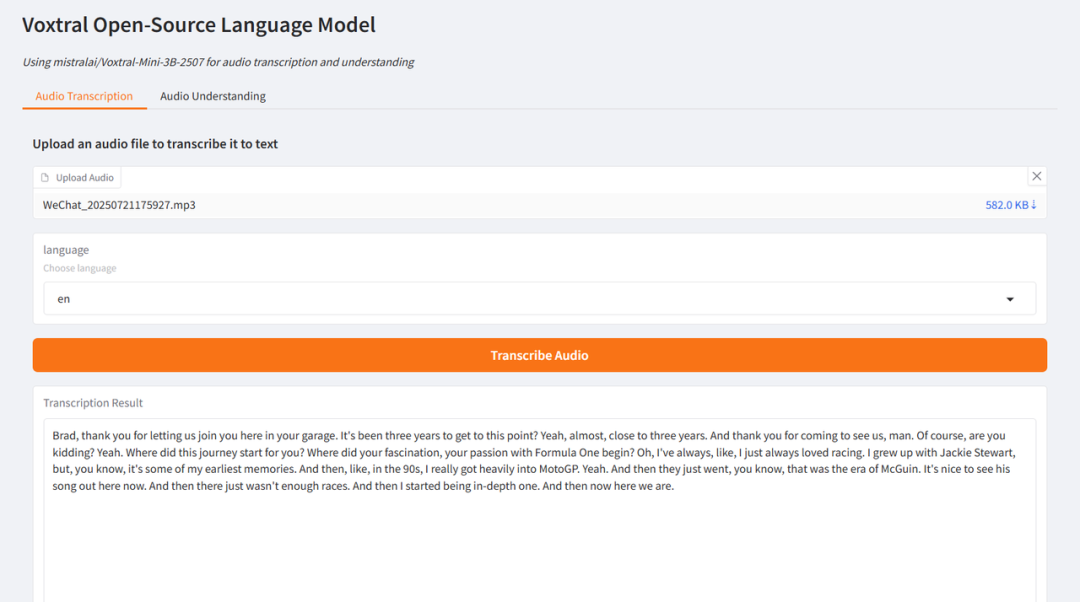

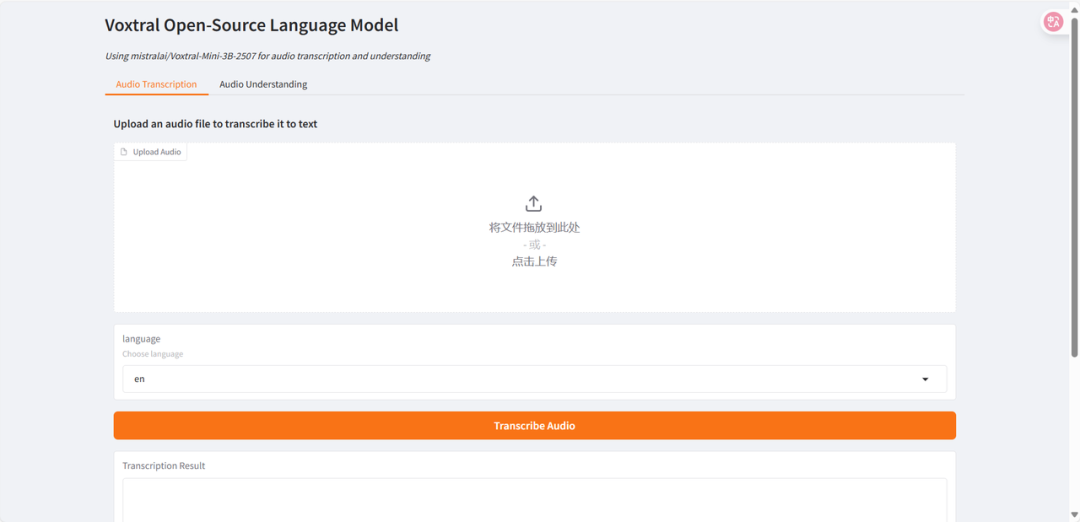

Audio Transcription 示例

Audio Transcription 示例

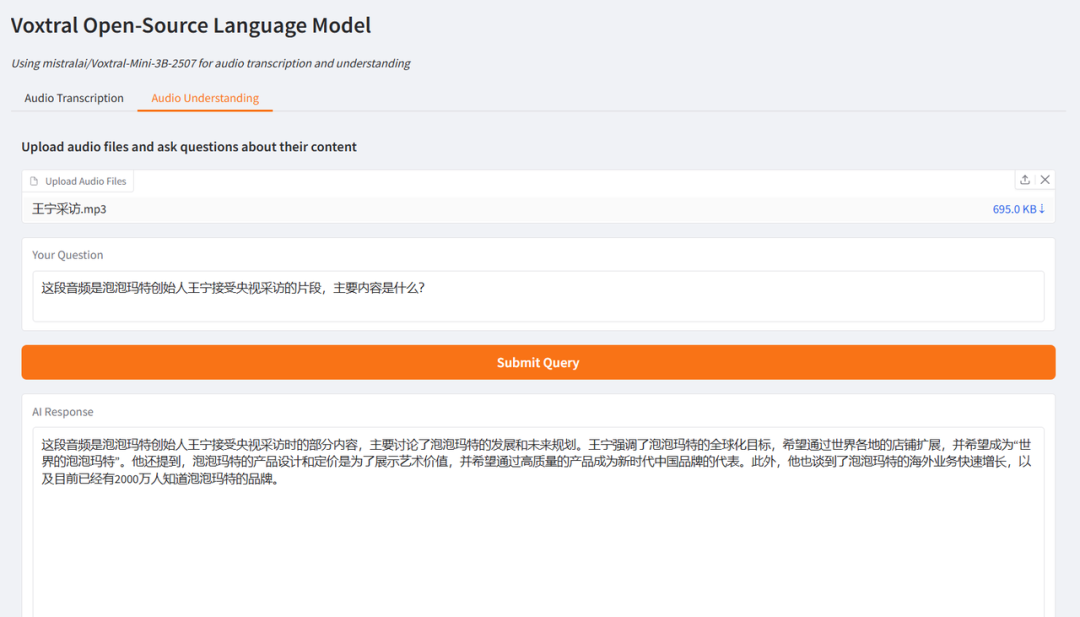

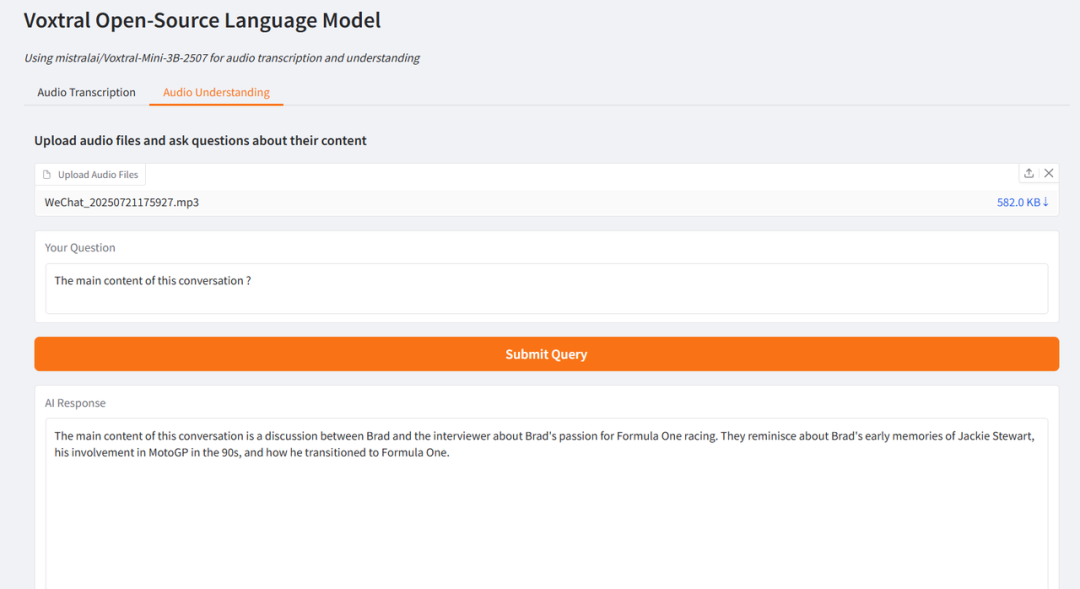

Audio Understanding 示例

Audio Understanding 示例

Demo 运行

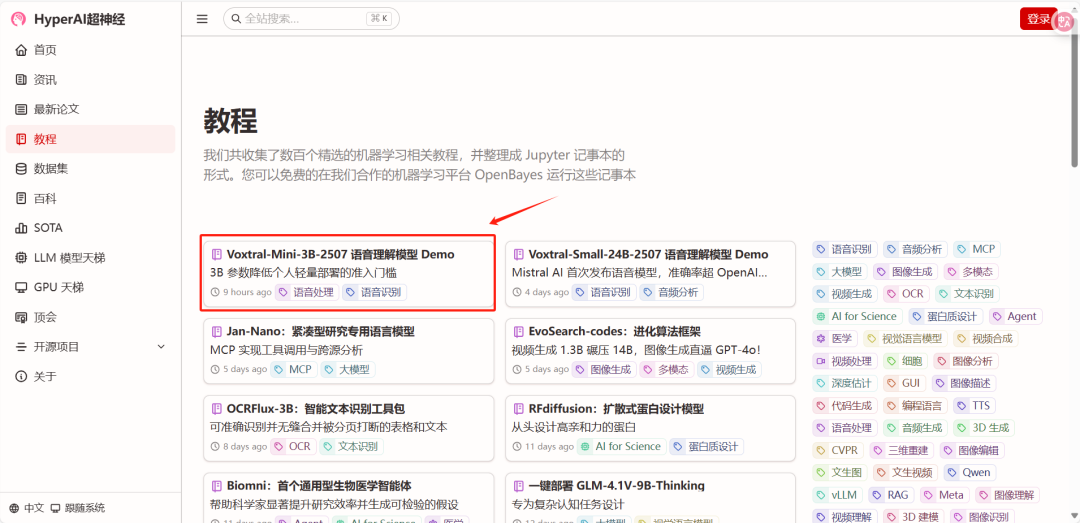

1. 进入 hyper.ai 首页后,选择「教程」页面,并选择「Voxtral-Mini-3B-2507 语音理解模型 Demo」,点击「在线运行此教程」。

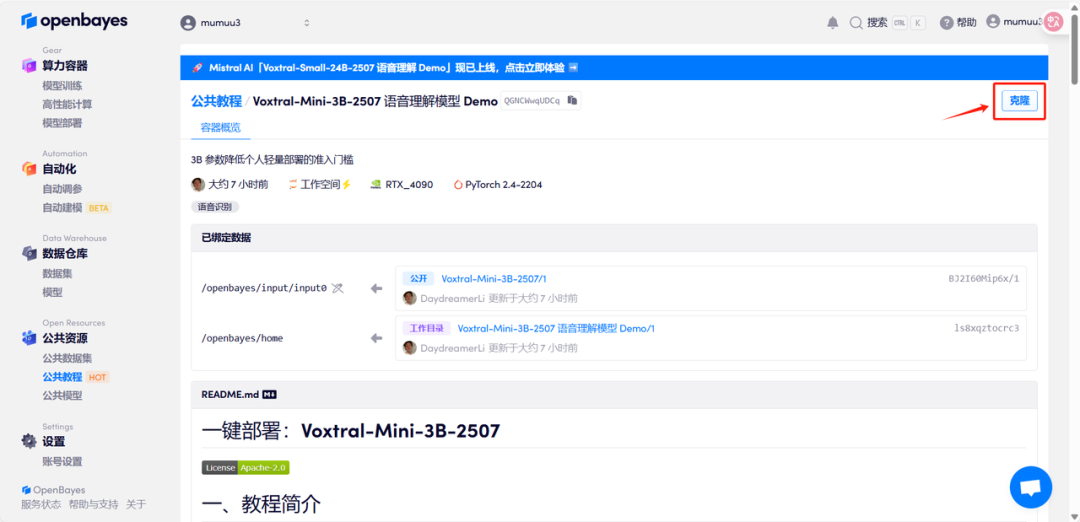

2.页面跳转后,点击右上角「克隆」,将该教程克隆至自己的容器中。

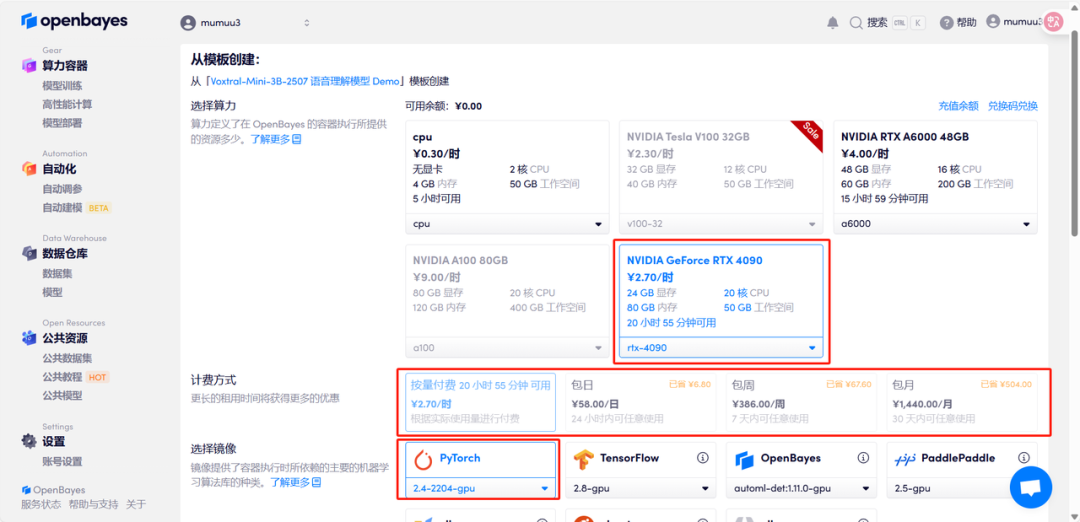

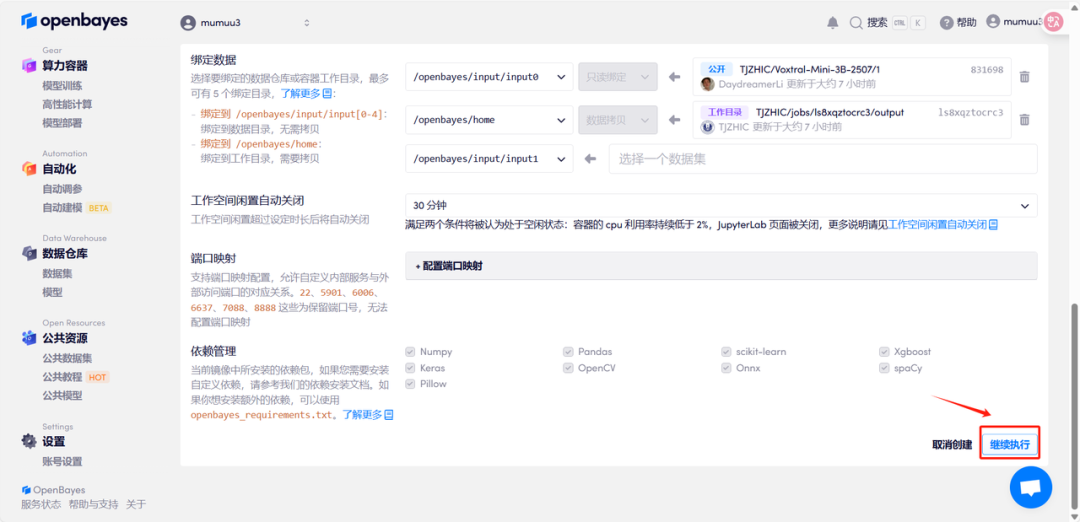

3.选择「NVIDIA GeForce RTX 4090」以及「PyTorch」镜像,按照需求选择「按量付费」或「包日/周/月」,点击「继续执行」。新用户使用下方邀请链接注册,可获得 4 小时 RTX 4090 + 5 小时 CPU 的免费时长!

HyperAI超神经专属邀请链接(直接复制到浏览器打开):

https://openbayes.com/console/signup?r=Ada0322_NR0n

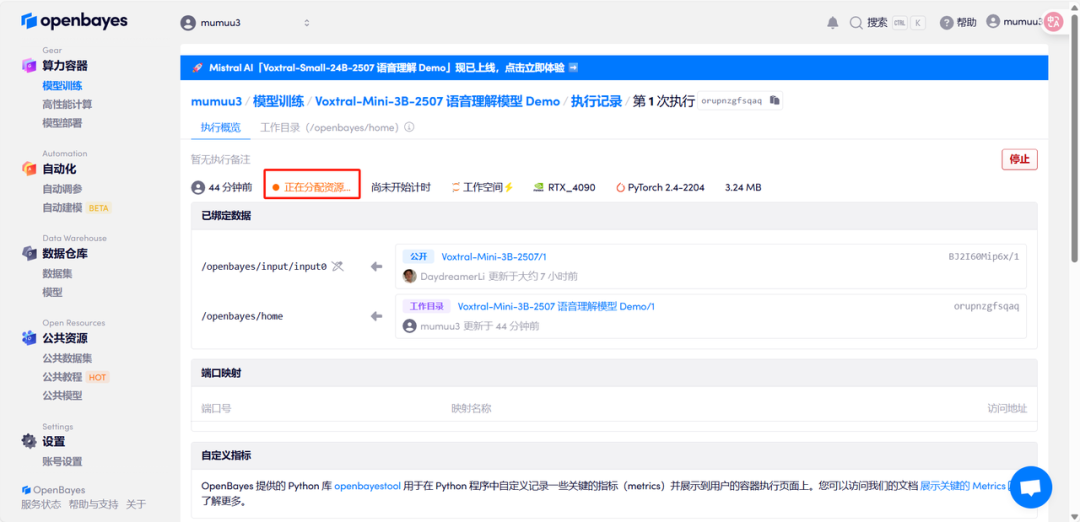

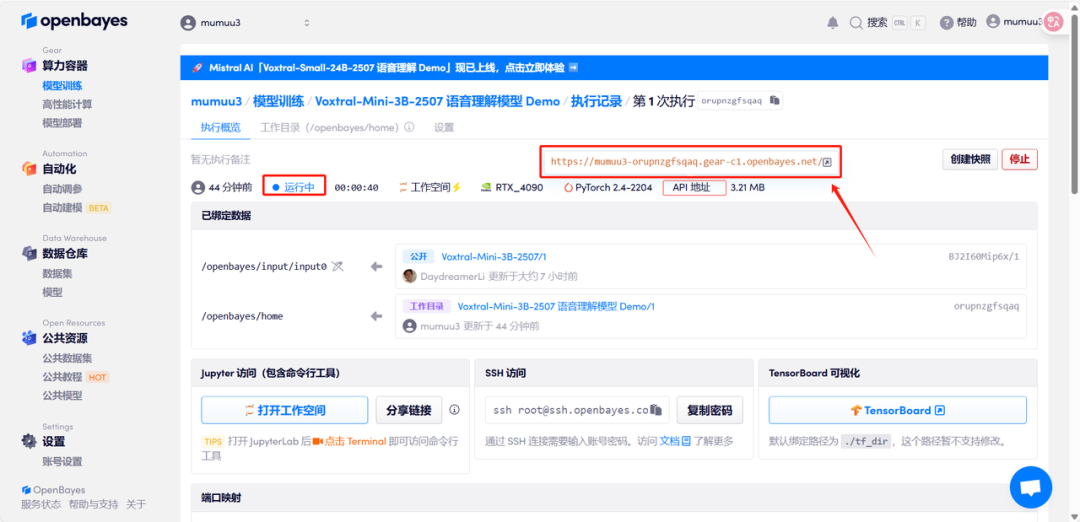

4.等待分配资源,首次克隆需等待 3 分钟左右的时间。当状态变为「运行中」后,点击「API 地址」旁边的跳转箭头,即可跳转至 Demo 页面。请注意,用户需在实名认证后才能使用 API 地址访问功能

效果演示

笔者分别使用《F1:狂飙飞车》领衔主演布拉德·皮特的采访片段、泡泡玛特创始人王宁的央视采访片段进行了测试,生成结果都很理想,验证了 Voxtral 的强大功能。

选择「Audio Transcription」测试功能,上传一段音频,选择语言后点击「Transcribe Audio」,稍等后即可生成结果。

选择「Audio Understanding」测试功能,上传一段音频,输入问题后点击「Submit Query」,稍等后即可生成结果。

此外,Voxtral 提供的 24B 版本适合企业级规模化部署,目前也已上线 HyperAI超神经官网(hyper.ai)的「教程」板块,用户可根据需要进行体验!

教程链接:

* Voxtral-Mini-3B-2507 语音理解模型 Demo:

https://go.hyper.ai/5Q9uT

* Voxtral-Small-24B-2507 语音理解模型 Demo:

https://go.hyper.ai/p4X0s

戳“阅读原文”,免费获取海量数据集资源!

(文:HyperAI超神经)