Qwen2.5-Coder 潜力无限,微软又基于 Qwen2.5-Coder 搞出了 NextCoder-32B。这个新模型在 Aider Leaderboard 刷到了 23.6 分,接近了 gpt-4o 的水平。

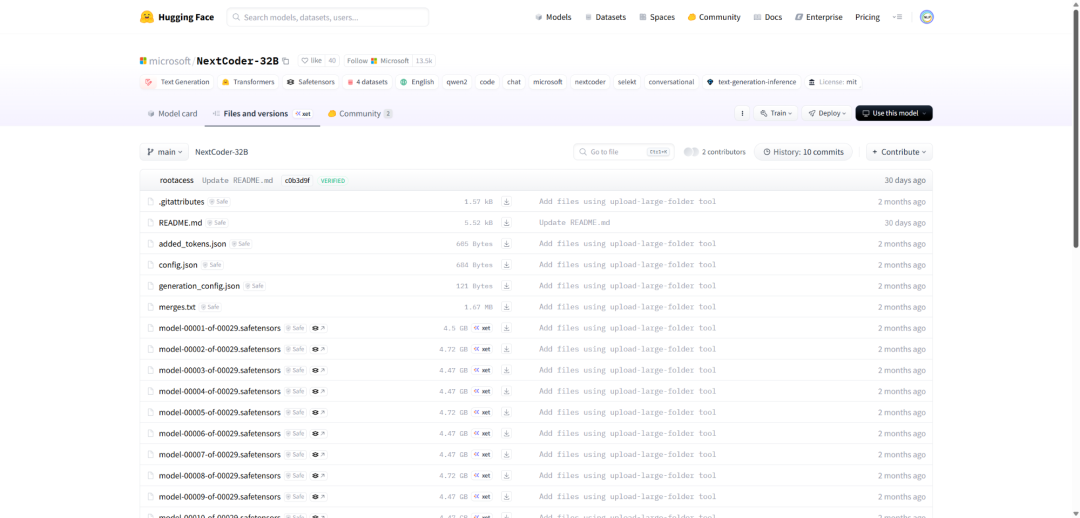

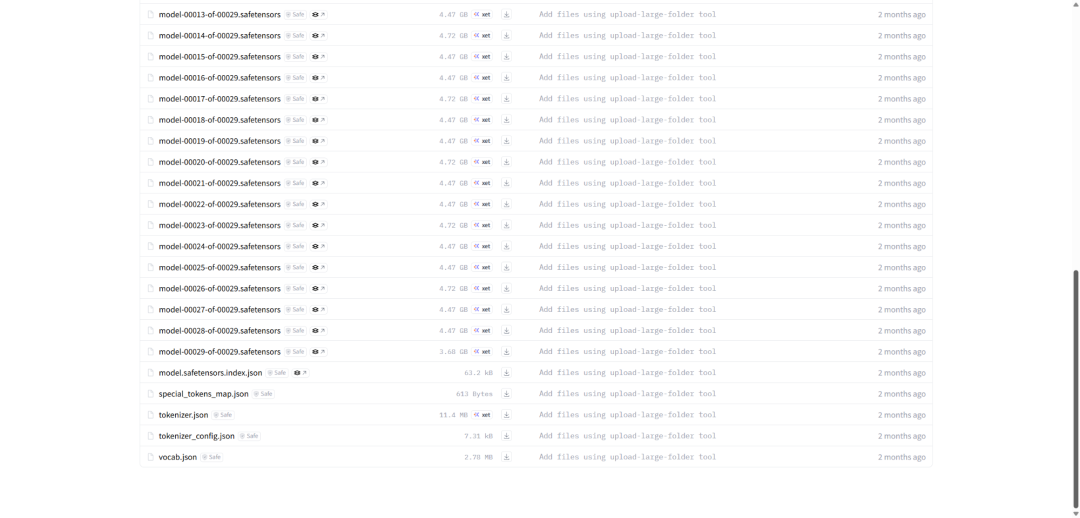

采用的魔改方法包括 SeleKT 后训练,以及魔改为带有 RoPE、SwiGLU、RMSNorm 和 Attention QKV 偏置的 transformers。

参考文献:

[1] 地址:https://huggingface.co/microsoft/NextCoder-32B

(文:NLP工程化)