一水 发自 凹非寺

量子位 | 公众号 QbitAI

AI大牛何恺明最新动向来了!

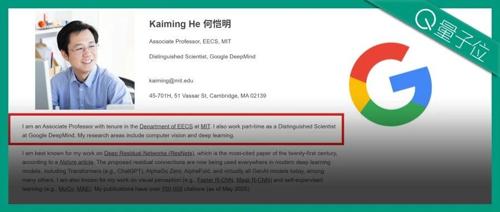

才刚拿下MIT终身教职没多久,这转眼又加盟谷歌DeepMind任杰出科学家。

目前这一消息已在个人主页同步更新:

也是在最近,MIT官网发布公告称:

今年MIT工程学院一共有11位教职人员获得终身教职,而何恺明也在名单中。

要知道他去年3月才正式在MIT开讲,这中间几乎只隔了一年左右时间。

回到这次加盟谷歌,从介绍里可以看到,确切来说他应该算是兼职(part-time)。

虽然他本人没有透露更多信息,但某书上已经有自称谷歌员工的网友提前剧透了一波:

他即将加入的是DeepMind基础研究组,直属领导的title是L8——离DeepMind老大哈萨比斯还隔着三个老板的距离。

那么问题来了,已经拥有MIT终身教职的何恺明,为啥又选择和谷歌联手呢?

一扒才知道,原来二者早已多次展开研究合作——

何恺明其人

先简单回顾一下何恺明的履历。

众所周知,何恺明算是CV领域(计算机视觉)的传奇人物。

他本科就读于清华大学物理系,博士师从汤晓鸥,毕业于香港中文大学。

2009年,汤晓鸥、何恺明以及孙剑凭借论文“Single Image Haze Removal Using Dark Channel Prior”,获得该年度CVPR的最佳论文奖,这也是第一次颁发给亚洲研究学者。

2011年博士毕业后进入微软亚洲研究院工作,任研究员,并在2016年加入Facebook AI Research(FAIR)继续研究计算机视觉。

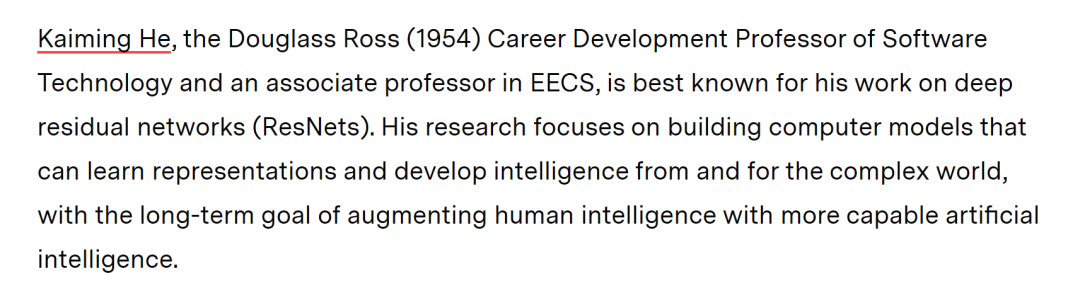

不过在这之前,他于2015年提出的ResNet(深度残差网络),不仅在ILSVRC 2015分类任务竞赛斩获第一名,还拿到了2016年CVPR最佳论文。

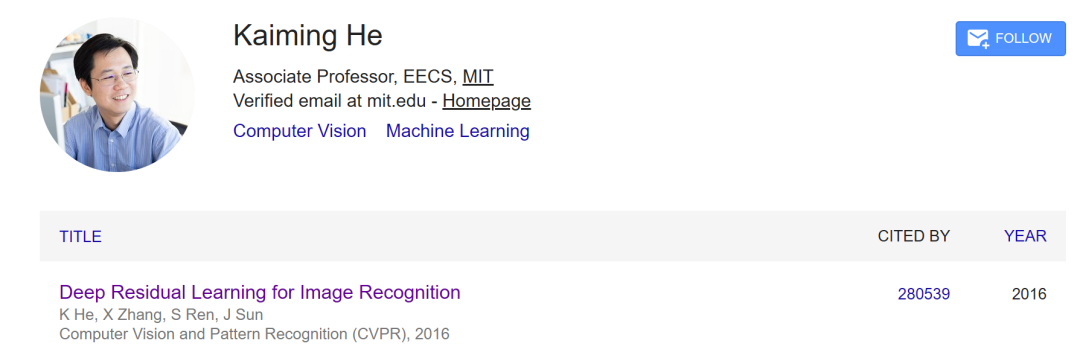

直到现在,ResNet仍然是其最高引研究,单篇引用量已超过28万次。

而且这一概念如今已广泛应用于现代深度学习模型,包括Transformer、AlphaGo Zero、AlphaFold以及几乎所有GenAI模型。

在FAIR期间,何恺明和团队在计算机视觉领域取得不少亮眼的成绩,包括Faster R-CNN及后续的Mask R-CNN等一系列研究。

其中,Mask R-CNN解决了图片中的实例级对象分割问题,不仅能将照片中的人、动物等对象单一检测,还可为其每个对象实例生成一个高质量分隔遮罩,该研究也获得了ICCV 2017最佳论文。

在FAIR干了相当长一段时间后,2023年他官宣加入MIT EECS(电子工程和计算机科学系) ,选择正式回归学术界。

这一转向在当时引起了广泛关注,甚至一众网友吐槽Meta痛失一员大将。

后来的故事就接上咱们的开头了~

总之,从学术界到产业界再到学术界,何恺明一路积累了丰硕研究成果。

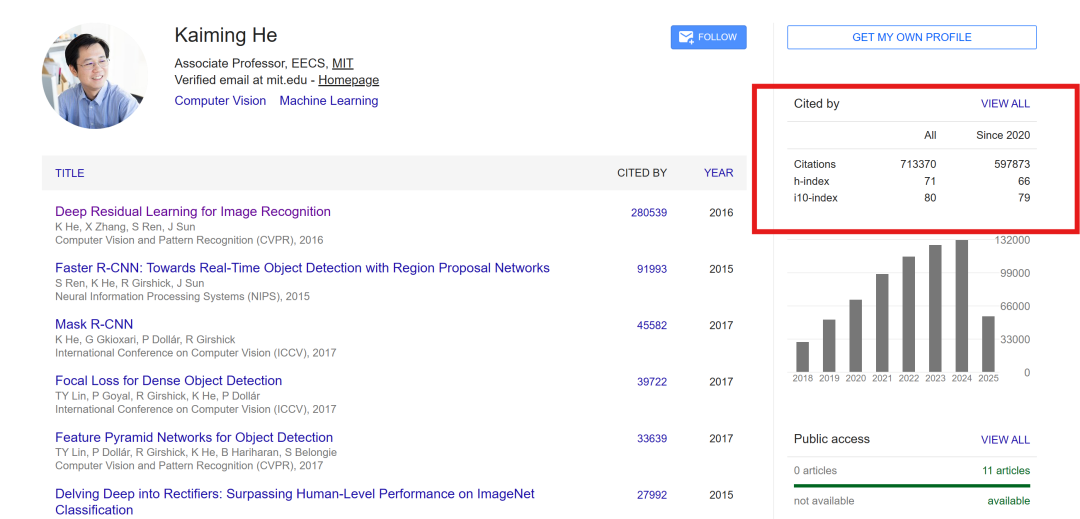

目前其谷歌学术总引用量已经超过71万次,是当之无愧的学术大佬。

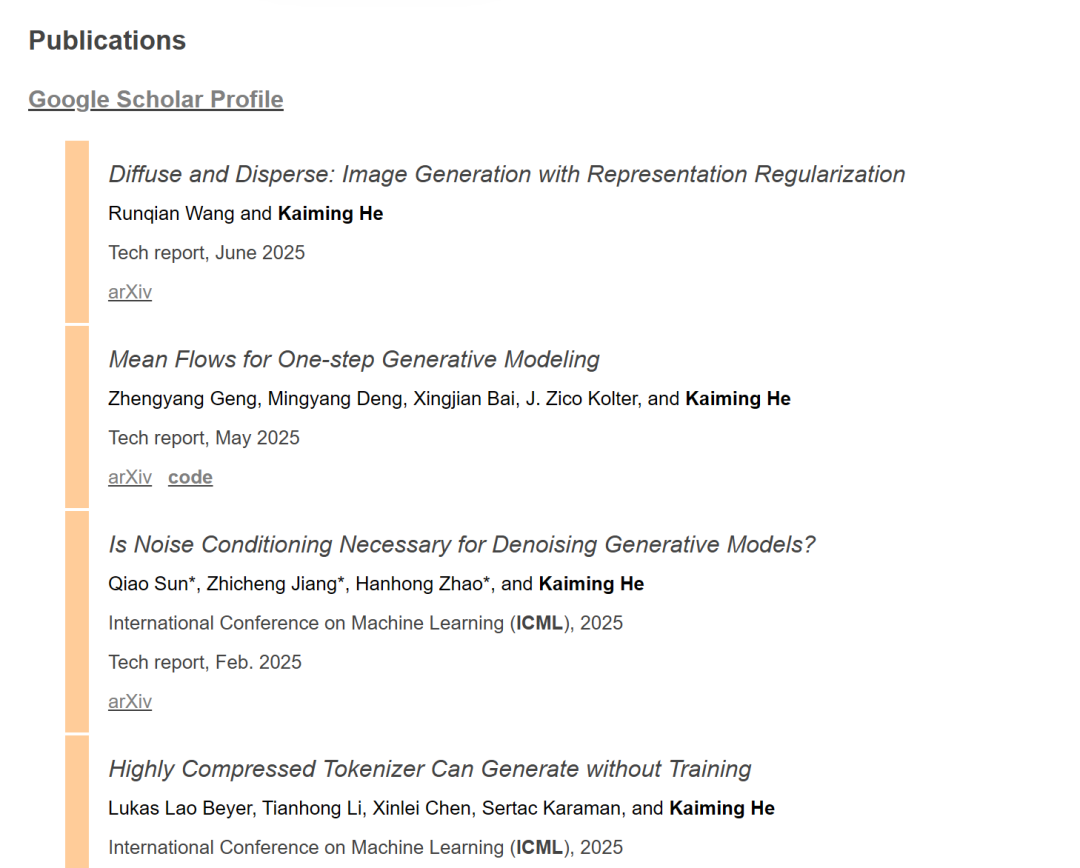

近来其研究主要集中在模型性能优化上,包括提出通过正则化表示(Representation Regularization)来改进图像生成技术、开发高度压缩的Tokenizer来实现在未经训练的情况下生成文本等等。

一言以蔽之,不管身份如何转变,他始终在CV领域持续深耕。

和谷歌团队多有合作

事实上,何恺明和谷歌其实多有合作。

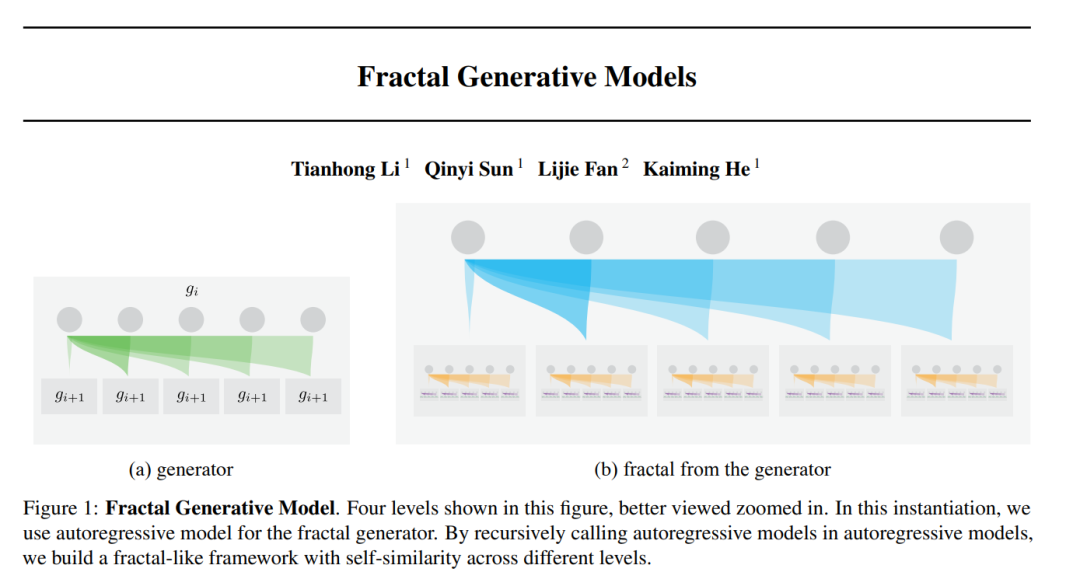

就在今年2月,他还和谷歌DeepMind全华人班底(黎天鸿、Qinyi Sun、范丽杰)开辟了生成模型的全新范式——

合发论文《Fractal Generative Models(分形生成模型)》,首次使逐像素生成高分辨率图像成为可能。

具体而言,团队提出用参数化的神经网络作为分形生成器,从数据中学习这种递归法则,实现对高维非序列数据的建模,也可用于材料、蛋白质等。

结果在「逐像素图像生成」这一任务中表现出色。目前相关成果代码已开源。

此外,去年其团队还和谷歌DeepMind合作,提出了一个基于连续标记的随机顺序自回归模型——Fluid。

他们所要解决的问题是:视觉自回归模型的Scaling,往往不像在语言模型里那样有效。

而通过合作,他们为自回归文生图模型的扩展指出一个方向:

-

基于连续token的模型比离散token模型在视觉质量上更好 -

随机顺序生成与光栅顺序相比在GenEval测试上得分明显更好

更多研究在此不再枚举,总而言之,何恺明和谷歌DeepMind团队实则早有接触。

因此这一次他选择和DeepMind合作,也可谓老熟人之间的强强联手。

(文:量子位)