这可真是第三代AI智能硬件了。

第一代、第二代都有给大家推荐过,第三代肯定不能缺席,毕竟这么好落地的AI硬件不多见。

第一代是小智做的那种,轻智能对话;第二代是完全开源了服务端,能自定义一些功能了。

今天给大家讲的是第三代,EchoEar 喵伴。

会听、会动、会陪伴,支持MCP,还能像小爱同学那样控制智能家居。

扫码加入AI交流群

获得更多技术支持和交流

(请注明自己的职业)

项目简介

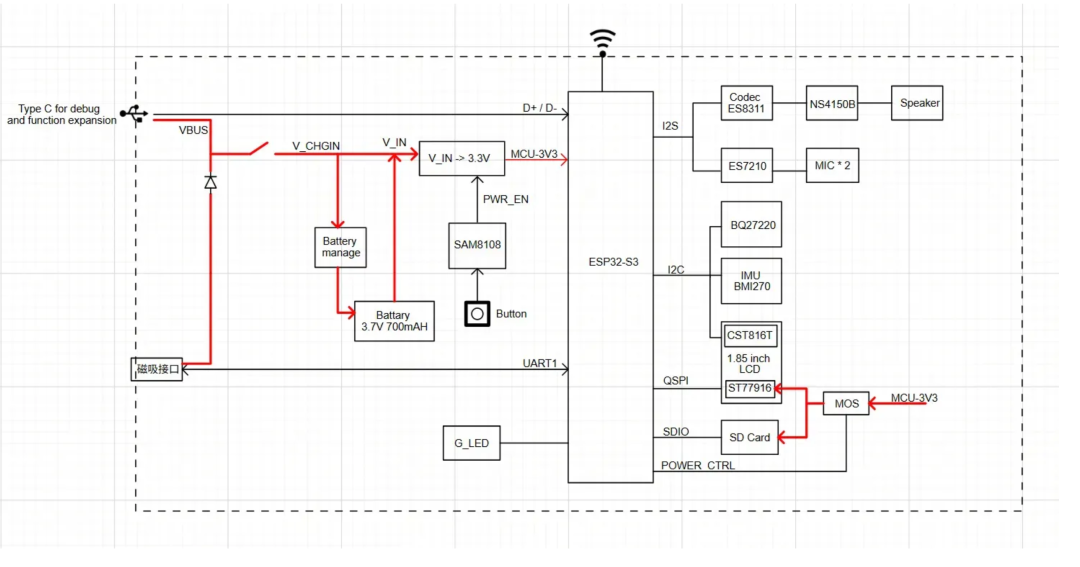

EchoEar(喵伴)是乐鑫携手火山引擎扣子大模型团队打造的智能 AI 开发套件。搭载 ESP32-S3 模组,配备双麦阵列、1.85 寸触摸屏,支持离线语音唤醒、声源定位,结合火山引擎豆包大模型能力,可实现全双工语音交互、情感识别与长记忆功能,还能通过自定义语音角色、MCP 协议对接智能设备,适用于玩具、智能音箱等语音交互类产品开发,为开发者提供完整端侧 AI 应用体验。

DEMO

功能介绍

语音交互与情感识别

-

基于火山引擎扣子实现全双工语音对话,支持语义理解、上下文语境分析,可主动识别用户意图与情绪(如语气、词义),通过动态表情和拟人化语音反馈响应。

-

支持自定义语音角色,可 DIY 音色(如邻家少女、湾区大叔)与风格,打造个性化 AI 形象。

离线语音唤醒与声源定位

长记忆与个性化体验

记录多轮对话内容,记忆用户姓名、偏好等核心信息,后续交互中调用以实现个性化响应,强化 “情感陪伴体” 定位。

智能家居控制

支持 MCP 协议与 Function Call 能力,可对接本地智能设备,实现远程控制、任务下发及状态反馈,作为智能家居本地控制中枢。

多模态交互硬件

-

搭载 ESP32-S3 模组,支持 2.4GHz Wi-Fi 和蓝牙 5.0,配备 1.85 寸圆形触摸屏(360×360 分辨率)与触摸传感器,支持直观操作。

-

双麦克风阵列 + 3W 扬声器,支持本地语音唤醒、180° 声源定位(结合舵机实现视觉对视),离线状态下也能响应指令。

-

内置 IMU 传感器,可感知用户动作与姿态,通过 “身体语言” 互动,增强沉浸感。

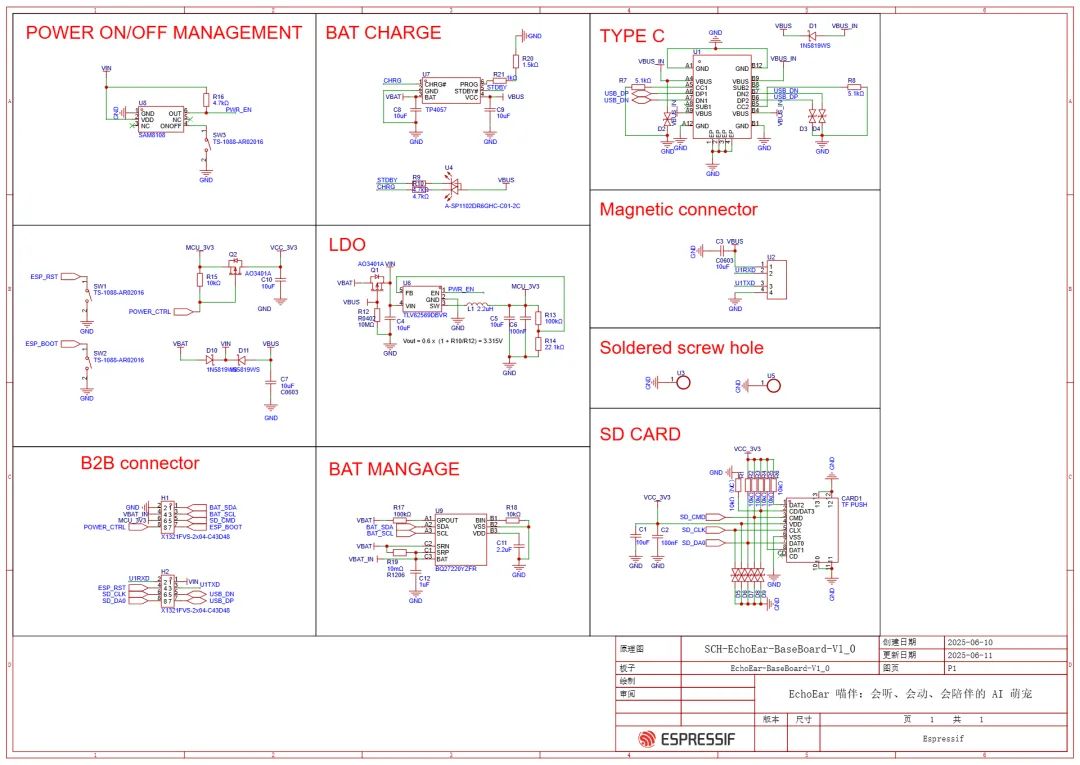

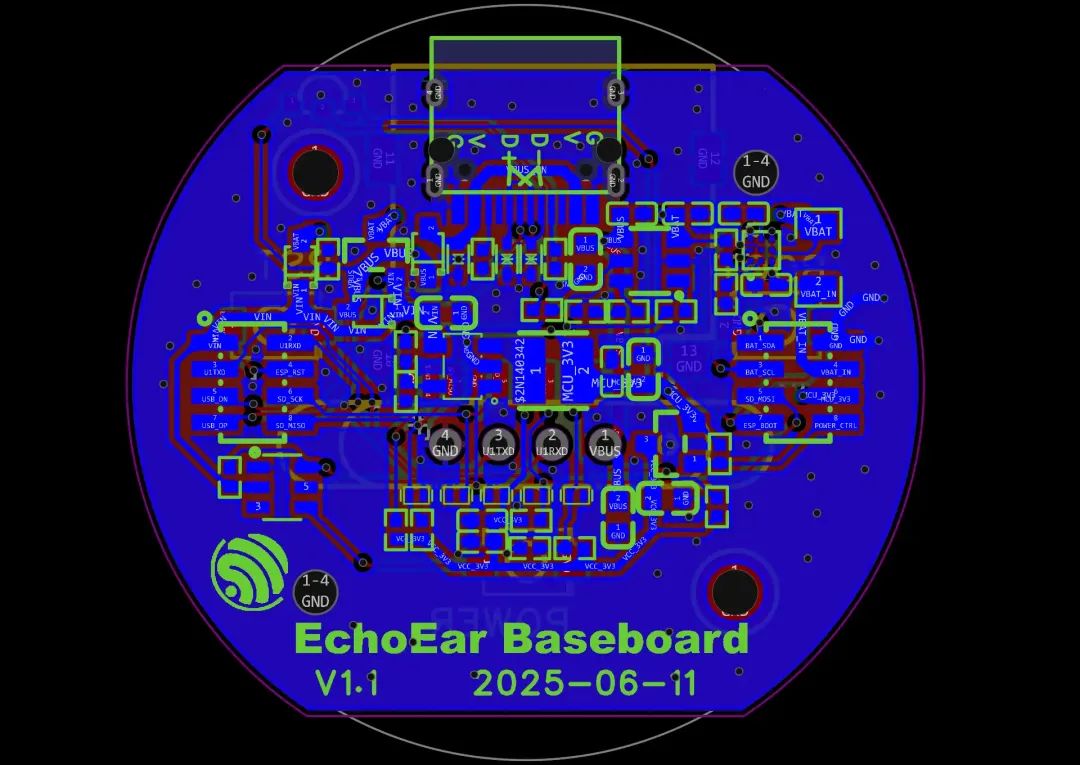

图纸

电路图

原理图

PCB

3D 结构爆炸图

具体的教程到网页里去看。

项目链接

https://oshwhub.com/esp-college/echoear

关注「开源AI项目落地」公众号

(文:开源AI项目落地)