在AI驱动的视频生成领域,多主体视频生成一直是技术难题,尤其是在保持多个主体的身份一致性和场景连贯性方面。

字节跳动最新开源项目 MAGREF 通过创新的掩码引导机制(Masked Guidance),实现了基于多样化参考图像和文本提示的连贯多主体视频合成。

MAGREF 是字节跳动开源的视频生成框架,基于Wan2.1扩散模型(I2V),采用掩码引导(Masked Guidance)和像素级通道拼接,生成多主体视频。

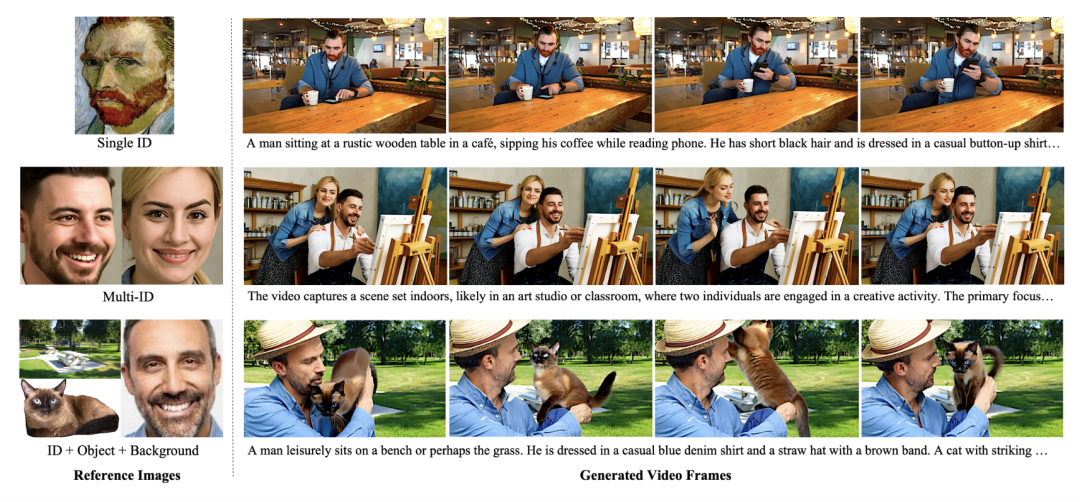

它支持单人、多人、人物+物体+背景组合,输入参考图像和文本提示,输出720p视频。

核心能力

-

• 多主体一致性控制:支持多人同场景出现、精确还原各自身份特征。 -

• 文本 + 图像混合控制:可用文字描述 + 图像精细控制主体行为与外观。 -

• 掩码引导机制:区域感知动态掩码,灵活处理多人、物体、背景,实现局部主体定向修改。 -

• 像素拼接:通道维度像素级拼接,保留主体外观特征。 -

• 高视频连贯性:生成画面自然,人物/物体动作流畅,时间一致性强。

Demo展示

单主体视频生成

一位女士坐在咖啡馆的露台上,享受着一杯茶。她穿着一件浅色的衬衫,头发扎成一个髻。她面前的桌子上摆着一小盘糕点,她慢慢地啜饮着杯中的茶,细细品味着这一刻。背景中繁忙的城市街道营造出一种既活泼又轻松的氛围,人们走过,远处传来汽车的鸣笛声。

多主体视频生成

两个人在室内环境中一起自拍。男人右手伸向前方,拿着智能手机拍照。他穿着一件浅灰色西装外套和一件白色衬衫。他旁边的女人有一头长长的金发,穿着一件白色上衣。两人都笑容满面,显得愉快并沉浸在当下。背景暗示他们身处现代办公室或类似的专业环境,可以看到中性色调和绿色植物。光线明亮均匀,可能是来自头顶的荧光灯,清晰地照亮了场景,没有刺眼的阴影。

主体+物品+环境组合视频生成

一位女士站在一家商店前,身穿一件简单的黑色宽松T恤,胸前有一个小标志。T恤搭配休闲装,她自信地站立,双手空空,环顾四周的场景。

写在最后

字节跳动在 AI 领域的动作越来越多样化,不论是其闭源或开源的成果,涉及音频、图像、视频、数字人、动作模仿等诸多方面,而且实际效果在主流AI模型中也是数一数二的。

如今开源的 MAGREF 多主体视频生成框架,给开源AI社区注入了新的活力。

无论你是内容创作者、研究人员,还是开发者,MAGREF 都可以成为你构建未来“AI 视频宇宙”的理想底座之一。

GitHub 项目地址:https://github.com/MAGREF-Video/MAGREF

● 一款改变你视频下载体验的神器:MediaGo

● 字节把 Coze 核心开源了!可视化工作流引擎 FlowGram 上线,AI 赋能可视化流程!

● 英伟达开源语音识别模型!0.6B 参数登顶 ASR 榜单,1 秒转录 60 分钟音频!

● 开发者的文档收割机来了!这个开源工具让你一小时干完一周的活!

● PDF文档解剖术!OCR神器+1,这个开源工具把复杂排版秒变结构化数据!

(文:开源星探)