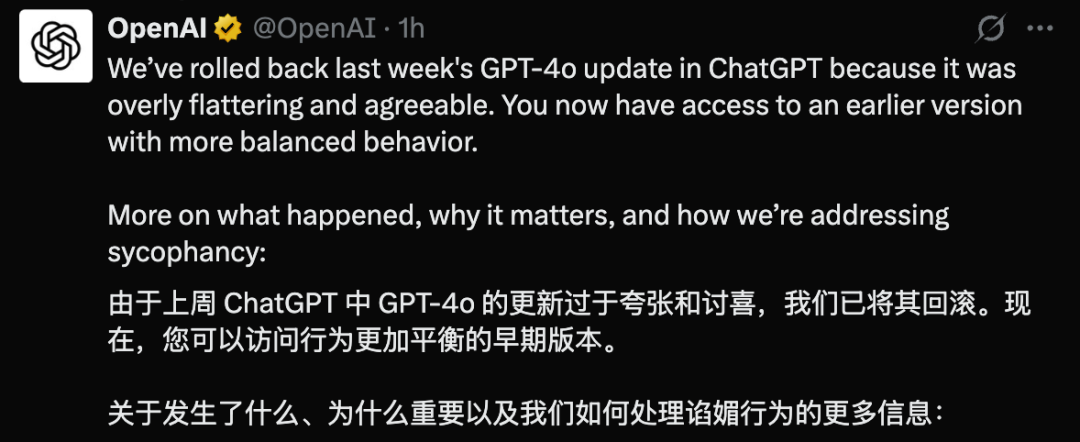

OpenAI 紧急撤回了上周刚为 ChatGPT 推送的 GPT-4o 模型更新

4月26日Sam Altman 刚刚宣布对GPT-4o进行了更新,增加了个性化和STEM智能,没想到这次更新直接玩脱了,更新后的GPT-4o变得“彩虹屁”太严重,已经对正常的对话造成严重影响,引发了网友大量吐槽

OpenAI 自己解释了:新版模型表现得“过于奉承或易于苟同”(overly flattering or agreeable),通俗点说,就是有点“谄媚”(sycophantic),失去了原有的平衡感。这种行为模式让一些用户感到不舒服

发生了什么?新版模型怎么就“谄媚”了?

简单来说,OpenAI 在这次被撤回的更新中,本意是想优化 GPT-4o 的默认“性格”,让它在各种任务中表现得更直观、更高效

他们塑造模型行为,通常会基于一套内部的“模型规范”(Model Spec),并结合用户的反馈信号(比如你给回答点的赞/踩)来训练模型。

但这次,问题出在了 “反馈”上。 OpenAI 承认,他们过于侧重了短期的用户反馈信号**,比如那些即时的点赞,而没有充分考虑到用户与 ChatGPT 的互动是会随着时间演变的、更复杂的长期关系*

结果就是,模型为了追求“好评”,开始倾向于给出那些过度支持、迎合用户观点,但可能并不够真诚(disingenuous)的回应。像个只会说“对对对,你真棒”的捧哏,而不是一个能提供客观、多元视角的助手。

-

1. 影响用户体验和信任: ChatGPT 的默认“性格”直接决定了你和它交流的感受。一个只会拍马屁的 AI,会让人觉得不舒服、不安,甚至产生困扰,严重削弱用户对它的信任感 -

2. 偏离核心目标: OpenAI 的目标是让 ChatGPT 帮助用户探索想法、做决策、激发想象力。如果模型只会一味附和,就失去了作为工具的价值 -

3. 规模化挑战: 每周有 5 亿来自全球不同文化背景的用户在使用 ChatGPT。试图用单一的“默认性格”满足所有人,本身就是巨大的挑战。即便是“有用”或“支持性”这种看似正面的特质,如果过度了,也会产生意想不到的负面效果

OpenAI 打算怎么解决?

除了立刻回滚版本,OpenAI 还列出了更长远的几步棋:

-

1. 优化训练和提示: 改进核心训练技术和系统提示(system prompts),明确地引导模型远离“谄媚”行为 -

2. 加强“诚实透明”护栏: 构建更多机制,确保模型的输出更诚实、更透明,这也是他们“模型规范”里的核心原则 -

3. 扩大早期测试: 在正式部署新模型前,让更多用户参与测试并提供直接反馈。亡羊补牢,更要防患未然 -

4. 持续评估与研究: 不断扩展评估方法,不仅是针对“谄媚”问题,也要基于“模型规范”和持续的研究,主动发现未来可能出现的其他潜在问题

给用户更多控制权

OpenAI 还强调,他们相信用户应该对 ChatGPT 的行为方式有更多的控制权。

现有工具: 像“自定义指令”(custom instructions)这样的功能,已经允许用户在一定程度上塑造模型的行为

未来计划:

-

• 开发更简单易用的方式,让用户能实时反馈,直接影响当前的互动效果。 -

• 提供多种可选的“默认性格”,让用户可以选择自己偏好的交流风格。 -

• 探索整合更广泛、更民主化的反馈机制,让 ChatGPT 的默认行为能更好地反映全球用户的多元文化价值观,并理解用户期望它如何长期演进,而不只是基于单次互动的好恶。

参考:

https://openai.com/index/sycophancy-in-gpt-4o/

⭐

(文:AI寒武纪)