AIGC开放社区

AIGC开放社区

GitHub Copilot 精彩继续:探索基础架构与企业级管理新篇章!

GitHub Copilot Fridays 第三期和第四期聚焦基础架构工程师及企业用户管理专题,详细介绍GitHub Copilot如何提升开发效率、保障安全合规,并分享多方面应用案例。

OpenAI发布GPT-4.5:功能非常特殊,推理很贵

专注AIGC领域的专业社区关注微软&OpenAI、百度文心一言等大语言模型的发展。OpenAI发布了最新模型GPT-4.5,其最大的亮点是加上了‘情商’功能。GPT-4.5在情感识别和同理心表达方面表现出色,提升了与人类交互的自然度。

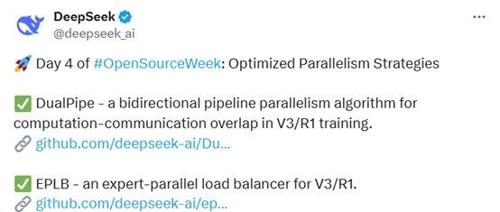

DeepSeek开源优化并行策略,提升训练和通信效率

专注AIGC领域的专业社区分享了开源优化并行策略DualPipe和EPLB。DualPipe用于V3/R1训练中减少流水线气泡,显著提高效率;EPLB通过动态调整专家负载保持平衡,避免通信开销增加。

免费获取微软《AI + CX 转型实战指南》!营销、销售、服务难题迎刃而解~

专注AIGC领域的专业社区,聚焦大语言模型(LLM)及客户体验。通过嵌入AI功能提升运营效率和客户满意度,帮助企业实现营销、销售和服务转型。

GPU效率暴涨!DeepSeek开源DeepGEMM,仅300行代码

DeepSeek开源高效FP8精度矩阵乘法库DeepGEMM,支持NVIDIA Hopper架构,在密集和分组矩阵乘法下性能提升显著,使用方便,支持广泛应用场景。