AI寒武纪

AI寒武纪

沉寂很久的Mistral AI推出号称世界最强OCR

Mistral AI 发布 OCR API Mistral OCR,具有顶尖的复杂文档理解能力、原生多语言支持、快速处理能力和结构化输出等六大亮点功能。

另一个来自中国本土”DeepSeek”时刻?全球首个通用人工智能代理发布

通用AI Agent「Manus」发布早期预览版,能自主完成从想法到执行的完整链路任务。它通过演示简历筛选、房产研究及股票分析等实际案例展示了其能力,并且已在多个平台解决真实商业问题。

重磅!2024图灵奖颁给强化学习两位大神,AlphaGo、ChatGPT,DeepSeek背后功臣!

重磅消息!ACM图灵奖揭晓2024年得主Andrew Barto和Richard Sutton因强化学习领域的奠基性贡献获奖。两位教授是AI核心技术——强化学习的先驱,推动了AlphaGo战胜人类围棋冠军和ChatGPT等技术的发展。

OpenAI 携手15 所顶尖高校成立 NextGenAI 联盟,加速 AI 教育与科研!

OpenAI成立NextGenAI联盟,集结15所顶尖研究机构,目标是利用AI加速科研突破与革新教育模式。OpenAI承诺投入5000万美元资金及工具支持。

MIT再出王炸!全新自学习AI框架PRefLexOR:让AI像人一样深度思考,自主进化!

MIT教授Markus J. Buehler团队提出的新自学习AI框架PRefLexOR能够像人类一样进行深度思考和自主进化。它通过迭代的推理改进自我学习,具有记忆、微生物修复和自进化系统等特性。

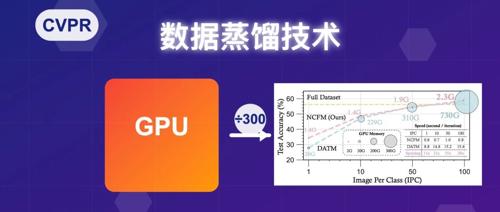

上交CVPR 满分论文数据蒸馏技术,直接把 GPU 显存 “砍掉” 300 倍

一项研究提出了一种新的数据集蒸馏方法NCFM (Neural Characteristic Function Matching),大幅提升了性能并实现了资源效率的飞跃。它通过引入神经特征函数差异度量指标,解决了现有方法的局限性,仅需2.3GB显存即可在单张GPU上完成CIFAR-100无损蒸馏,并显著超越了现有的SOTA方法。

GPT4.5性价比堪忧,OpenAI深陷麻烦

OpenAI 最新发布的人工智能模型 GPT-4.5 因高昂成本和未能显著提升性能而受到质疑。其竞争对手DeepSeek等正在蚕食市场份额,导致盈利困难。此外,OpenAI面临人才流失、财务压力及领导力受质疑等问题。尽管首席研究Mark Chen表示GPT-5将取得重大突破,但现状仍需关注。