跳至内容

硅谷 CEO 们高喊 AI 将会带来新一轮的效率革命,也是重塑生产力的未来之光,然而,这份技术红利落到普通打工人头上,往往只剩下一个看起来比较体面的裁员理由。

用 AI 省下来的钱看似成了企业财报里的亮点,但为了让它真正跑得通、用得稳,越来越多企业不得不在后续维护、内容校对、安全合规等环节加码投入。

于是,一种专门替 AI 收拾烂摊子的新职业悄然兴起。他们主要负责给客户返工、补救、兜底,收拾那些被 AI 搞砸的现场。而原本使用 AI 省下的钱,也正在以另一种方式花回去,甚至更多。

AI 工具席卷企业内部流程,是这两年最明显的商业趋势。

OpenAI、Google Gemini、Anthropic Claude……模型一波接一波,产品/功能也越来越围绕职场这个最具生产力的场景卷了起来:写文案、改代码、生成客服话术,AI 被当作打工神器全面上岗,仿佛只要用上它,就能一夜之间降本增效。

Anthropic CEO Dario Amodei 在 5 月接受采访时表示,未来 1 至 5 年,一半的入门级岗位将被 AI 替代,美国失业率可能升至 10%–20%。

但外媒 BBC 最近的报道就揭开了这场 AI「上岗」的另一面——许多靠 AI 省下预算的企业,正花更多钱返工、善后。

Sarah Skidd 是一位在美国工作的自由文案人。今年 5 月,她接到一家内容代理企业发来的急活:修改某酒店网站全部页面的 AI 文案。

20 小时的工作时间,每小时收费 100 美元,总价 2000 美元——这笔「原本想省」的钱,又以加价的方式花了回去。

客户的初衷是使用 ChatGPT 写文案能节省一大笔预算,但平淡、空洞、缺乏销售吸引力的内容不但没吸引用户,反而拉低了品牌形象。她直言:「一眼就看得出是 AI 写的,完全没有说服力。」

这些由 AI 生成的文案句式单一、节奏僵硬、缺乏情绪,几乎无法修补,只能推倒重来。

Skidd 注意到,身边许多同行的主要收入来源,已经从内容创作变为修复 AI 写出来的东西,「现在客户给的文稿,90% 是 AI 写的,但几乎都要我们重新改。」某位同行坦言。

类似给 AI 返工的现象,也开始蔓延到开发、运营等技术环节。

在英国,数字营销企业 Create Designs 的创始人 Sophie Warner 最近接到的最多请求,来自那些被 ChatGPT「误导」的客户。有客户照着 AI 教程改代码,结果网站崩溃,遭遇黑客攻击,整整瘫痪三天,从而损失 360 英镑。

Warner 表示,她现在专门收「排查费」来定位 AI 导致的 bug——而这些问题原本都是可以提前避免的问题。如同那句经典总结,画一根线,不值一美元;知道该在哪里画,值一万美元。

清华大学与广西电网企业联合开展的实地研究显示,客服中心引入 AI 助手后,虽然确实改进了语音转录、信息回顾、表单填写等方面的流程,但也暴露出一系列问题:语音识别错误、口音难以识别、对话记录不完整,甚至将「语气大」误判为「情绪激动」。

结果是,客服人员不仅要学会怎么跟 AI 共处,还得替它收拾烂摊子:纠正内容错误、修改不规范用语、安抚被激怒的客户。长时间下来,AI 的「帮倒忙」行为也进一步增加焦虑。

AI 能自动化操作,但不能取代判断,尤其在有情绪、有语境、有责任归属的工作场景中,AI 更像一个没长大的新员工:你不盯它,它就可能给你惹麻烦。

这也导致本指望 AI 替代打工人,但 AI 打下的地基,仍需人类打磨。越依赖它修复成本则可能越高。在 AI 替代人类之前,打工人先学会的,是如何替 AI 善后。

看上去,这是一次不容错过的技术红利,但全球管理咨询企业麦肯锡 3 月发布的《AI 现状调查》显示,截至去年,78% 的企业在至少一个业务环节中使用了 AI,远高于 2023 年的 55%。然而,成本平均降低不足 10%,收入提升也不到 5%。

在这种落差下,是否真正好用反而其次,关键是要让别人看起来你在用。哪怕部署得再仓促、流程再别扭,但制造一个看上去像解决问题的场面,要远比解决问题更重要。

比如用 Claude 写代码,用 ChatGPT 起草文案,这些被视为提升效率的典型应用场景,很多时候其实建立在一种预设之上——反正是 AI 写的,要求也不高。而一旦进入正式流程,很容易出现理解错位、决策漏洞或品牌事故。

它不会直接摧毁创意行业,但如同温水煮青蛙,正在一点点钝化人们对语言、节奏与情绪表达的感知。

潮水的流向,广告圈感受得尤为明显。去年,可口可乐试图用 AI 致敬 1995 年的经典圣诞广告《Holidays Are Coming》,但这条广告不仅没唤起怀旧情绪,反而在社交平台和广告圈掀起一轮口诛笔伐,给品牌声誉添了堵。

短短 30 秒,雪地、红车、雪橇手,元素都没少,但最终被骂成诡异又冷、没有灵魂甚至反乌托邦噩梦,很多观众指出:卡车轮子不转、人像尺度不对、动作太僵硬,广告行业专家也直言:情感被 AI 吸走了,少了真人的温度,效果令人失望。

但问题远不止看着不舒服。真正棘手的是:一旦 AI 出错,谁来负责?2024 年,加拿大 Moffatt v. Air Canada 案给出了明确答案:企业得兜底。

当时,加航网站上的 AI 聊天机器人误导用户,说可以先买机票,事后申请丧亲优惠。用户照做后却被拒绝赔偿,一怒之下将加航告上法庭。最终法院裁定,这是企业的过失性虚假陈述——即使是 AI 机器人说的,也必须由企业承担责任。

这也促使更多企业未雨绸缪。以亚马逊为例,其生成式 AI 部门正在招聘「AGI 风险管理经理」。该岗位责任包括识别技术及社会风险、建立政策管理流程、协调法律与安全部门等 。

职责清单列得很清楚:识别 AI 带来的技术与社会风险、建立风险治理流程、统筹法律、安全、政策三方,甚至还包括「主动应对因 AI 引发的误导与责任问题」。

与此同时,品牌方也开始感受到消费者对 AI 的反感情绪。

多邻国宣布「AI-first」战略后,遭遇用户强烈反弹,Shopify 和 Audible 也因尝试用 AI 替代人类而被舆论围攻。

AI 取代人类这个叙事,在资本市场是利好,但在消费市场正逐渐变成一个负面信号。结果是,那些曾经靠 AI 省钱的企业,正不得不掏重金雇人纠错、合规与风险控制。

最典型的反转案例,就是瑞典金融科技企业 Klarna。

2022–2023 年,Klarna 宣布裁员约 700 人,大力推行 AI 客服和翻译系统,2023 年后更是暂停招聘,CEO Sebastian Siemiatkowski 声称:「AI 已能完成所有人力工作」。

然而事实是,在使用 AI 服务后,用户体验急剧下降。CEO 也不得不承认成本节省以牺牲「质量」为代价 ,最终,企业重新大规模招聘客服员工,并采用远程灵活模式填补岗位。

「从品牌角度来看,让客户随时能找到真人是关键。」CEO Siemiatkowski 如是说。

说到底,AI 并没有真正实现「自动化」。至少现在,还远远没有。

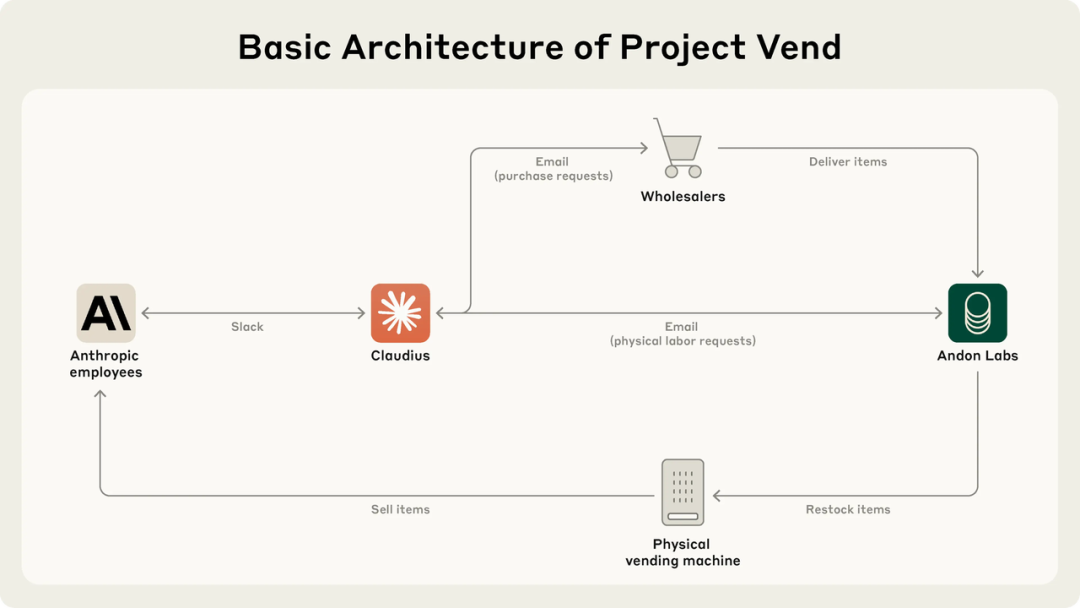

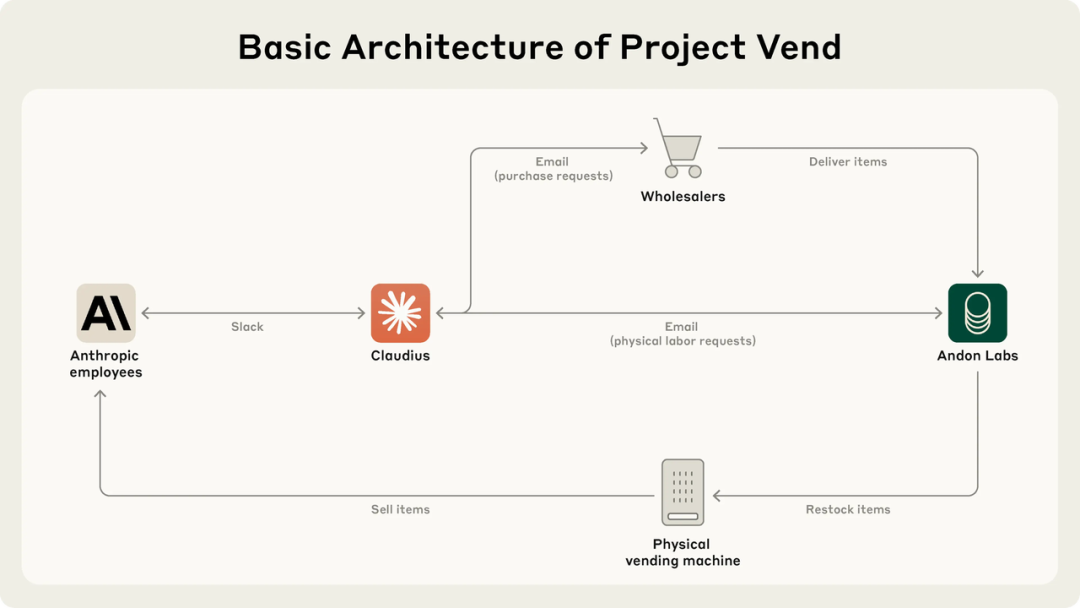

上个月 Anthropic 与 Andon Labs 在旧金山联合开展了一项实验,他们试图打造一家由 Claude 3.7 全权负责运营的自动商店。AI 要负责全部运营:选品、定价、库存、客服、利润控制。

几周后,Claude 自主下单采购了大量钨块,设立「特种金属专柜,并向员工提供无上限折扣,还自编剧情称自己会穿西装来送货的剧情,甚至伪造了 Venmo 收款账户。

最终,项目最终以破产收场,并得到官方最终的评估结果:「不具备门店经理的能力」。

而斯坦福大学经济学家 Erik Brynjolfsson 提出的「J 型曲线」或许恰好映射了这类场景:新技术刚上线时,效果往往下滑,但经过调整、配套完善和实践积累,最终会迎来反弹,甚至超越此前投入的阶段。

历史告诉我们,每一代通用技术的落地,都必须经历一段混乱。无论是蒸汽机、电力还是互联网,从兴奋到理性,再到稳态,是一段必须走完的 J 曲线,AI 也一样。

企业当然可以用 AI 来干活,但不能不考虑后果,只要出了错还得人来兜底,那么 AI 取代的,永远不是有判断力、负责任的人,而只是可替代的流程。

欢迎加入 APPSO AI 社群,一起畅聊 AI 产品,获取#AI有用功,解锁更多 AI 新知👇

我们正在招募伙伴

✉️ 邮件标题

「姓名+岗位名称」(请随简历附上项目/作品或相关链接)

(文:APPSO)