▍触觉仿真模型的挑战

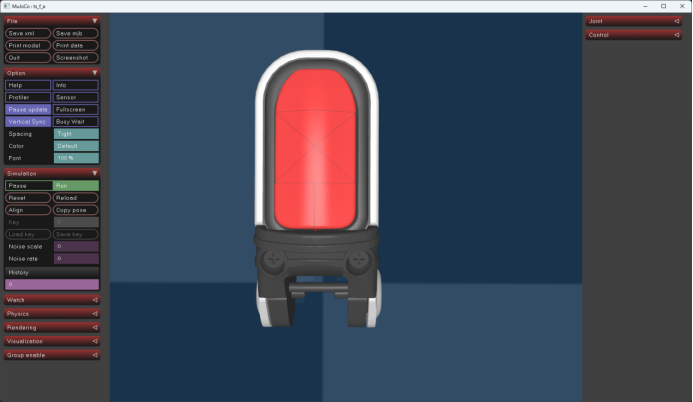

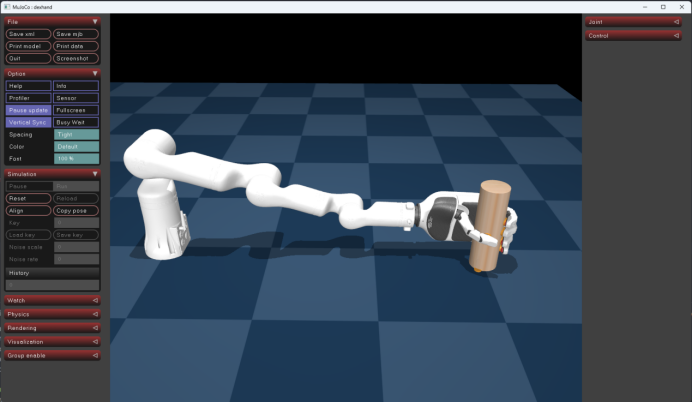

当前,机器人在执行复杂任务时,因缺乏精准触觉感知,常面临抓取不稳定、操作失误等问题,这使其在精密装配、物体操控及与环境交互等场景中的表现大打折扣。触觉模拟仿真技术能够提前在虚拟环境中构建触觉模型、模拟触觉交互并进行算法训练,从而为机器人触觉感知能力的提升提供关键支持,对拓展机器人应用领域、增强其自主性和智能化水平具有不可或缺的作用。

▍技术创新与路径优化

▍应用价值与开源合作

他山科技的触觉模拟仿真技术可以支持用户几乎零成本地引入触觉感知训练自己的模型。可以在工业和服务机器人领域得到广泛应用。在工业领域,该技术将提升机器人的操作精度和灵活性,降低生产误差和次品率。在服务领域,使机器人能够更自然地与人类互动,提供高质量的服务。

来源:他山科技

(文:机器人大讲堂)