大模型无限记忆外挂来了!

supermemory 公司刚刚发布 Infinite Chat API,能让任何 LLM 都具有近乎无限的上下文长度

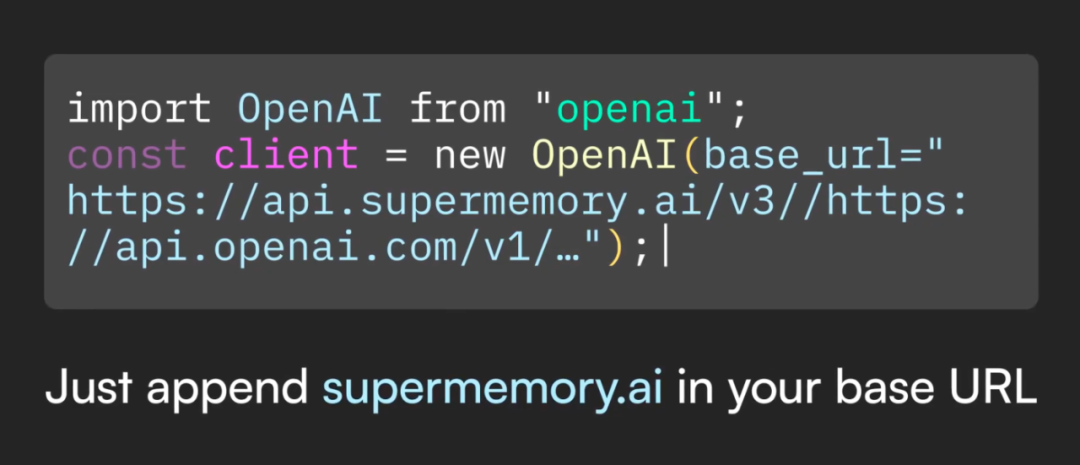

用户只需一行代码即可切换到该 API

核心痛点:LLMs的上下文“天花板”

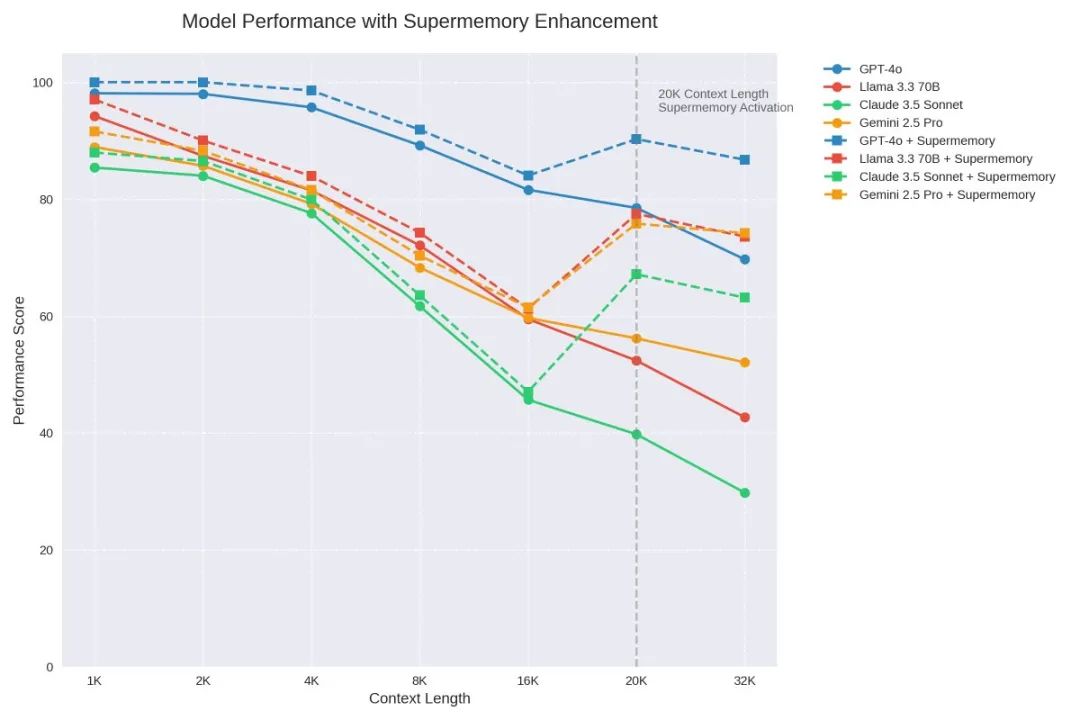

我们都知道,现有的大模型在处理超过2万Token(甚至更少)的长文本时,性能往往会显著下降,出现“失忆”、理解偏差等问题。这极大地限制了它们在需要持久记忆和深度上下文理解场景下的应用

Supermemoryai的解决方案:Infinite Chat API

Supermemoryai刚刚推出的Infinite Chat API,声称能完美解决这一难题

它的核心功能简单粗暴:

-

• 扩展任何大模型的上下文长度 -

• 同时,帮你节省高达90%的Token消耗和成本 -

• 还能提升模型的响应性能

如何工作的?

官方解释,Infinite Chat API充当了你的应用程序和LLM之间的一个透明代理。它会智能地维护对话上下文,只将当前交互最需要的关键信息精准地发送给LLM

本质上是对溢出的先前上下文进行RAG(检索增强生成)处理

集成便捷:“一行代码即可切换”,对现有应用改动极小

即刻可用:已经上线,可以马上试用

价格:

-

• 免费上手:提供免费试用额度 -

• 固定费用:试用期后,每月20美元固定费用 -

• 用量计费:在每个对话线程中,前2万Token免费,超出部分按每百万Token 1美元计费

感兴趣的朋友,可以去官网体验Demo和查阅文档:

Demo体验:

https://supermemory.chat

官方文档:

https://docs.supermemory.ai/infinite-chat

⭐

(文:AI寒武纪)