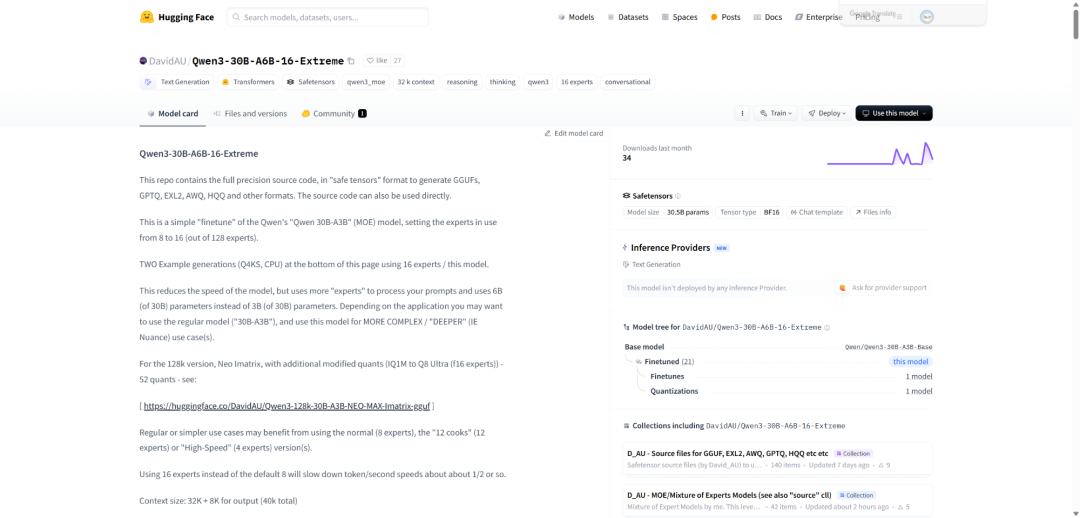

通过修改模型参数,把激活专家增加了一倍,于是A3B就变成A6B了。作者测试质量会有小提升。当然由于激活量变大生成速度会变慢。不过总体激活仍然是6B这种小规模还好。

当然,其实不用下载这个模型,自己修改 llama.cpp 的运行参数也行,只需要:–override-kv qwen3moe.expert_used_count=int:24

当然也可以反向操作,把 Qwen3-235B-A22B 调整激活量变成 A11B,进一步提升速度。

参考文献:

[1] 模型地址:https://huggingface.co/DavidAU/Qwen3-30B-A6B-16-Extreme

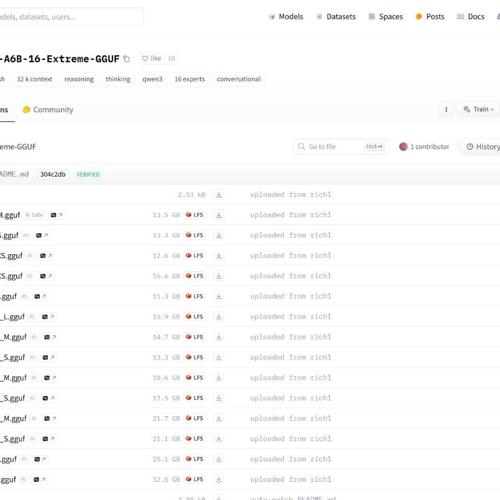

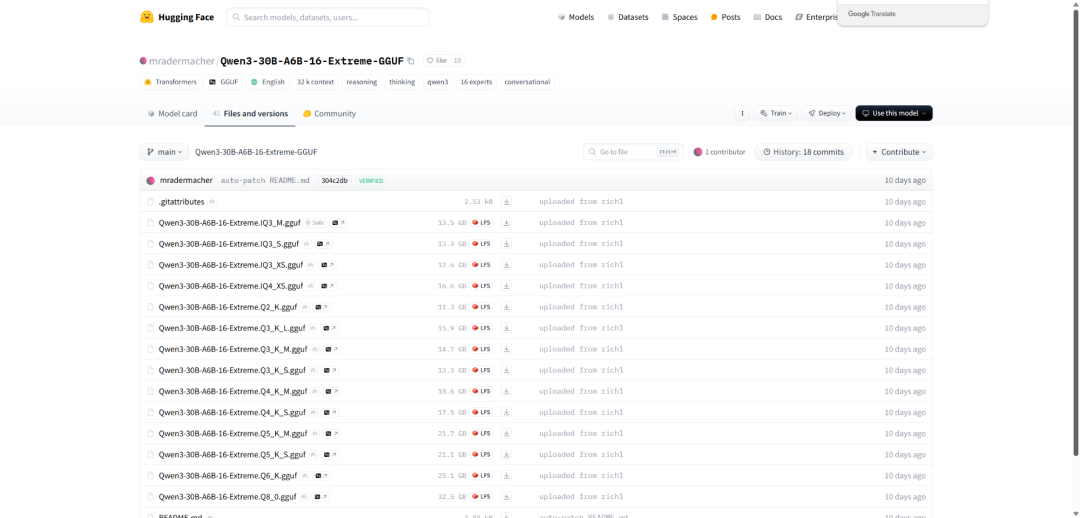

[2] 量化版本地址:https://huggingface.co/mradermacher/Qwen3-30B-A6B-16-Extreme-GGUF

知识星球服务内容:Dify源码剖析及答疑,Dify对话系统源码,NLP电子书籍报告下载,公众号所有付费资料。加微信buxingtianxia21进NLP工程化资料群。

(文:NLP工程化)