各位小可爱们,你们有没有觉得,谷歌的 Gemini 2.5 Pro 虽然很香,但它有一个致命的问题。

那就是太慢了,干点什么事都得 “思考” 个几秒钟才开始输出答案。

说个简单的“你好”,它也得思考个13.8秒,恨不得把你所有的内心戏都挖出来才肯开口。

当然,这是所有推理模型的 “通病”。

毕竟,推理模型之所以强,就是用响应时间来换质量。

它们能准确无误地回答 “9.11 和 9.9 谁大”,以及 “Strawberry 有几个 r” 的问题,却往往在简单问题上“想太多”。

DeepSeek 更是戏精中的戏精。内心戏极为丰富。

我常表达这样一个观点:术业有专攻,推理模型 天生就擅长数学、逻辑、推理、代码等复杂任务,所以更适合有难度的任务;而 “非思考”通用模型 则更适合相对更简单直接的任务,比如百科问答,AI 搜索,或者是 AI 翻译。二者各有所长,定位分明。

所以,当听说谷歌家的 Gemini 2.5 Flash 即将发布,内心是有点小期待的。

这是今天关于谷歌的第一个消息。

即将推出的 Gemini 2.5 Flash 是目前最强模型 Gemini 2.5 Pro 的弟弟版本,有点像是 o1 和 o1-mini 的关系。

据谷歌官方说,Gemini 2.5 Flash 依旧是一个推理模型,和 Claude 3.7 Sonnet Thinking 以及昨天刚发布的 Grok 3 Mini Beta 一样,支持用户自主控制推理强度,比如 可以分为 high、medium、low 等不同档位。

更更重要的,Gemini 2.5 Flash 主打低延迟(low latency)和性价比(cost-efficient)。

虽然现在还没正式推出,但也快了,大概率就在这两天。

关于谷歌的第二条更新来自 AI Studio。

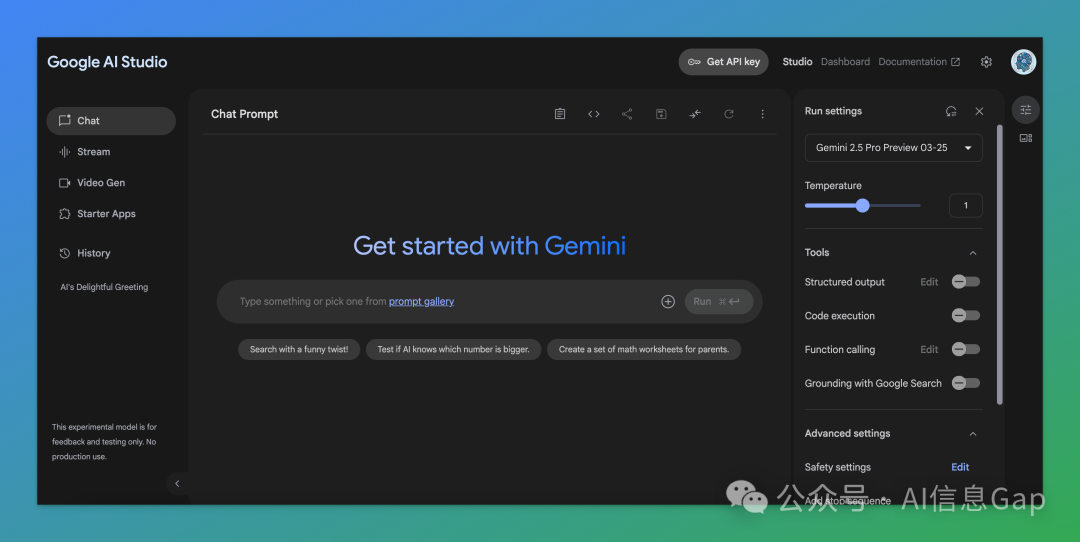

相信经常使用它的小伙伴已经看出来了,AI Studio 换新 UI 了!

最新的谷歌 AI Studio 长这样。

而它以前是这样的。

个人感觉,新界面更加干净清爽,页面各个元素的设计和排布也更加合理,易于上手。

新 UI 下的 AI Studio 更像是一款真正的 AI 产品了。

那么,新老界面,你更喜欢哪一个?欢迎评论区留言讨论一波。

别着急,文章还没完。

还有关于谷歌的第三条消息,挺劲爆的。

继 OpenAI 官宣拥抱竞争对手 Anthropic 推出的上下文协议(Model Context Protocol,简称 MCP)协议后,谷歌也迅速跟进。

昨天,谷歌 DeepMind 首席执行官 Demis Hassabis 发帖表示,谷歌也将在其 Gemini 模型及 SDK 中加入对 MCP 的支持。

MCP 是一个很好的协议,正在迅速成为 AI 智能体时代的开放标准。我们(谷歌)期待与 MCP 团队以及行业中的其他伙伴继续共同开发这一协议。

至此,MCP 协议在北美 AI “御三家” 收获了大圆满。

给不熟悉的小伙伴们科普一波。

MCP 就像一座“桥”,桥的一端连接着 AI 模型/工具,另一端是各式各样的第三方应用。有了这座桥,模型就能方便、快捷地找到它们需要的数据(俗称,上下文),从而更好地回答问题。

并且,这座桥是标准的、通用的,对谁都适用,这样就避免了需要为每个三方应用单独建桥的烦恼。

结语

多么美好的 AI 时代,就在当下。

而我们,恰逢其时。

我是木易,一个专注AI领域的技术产品经理,国内Top2本科+美国Top10 CS硕士。

相信AI是普通人的“外挂”,致力于分享AI全维度知识。这里有最新的AI科普、工具测评、效率秘籍与行业洞察。

欢迎关注“AI信息Gap”,用AI为你的未来加速。

(文:AI信息Gap)