现实世界版的 Genie-2?

-

论文标题:Navigation World Models -

论文地址:https://arxiv.org/pdf/2412.03572v1 -

项目地址:https://www.amirbar.net/nwm/

-

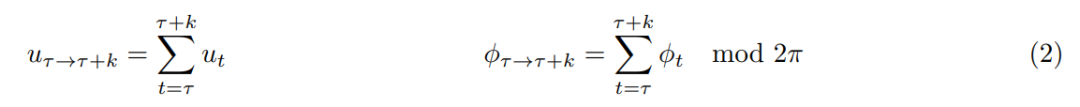

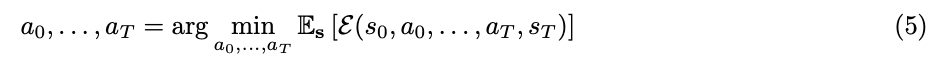

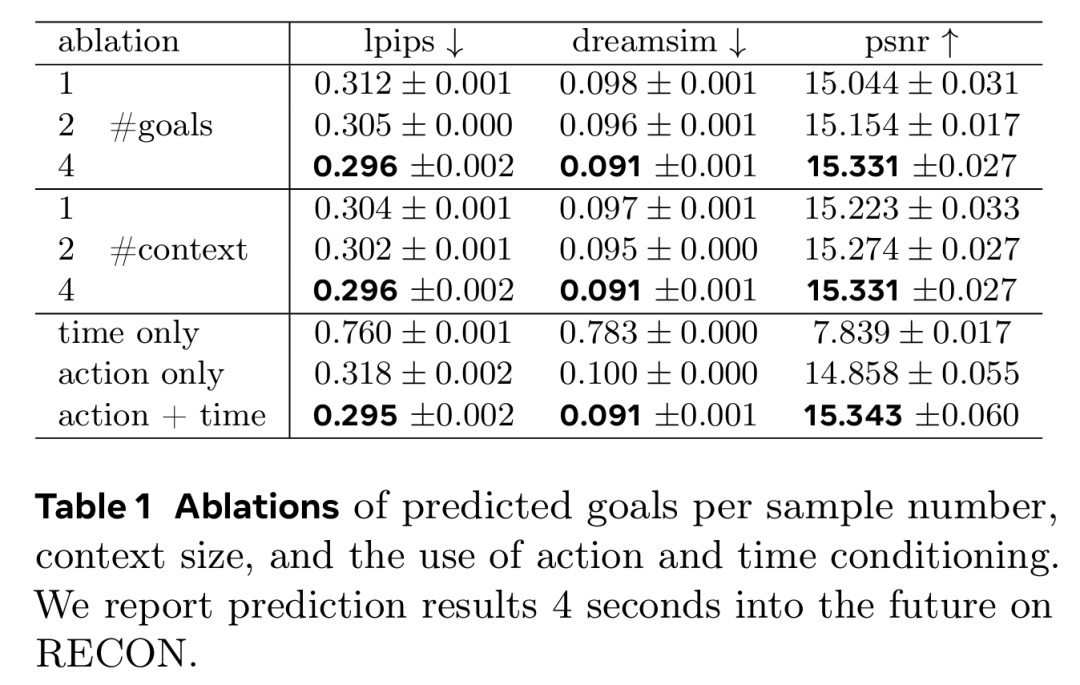

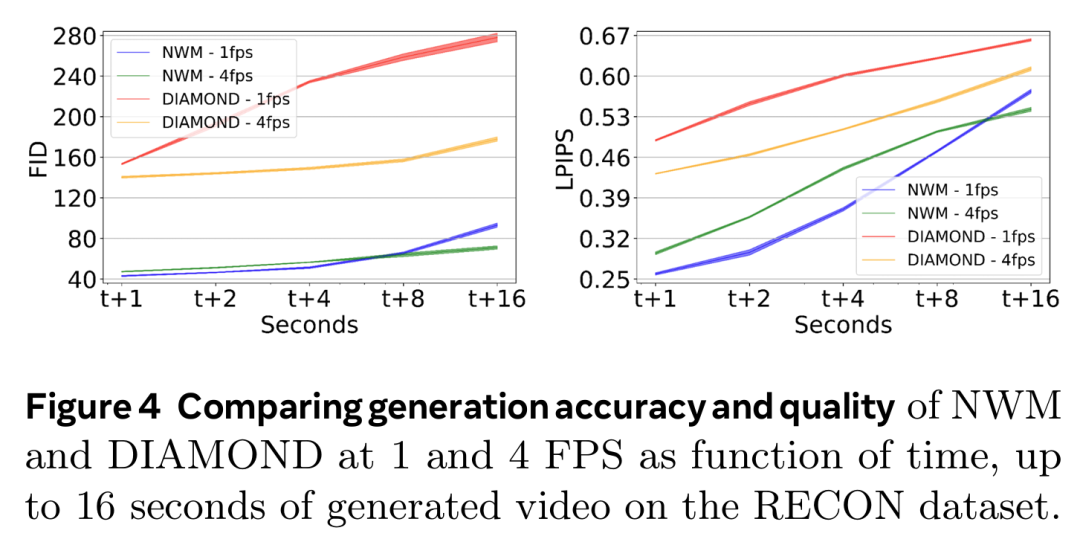

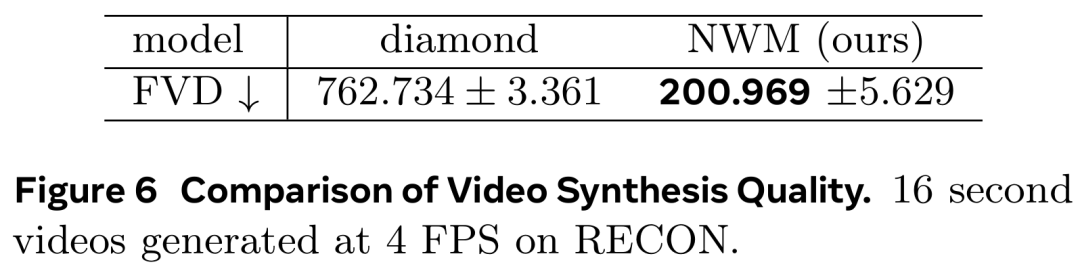

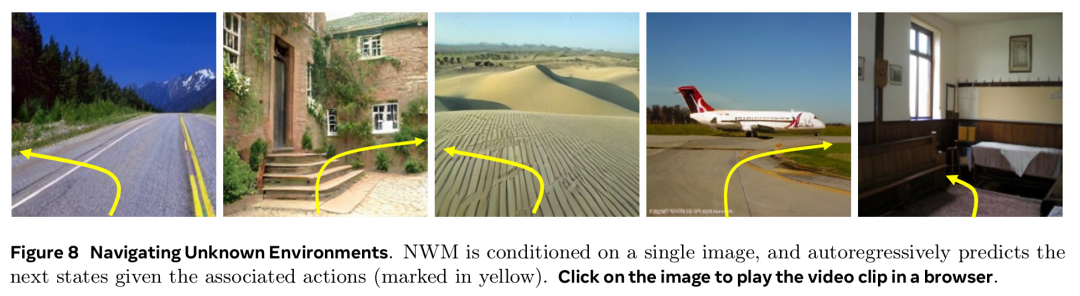

提出了导航世界模型和一种全新的条件扩散 Transformer(CDiT);相比于标准 DiT,其能高效地扩展到 1B 参数,同时计算需求还小得多。 -

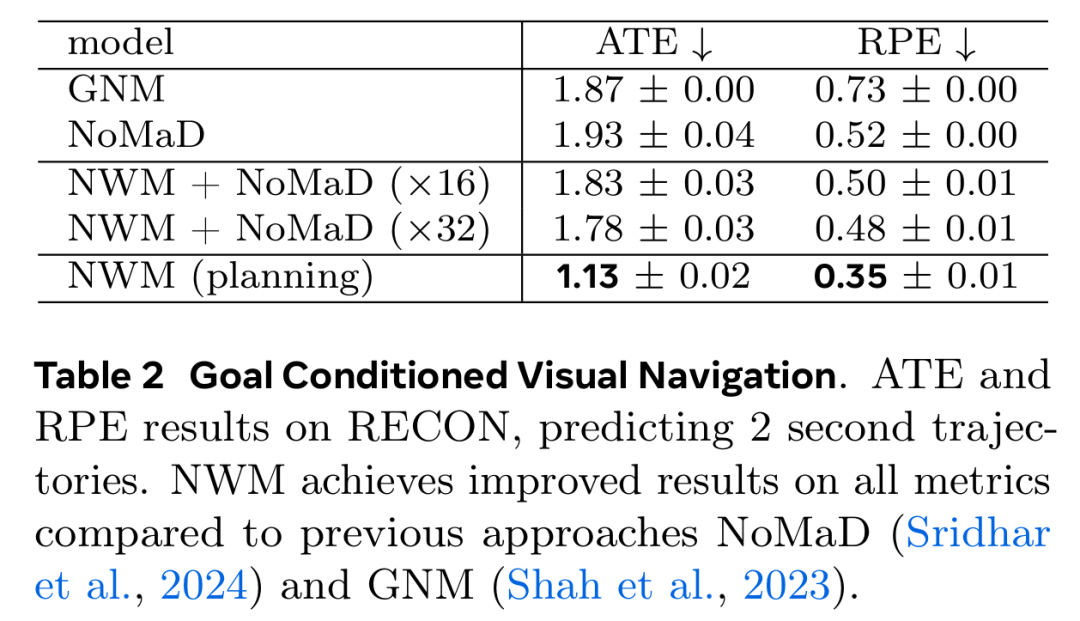

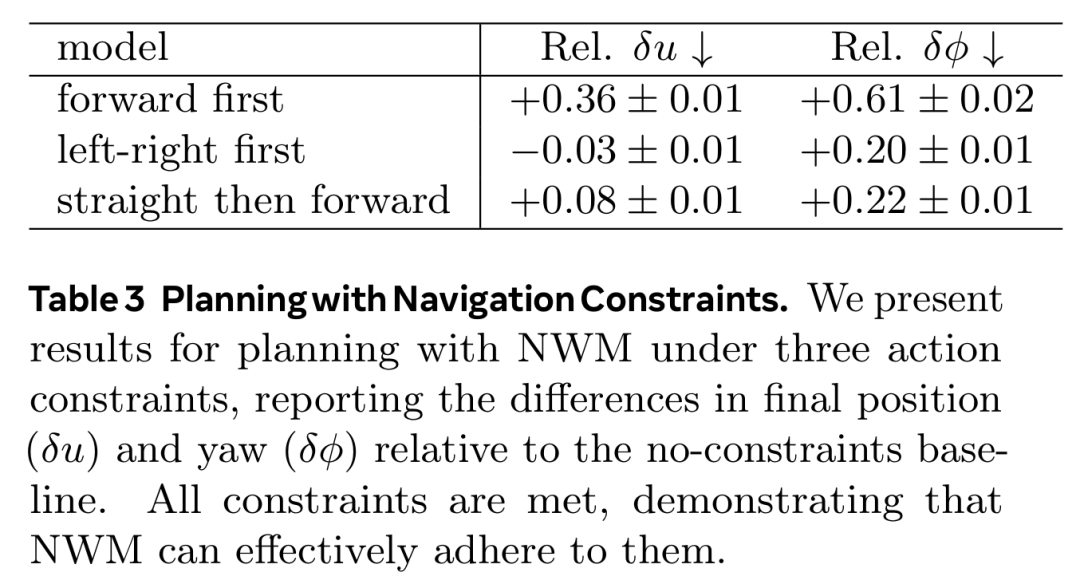

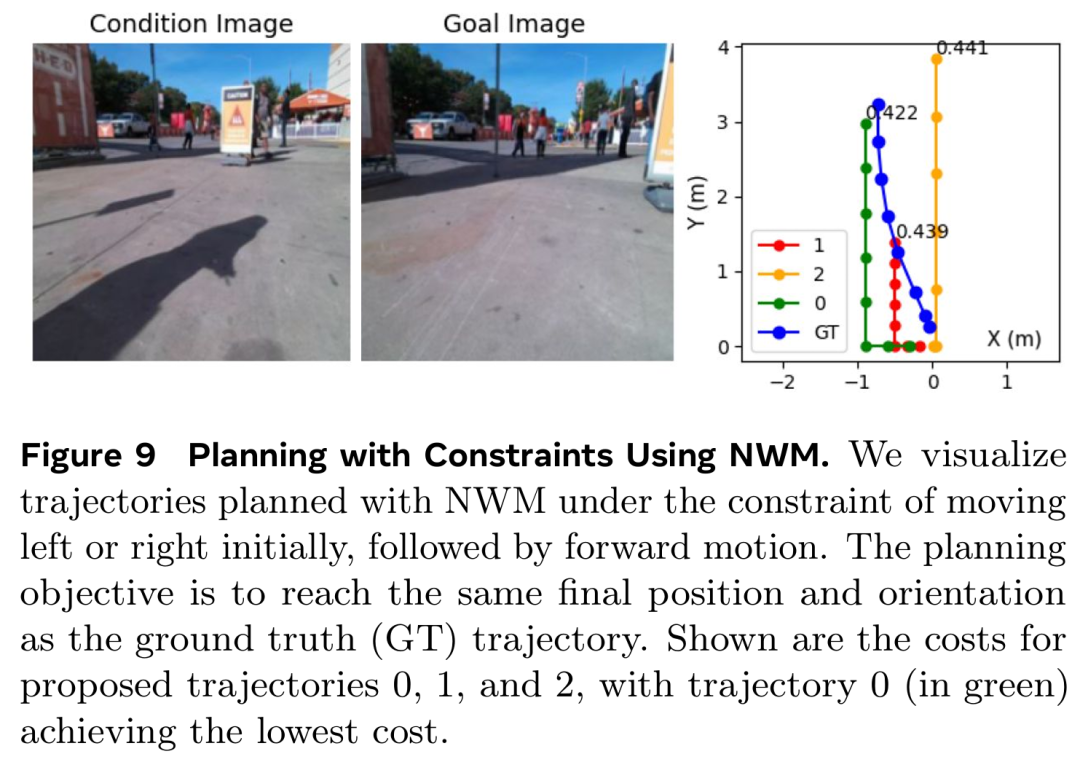

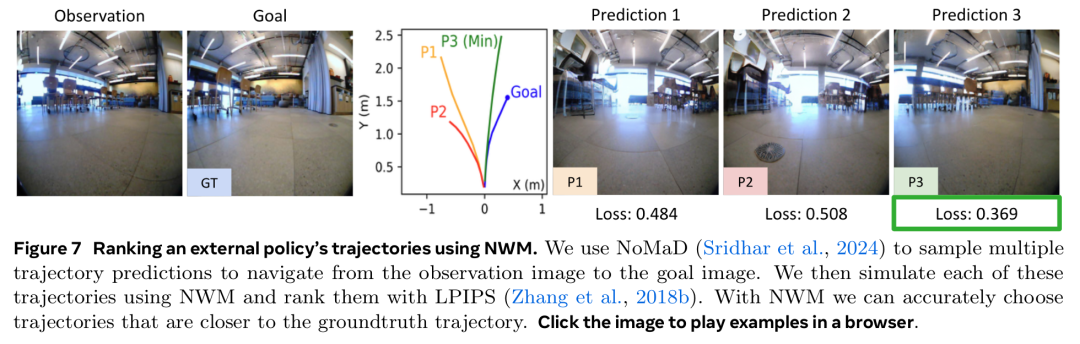

使用来自不同机器人智能体的视频和导航动作对 CDiT 进行了训练,通过独立地或与外部导航策略一起模拟导航规划而实现规划,从而取得了当前最先进的视觉导航性能。 -

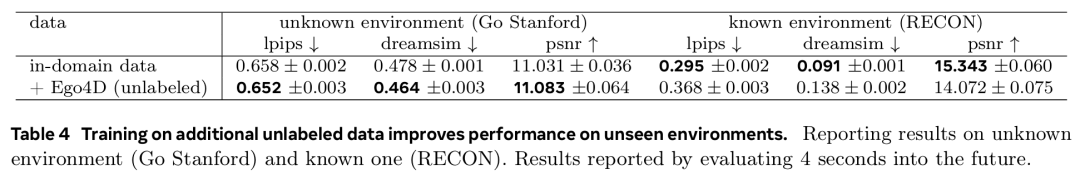

通过在 Ego4D 等无动作和无奖励的视频数据上训练 NWM,使其能在未曾见过的环境中取得更好的视频预测和生成性能。

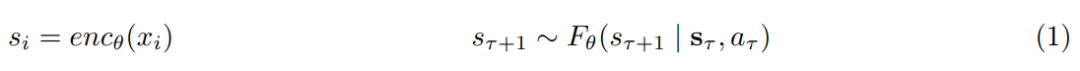

,其中

,其中  是图像,a_i = (u, ϕ) 是由平移参数

是图像,a_i = (u, ϕ) 是由平移参数  给出的导航命令,控制向前 / 向后和左右运动,以及导航旋转角

给出的导航命令,控制向前 / 向后和左右运动,以及导航旋转角  。a_i 的导航动作可以被完全观察到。

。a_i 的导航动作可以被完全观察到。

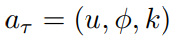

,因此现在 a_τ 指定时间变化 k,用于确定模型应向未来(或过去)移动多少步。因此,给定当前状态 s_τ ,可以随机选择 k, token 化相应的视频帧。然后可以将导航动作近似为从时间 τ 到 τ + k 的总和:

,因此现在 a_τ 指定时间变化 k,用于确定模型应向未来(或过去)移动多少步。因此,给定当前状态 s_τ ,可以随机选择 k, token 化相应的视频帧。然后可以将导航动作近似为从时间 τ 到 τ + k 的总和:

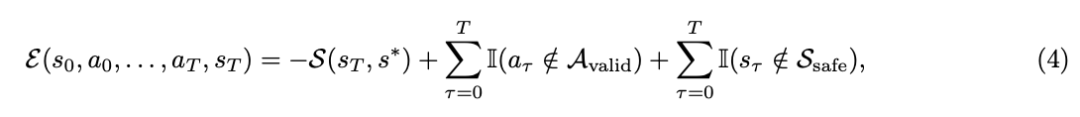

,使得最小化能量与最大化未归一化的感知相似度得分相对应, 并遵循关于状态和动作的潜在约束。

,使得最小化能量与最大化未归一化的感知相似度得分相对应, 并遵循关于状态和动作的潜在约束。

(文:机器之心)