极市导读

这篇论文是来自 UC Berkeley、TranscEngram、Microsoft Research 等机构的 Ziyang Wu 等人撰写的 “Simplifying DINO via Coding Rate Regularization”,核心是提出 SimDINO 和 SimDINOv2 模型,通过编码率正则化简化 DINO 和 DINOv2 训练流程,并提升模型性能。 >>加入极市CV技术交流群,走在计算机视觉的最前沿

-

论文链接:https://arxiv.org/abs/2502.10385 -

论文代码:https://github.com/RobinWu218/SimDINO -

项目主页:https://robinwu218.github.io/SimDINO

研究动机

在深度学习领域,自监督学习(SSL)是处理大规模无标签图像数据以学习有效特征表示的重要手段。其中,DINO 和 DINOv2 模型家族被广泛应用,其学习到的特征表示在下游任务,如图像分类和分割中,能实现卓越性能。然而,它们存在显著缺陷:训练管道极为复杂且不稳定,包含众多基于经验的设计选择。众多超参数需精心调整,否则特征表示易崩溃,这为模型的改进以及适配新领域带来极大困难。因此,简化这些模型的训练过程并提高其稳定性,成为亟待解决的问题,这也构成了本文的核心研究动机。

创新点

-

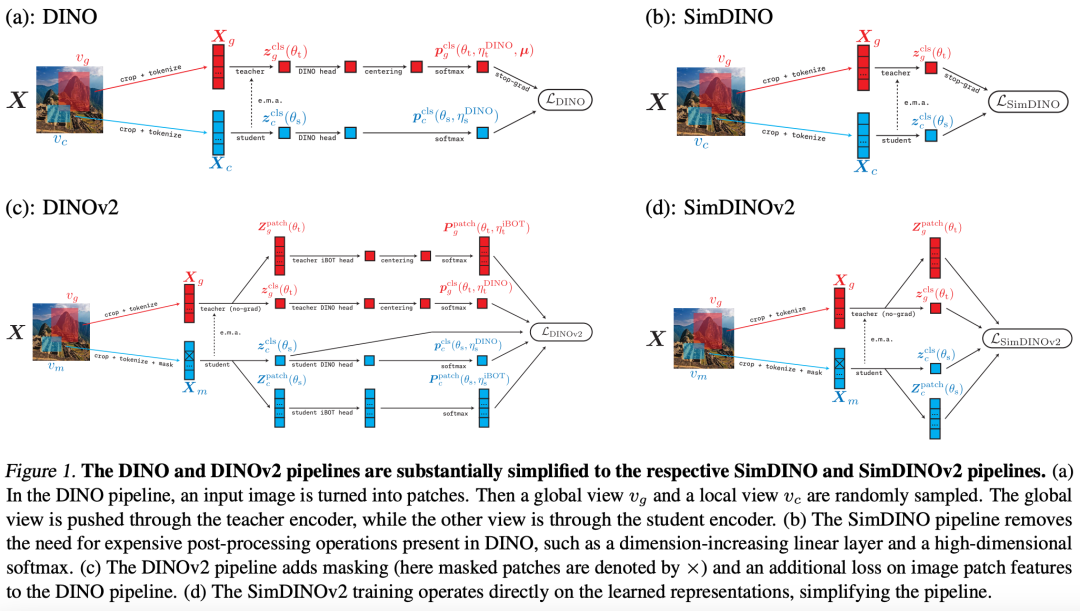

简化训练管道:去除 DINO 和 DINOv2 训练管道中诸多复杂的调整和超参数,引入总编码率正则化项。以明确使用负样本的方式,避免特征表示崩溃,极大地简化了训练流程。如 SimDINO 直接使用平方欧几里得距离比较特征,避免了原 DINO 中复杂的后处理操作,如大维度的线性层和高维 softmax 等。 -

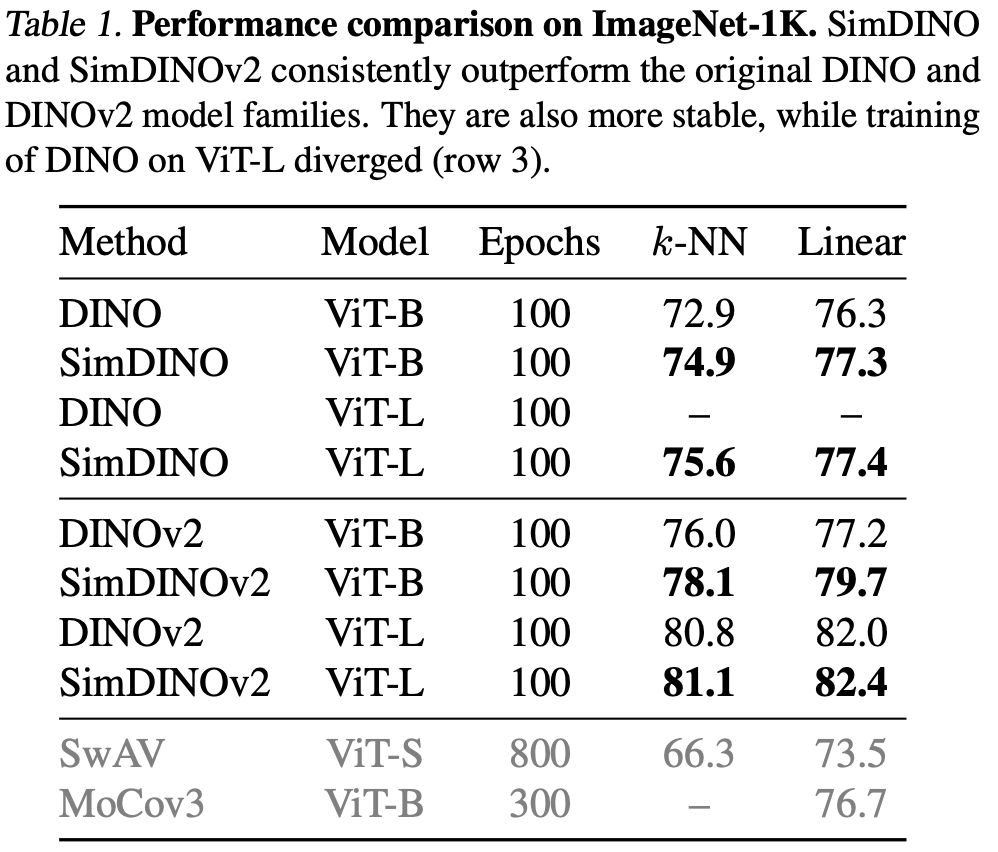

提升模型性能与鲁棒性:实验表明,简化后的 SimDINO 和 SimDINOv2 模型在各种下游任务中,性能优于原 DINO 和 DINOv2 模型。同时,对不同的设计选择,如网络架构和超参数变化,表现出更强的鲁棒性。在 ImageNet-1K 数据集分类任务中,SimDINO 和 SimDINOv2 的 k-NN 和线性评估准确率更高;在 COCO val2017 数据集的目标检测和分割任务中,SimDINO 性能远超 DINO 。 -

新的设计理念验证:证明通过简化设计原则,能够改进深度学习的实践经验。为后续设计高性能视觉自监督学习模型提供了新的思路,即可以通过使隐式设计选择在损失函数中更明确地体现,让现有管道更稳定,提升模型性能 。在理论层面,简化框架为研究自监督学习损失全局最优解的几何属性提供了切入点;在实践中,可将该范式推广到更多自监督学习框架。

实操阶段

-

去除复杂后处理步骤。SimDINO 对 DINO 的简化:DINO 在训练过程中,为了比较学生网络和教师网络的输出特征,采用了一系列复杂的后处理步骤,如添加权重归一化的线性层(DINO heads)、对教师网络计算的特征进行中心化操作、使用温度加权的 softmax 计算概率向量,最后通过交叉熵来比较这些概率向量。而 SimDINO 提出直接比较学生网络和教师网络输出的特征和,避免使用这些复杂的后处理步骤,从而简化了训练流程。SimDINOv2 对 DINOv2 的简化:DINOv2 在 DINO 的基础上增加了一些复杂操作,如对输入进行掩码处理、使用 Sinkhorn – Knopp 算法对教师输出特征进行中心化等。SimDINOv2 同样摒弃了这些复杂的后处理步骤,直接在归一化特征上计算基于欧几里得距离的损失。引入新的损失函数和正则化项 -

SimDINO 的损失函数与正则化:SimDINO 使用简单的平方欧几里得距离来衡量学生网络和教师网络特征的差异,代替 DINO 中基于交叉熵的复杂计算。同时,为避免特征表示崩溃,添加了编码率正则化项 ,通过直接惩罚特征的协方差来确保非崩溃。最终得到的损失函数为。 -

SimDINOv2 的损失函数与正则化:SimDINOv2 在简化过程中,不仅考虑了整体特征的差异,还计算了补丁特征的差异。其损失函数为,通过这种方式简化了 DINOv2 复杂的损失计算过程。 -

优化超参数选择:对于 SimDINO 和 SimDINOv2 损失函数中的超参数,论文提出通过平衡距离项和正则化项梯度的渐近阶来选择合适的值。根据 Cauchy – Schwarz 不等式,使两项关于特征的梯度范数相等,从而确定 。虽然这是一种启发式选择,常数因子仍需调整,但在实践中有助于调整模型。

实验结果

-

k – NN 评估:在 ImageNet – 1K 数据集上,SimDINO 在 k – NN 评估中,以 ViT – B/16 架构为例,达到了 74.9% 的准确率,而 DINO 仅为 72.9%,SimDINOv2 进一步提升至 78.1%。在更大的 ViT – L/16 架构下,SimDINOv2 达到了 81.1% 的准确率,显著优于 DINOv2 的 80.8%。

-

线性评估:在 ImageNet – 1K 数据集的线性评估中,SimDINO 和 SimDINOv2 同样表现出色。例如,对于 ViT – B/16 模型,SimDINO 的准确率为 77.3%,SimDINOv2 为 79.7%,均高于 DINO和 DINOv2

(文:极市干货)