关注Deepseek也有一年多了,当时Mixtral-8x7B模型刚出来,我写了一篇分析其MoE架构的文章。Deepseek不久后推出了他们第一版Deepseek MoE模型,他们的工作人员看到文章加了我的微信;

Mixtral-8x7B 模型挖坑:

https://zhuanlan.zhihu.com/p/674751021

在做Paiss的时候,我就将Deepseek MoE视为主流模型进行了实验对比;

在Deepseek V2出来后,MLA架构巧妙地设计吸引了我。启发我做出CLOVER这篇文章。MLA中存在一个absorb操作,能将Key Weight吸收到Query Weight中,Value Weight吸收到Output Weight中,缺点是合并后参数量会变大。CLOVER先合并再分解,不改变模型结构就能得到正交的注意力头,对剪枝和微调都有很大的好处;

随着Deepseek V3/R1彻底爆火,我也来添一把火:

TransMLA: Multi-head Latent Attention Is All You Need

arxiv: https://arxiv.org/abs/2502.07864

github: https://github.com/fxmeng/TransMLA

-

本文理论证明了,在同等KV Cache开销下,MLA的表达能力始终大于GQA的能力,并通过实验验证这一优势。 -

本文提出一种TransMLA的方法,能将目前主流模型如LLaMA-3,Qwen-2.5等模型中的GQA统统等价变换为能力更强的MLA。 -

本文将会使用改造后的模型复现R1的能力。此外还会探索MoE,MTP结构,混合精度量化训练,训练推理加速等技术,希望能推动基于GQA模型向MLA模型的过渡,帮助初学者了解Deepseek使用的技术,以及给大模型厂商提供一个低成本迁移模型架构的方案。

TransMLA方法

本节首先提出以下定理:

定理1:当KV缓存大小相同时,MLA的表达能力大于GQA。

证明:通过接下来的1)2)3)节中,我们论证了任何GQA配置都可以转换为具有相同KV缓存大小的MLA形式。在第4)节中,我们进一步证明了存在MLA无法通过GQA表示的情况。

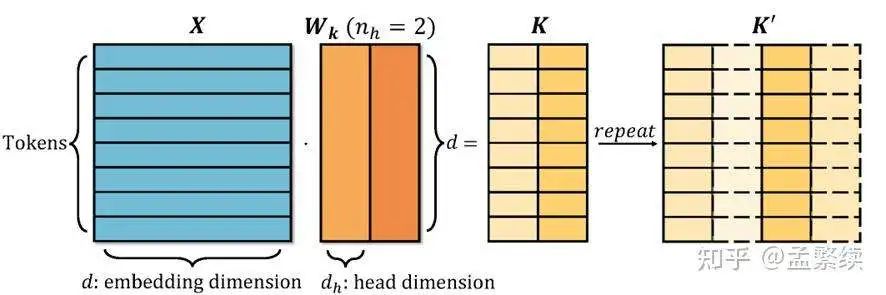

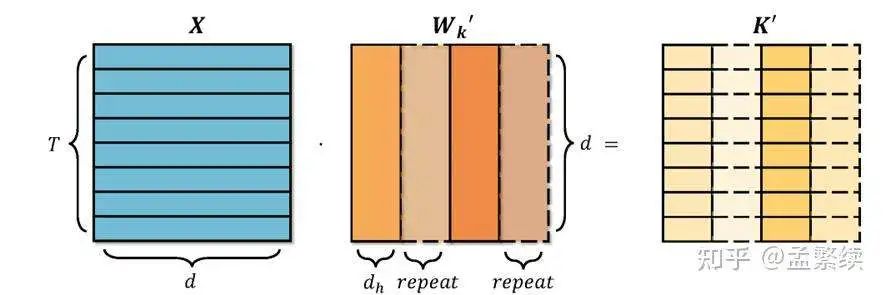

1)GQA形式,复制Key-Value

上图展示了分组注意力(GQA)的典型结构。在GQA中,Query 被拆分成个头,每个头的维度为。为了减少Key和Value的数量,Key 被定义为具有个头(其中),每个头的维度为。

设为长度为、隐藏维度为的输入序列,为Key的投影矩阵。那么,

由于标准的多头注意力要求和(以及)具有相同数量的头,因此必须将从个头扩展到个头。定义复制因子。将沿其列划分为个块,每个块对应一个头: 其中每个块 。通过将每个复制次并拼接,得到扩展后的矩阵 :

2)MHA形式,将复制操作移到参数侧

上图展示了一种使用多头注意力(MHA)替代GQA的方法,在计算之前,可以先复制投影矩阵。首先,将沿其列划分为部分,其中每个对应Key中的一个原始的注意力头:

然后,将每个复制次,并按顺序拼接它们,形成新的投影矩阵:

将应用于,直接得到 这种方法在数学上等价于先计算,然后复制其头(GQA)。

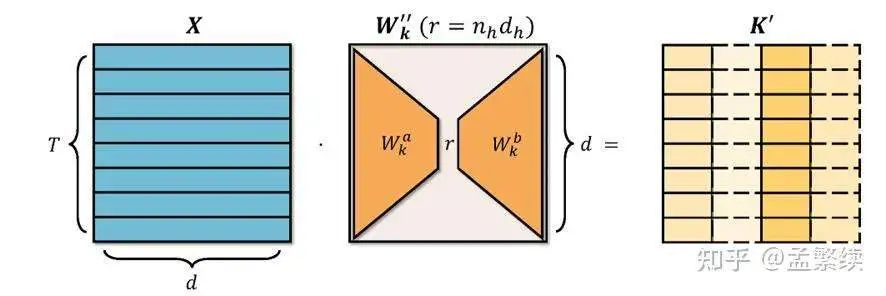

3)MLA形式,低秩分解参数矩阵

上图展示了,它是通过复制形成的,最多有个自由度。因此,它的秩最多为。为了更正式地理解这一点,使用奇异值分解(SVD)对进行分解: 其中和是的正交矩阵,是的对角矩阵,包含奇异值。只有前(或更少)的奇异值可能是非零的。因此,可以截断SVD,只保留前个奇异值,其中:

定义

那么

同样的方法也可以直接迁移到Value的变换上,这里不再展开讨论。其中在缓存Key和Value矩阵时,只需要存储低秩表示和。在实际的注意力计算中,可以通过与和相乘来“扩展”表示,从而恢复全维度并增强表达能力。

4)存在MLA无法被GQA表示的情况

考虑一种情况,其中 中的向量是正交的。在这种情况下,乘以 与 后,每个通道的输出在通道间保持不同。然而,在GQA中,每组内的头是复制的,这意味着组内所有头的输出是相同的。这种结构差异意味着某些MLA的情况无法被GQA表示,因为MLA允许在各个通道之间有更大的输出多样性。

基于上述分析,我们证明了定理1。通过将GQA转化为等效的MLA表示,我们可以增强模型的表达能力。接下来的章节将展示实验结果,以验证这一结论。

实验效果

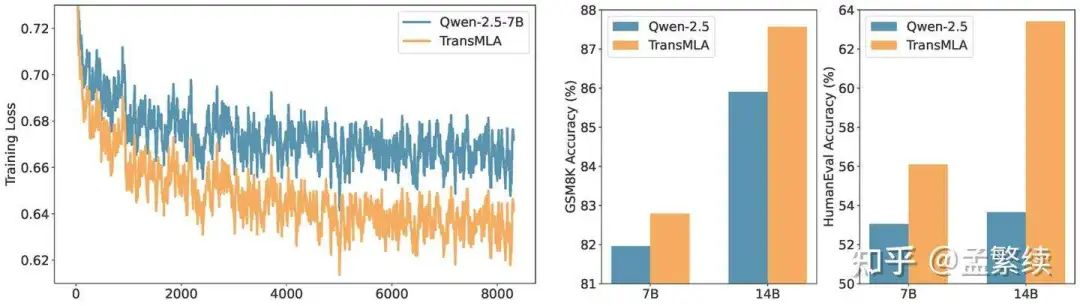

我们以Qwen2.5为例,展示如何将一个基于GQA的模型转换为MLA模型,并对比转换前后的模型在下游任务中的训练效果。Qwen2.5-7B模型的每一层包含28个Query头和4个Key/Value头,每个头的维度为128,KV Cache的维度为1024。Qwen2.5-14B模型的每一层包含40个Query头和8个Key/Value头,每个头的维度为128,KV Cache的维度为2048。在将Qwen2.5-7B模型转换为MLA模型后,和的输出维度都被调整为512,KV Cache的维度依然保持为1024。与GQA模型的设置不同,在TransMLA中,和将512维的特征升维至维。由于28个Query头可以分别与28个Query进行交互,形成不同的功能表示,这种调整显著增强了模型的表达能力。通过这种方式,TransMLA能够提升GQA模型的表达能力,同时不增加KV Cache的数量。值得注意的是,新增的参数量非常小。具体来说,针对Q-K对,增加了一个的矩阵,而原始矩阵的维度为,因此新增参数量仅占原始矩阵的1/8。对于V-O对,新增的参数量同样是原来参数量的1/8。整体来看,模型的参数量从原来的7.6B略增至7.7B,增加幅度非常小。

为了评估转换后的MLA模型性能的提升,我们将原始基于GQA的Qwen模型与转换后的TransMLA模型分别在一个新的指令微调数据集SmolTalk上进行训练。SmolTalk数据集包含丰富的指令微调数据,同时也涵盖了MetaMathQA等数学任务数据和Self-OSS-Starcoder2-Instruct等代码任务数据。训练过程中,我们使用了torchtune框架,设定batchsize为16,学习率为2e-5,并训练了2个epoch。在训练过程中,为了尽量减少对原始模型的影响,我们仅对模型中Key-Value层进行训练。对于GQA模型,只训练和;而对于转化后的MLA模型,我们训练、、和四个权重矩阵。训练过程中的Loss以及训练后模型的效果都展示在下图中。

从图中可以看出,经过转换的MLA模型在训练过程中表现出更低的Loss值,表明其对训练数据的拟合能力更强。在7B和14B模型的设置下,TransMLA模型在数学和代码任务上的准确率显著高于原始的基于GQA的模型。这表明,TransMLA不仅提升了模型的表达能力,还在特定任务上带来了显著的性能改进。

这种性能提升不仅仅归功于增大了Key-Value中的可训练参数,正交化分解方式的使用也在其中发挥了至关重要的作用。为了进一步验证这一点,我们进行了对比实验。在这个实验中,我们没有采用正交化分解方式,而是通过Identity Map初始化升维模块来实现TransMLA。训练后得到的模型在GSM8K数据集上的准确率为82.11%,比基于GQA的模型(81.96%)高出仅0.15%。这一结果表明,仅仅增加可训练的参数并不能解释TransMLA性能的显著提升,正交化分解方式在提升模型效果方面发挥了关键作用。目前,更多的实验正在进行中,希望深入探究这一现象背后的原因,进一步验证正交化分解对模型性能的贡献。

写在最后

本文证明了GQA模型都能转化为MLA形式,给了大模型厂商一个放弃GQA,拥抱MLA的理由,以及快速过渡的方法。然而收到原始模型结构的限制,TransMLA的结构并不是最优的,如没有对Query进行压缩,没有使用Decoupled RoPE,以及Key和Value使用了独立的latent Vectors。若要从头训练模型,仍然建议在Deepseek V3的结构上进行创新。TransMLA能够提升目前R1蒸馏Qwen,蒸馏LLaMA项目的效果。未来我们将会进行这一工作,并开源训练代码和模型。

(文:机器学习算法与自然语言处理)