新智元报道

新智元报道

【新智元导读】一位AI从业者分享的14天学习路线图,涵盖大模型从基础到高级的主要关键概念!

无论是面试找工作、还是自学创业,甚至想要在圈子内讨论一下AGI的潜力,但凡想要深度参与到AI浪潮中,不可避免的就是学习大型语言模型(LLM)的底层原理。

但AI发展这么多年,论文、学习资料多如牛毛,并且更新换代极快,如何快速入门,学习到那些真正的基础知识,对于新手来说都是一个难题。

最近,一位AI从业者在网上分享了自己的学习过程,仅用14天就学完了LLM所需要的核心知识,学习笔记在GitHub上斩获了675+星星,并且还在持续上涨。

仓库链接:https://github.com/hesamsheikh/ml-retreat

学习路线中的主要知识点包括token嵌入、位置嵌入、自注意力、Transformer、对Q、K、V的直观理解、因果和多头注意力、温度、top-k、top-p、分类和指令微调、旋转位置编码(RoPE)、KV缓存、无限注意力(长上下文窗口)、专家混合(MoE)、分组查询注意力(grouped query attention)、llama-2架构及相关技术等。

学习LLM三步走

学习LLM三步走

作者把学习路线分为了三个步骤:

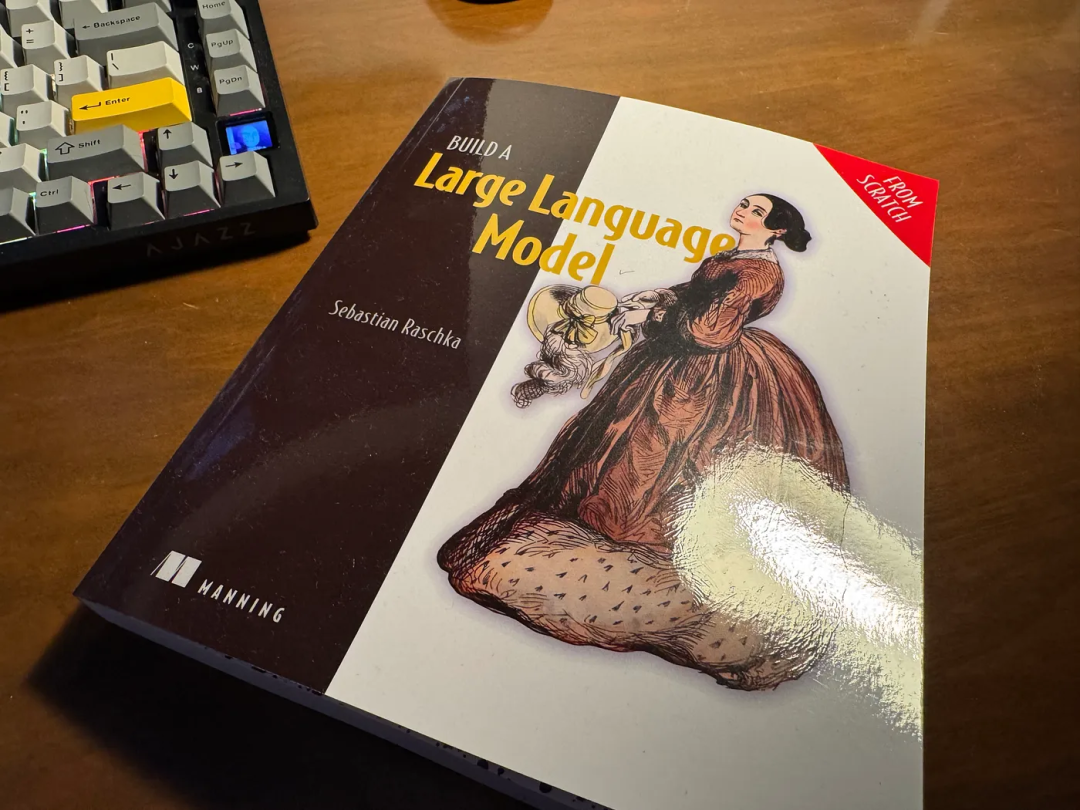

1. 从头开始构建大模型(Build an LLM from Scratch)

这部分主要是总结语言模型的基础知识,包括token、位置嵌入、自注意力机制、Transformer架构、最初版本的注意力机制(Attention is All You Need论文)和微调的基本原理。

虽然网络上已经有很多资源,但其中最关键的

(文:新智元)