谷歌AI模型进化如此之快的秘密终于揭开了。

用DeepMind首席执行官Demis Hassabis的话说:“AlphaEvolve可以让知识产生更多知识,让算法优化其他算法。”

如果说当年的AlphaGo围棋之战掀起了全球人工智能高速发展浪潮,那AlphaEvolve很可能是下一代AI实现自主进化的加速飞轮。

谷歌方面表示,目前已将AlphaEvolve发现的算法部署到了整个计算生态系统中,包括数据中心、硬件和软件,不仅改进了其下一代张量处理单元(TPU)的设计,还找到了一些更有效地利用谷歌全球计算能力和模型改进的新方法。

回顾AlphaEvolve的诞生,其实经历过好几个技术发展阶段和研究积累。

2022 年,谷歌开发了AlphaTensor模型,该模型找到了更快的矩阵乘法求解方法,改进了一项50多年没有进化的经典算法。2023年,谷歌发布了AlphaDev模型,它找到了更快的方法来执行计算机每天执行数万亿次的基本计算。AlphaTensor和AlphaDev都会将数学问题转化为一种游戏,然后寻找一系列制胜的策略。

2023年末谷歌推出FunSearch,用能够生成代码的LLM取代了游戏程序AI,由于LLM可以执行一系列任务,该工具曾被用于破解纯数学中的未解难题。

AlphaEvolve则是FunSearch的下一代版本,它可以演进整个代码库并开发更加复杂的算法,以产生切实可行的解决方案,且通用性强。

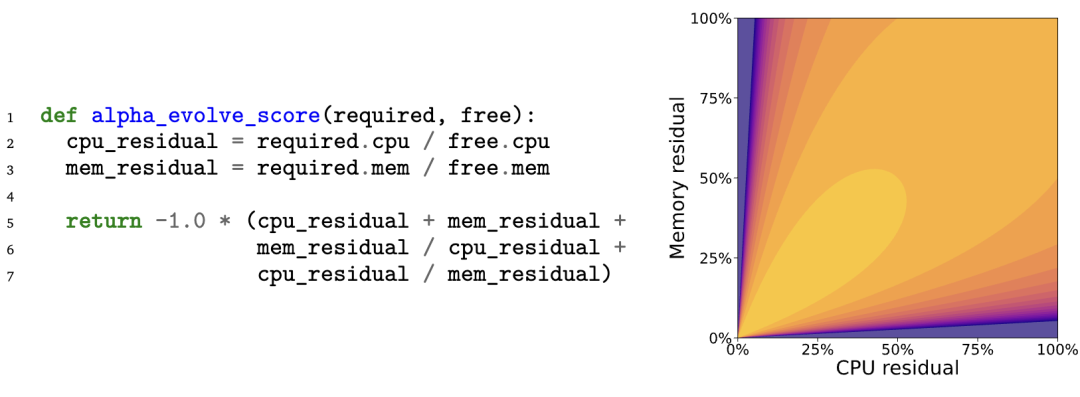

在改善数据中心调度方面,AlphaEvolve发现的一种新算法为谷歌大规模集群管理系统Borg提供支持,据悉,优化出来的启发式调度算法平均可持续恢复谷歌全球计算资源的0.7%——以谷歌的算力规模而言,这是一个惊人的效率进步。

令人印象深刻的是,AlphaEvolve还用于改进了自身驱动的系统,它优化了用于训练Gemini模型的矩阵乘法核,使运算速度提升了23%,并将整体训练时间缩短了1%,对于在海量计算网格上训练的AI系统来说,这种效率提升意味着显著的能源和资源节省。

此外,AlphaEvolve对低级GPU指令进行了优化,这个极其复杂的领域通常已经由编译器进行处理,因此人类工程师通常不会直接修改它,AlphaEvolve在基于Transformer的AI模型中,为FlashAttention内核的实现进行了高达32.5%的加速。

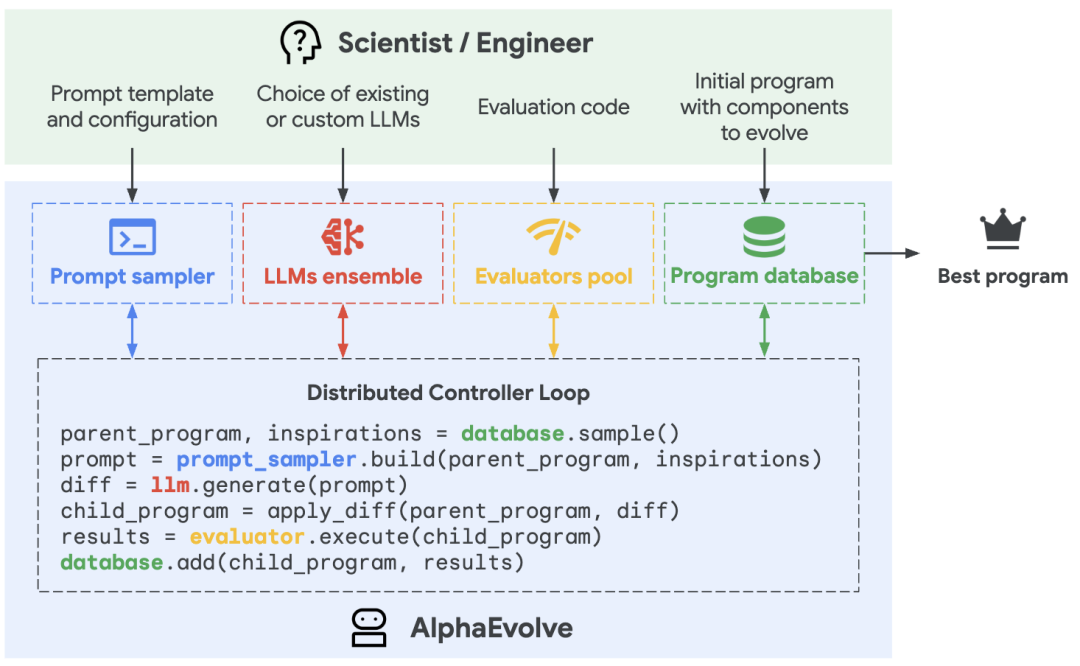

值得关注的是,发现新算法或者改进方案之后,AlphaEvolve会使用自动化评估指标来验证、运行和评判所提出的新程序,对每个解决方案的准确性和质量进行客观、可量化评估,这使得AlphaEvolve在数学和计算机科学等能够清晰、系统地衡量优化进展,并论证是否真的有用。

除了内部应用,DeepMind的目标是利用AlphaEvolve推进更多数学和算法发现的前沿研究。

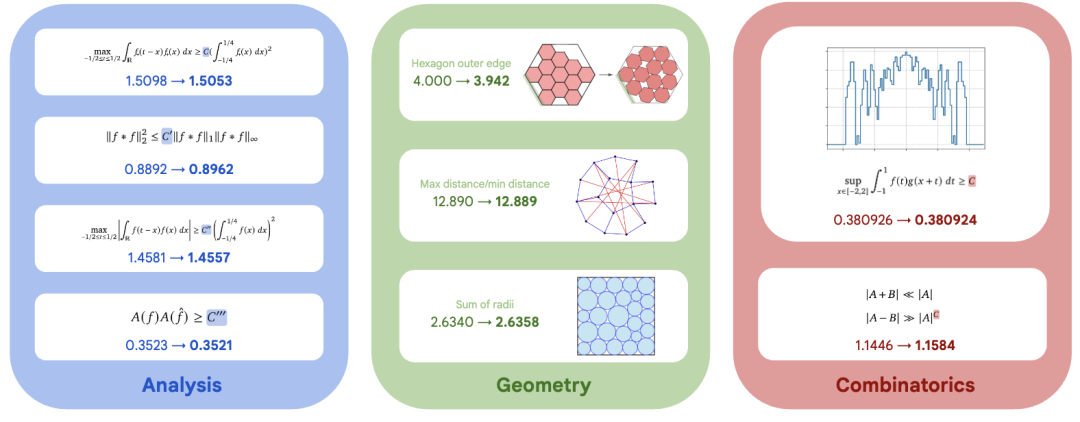

AlphaEvolve能为复杂的数学问题提出新的解决方案,基于计算机程序的极简代码框架,AlphaEvolve设计了一种基于梯度的新型优化程序的诸多组件,进而一步步挖掘发现多种用于矩阵乘法(计算机科学的一个基本问题)的新算法,这包括进行优化器和权重初始化、损失函数以及超参数扫描,在进化中自主进行多次突变。

对于4×4矩阵,AlphaEvolve通过发现一种使用48次乘法完成4×4复值矩阵相乘的算法,改进了Strassen(1969)算法。

为了探究AlphaEvolve的应用广度,谷歌研究人员将该系统应用于数学分析、几何学、组合学和数论领域的50多个未解决的问题,包括傅里叶分析问题(数据压缩背后的数学原理,对视频流等应用至关重要)、最小重叠问题(数学家保罗·埃尔德什于1955年提出的数论开放问题)以及接吻数(牛顿提出的一个问题,在材料科学、化学和密码学领域都有应用)。

-END-

(文:头部科技)