【编者按】继 AlphaGo、AlphaFold 之后,谷歌 DeepMind 带来的全新 AI 编程智能体 AlphaEvolve 横空出世,它巧妙地结合了大型语言模型(LLM)的创造力与自动化评估机制,不仅在矩阵乘法等经典数学问题上取得新突破,更在谷歌数据中心优化、芯片设计乃至 AI 自身训练等实际应用中展现出惊人实力,为我们揭示了 AI 驱动算法发现的广阔前景。

出品丨AI 科技大本营(ID:rgznai100)

5 月 14 日,Google DeepMind 正式官宣推出 AlphaEvolve——一款由 Gemini 强力驱动、专注于算法发现的编码智能体。 这款全新的 AI 智能体,堪称算法设计领域的一位“进化大师”。

与传统的代码生成工具不同,AlphaEvolve 并不追求“直接产出答案”,而是像演化生物一样迭代出越来越优秀的解决策略。它的背后是 Google DeepMind 最新的大语言模型家族 Gemini——其中 Gemini 2.0 Flash 负责高效率生成大量思路,Gemini 2.0 Pro 则在关键节点提供更深层的方案优化。

其核心能力有:

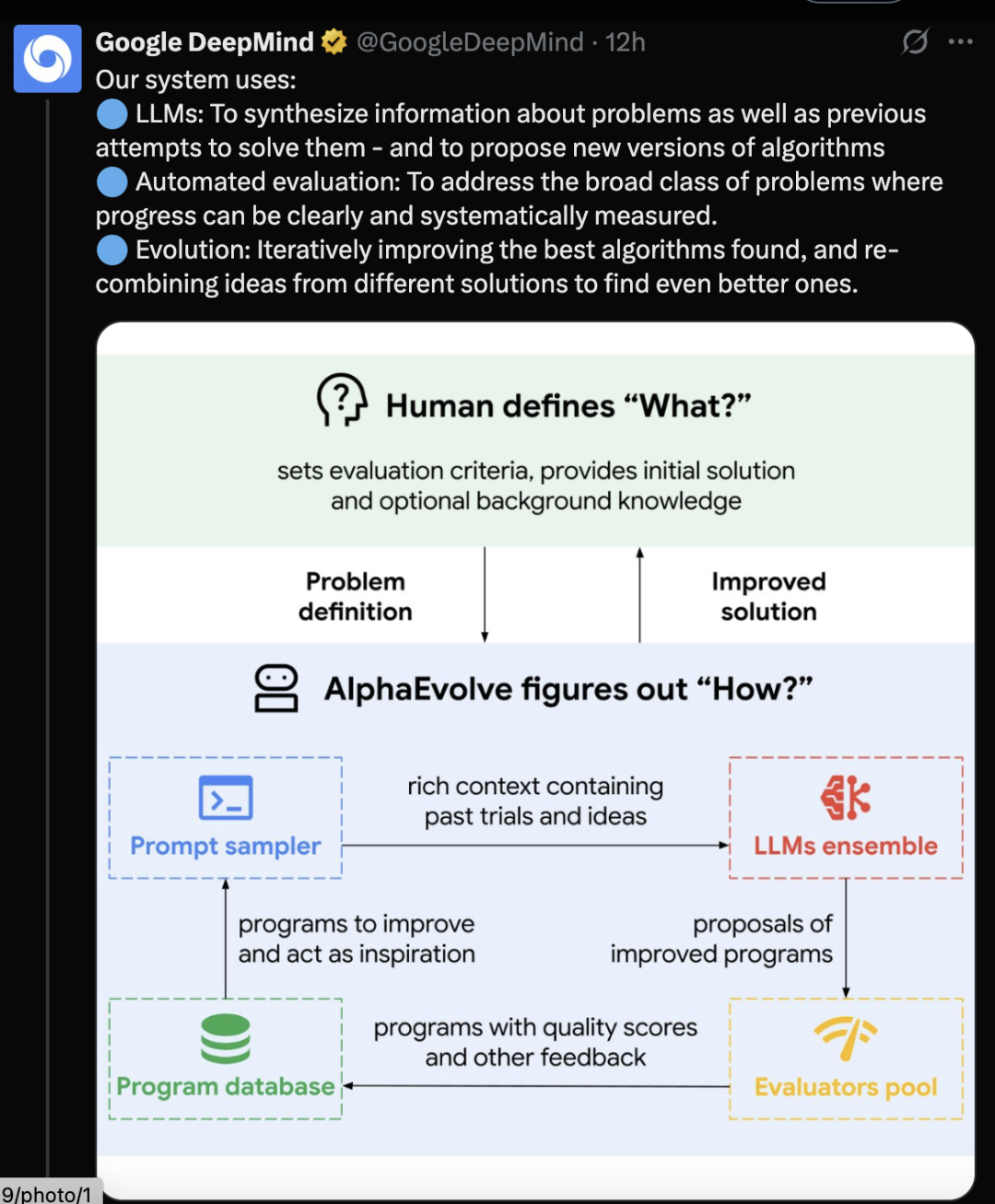

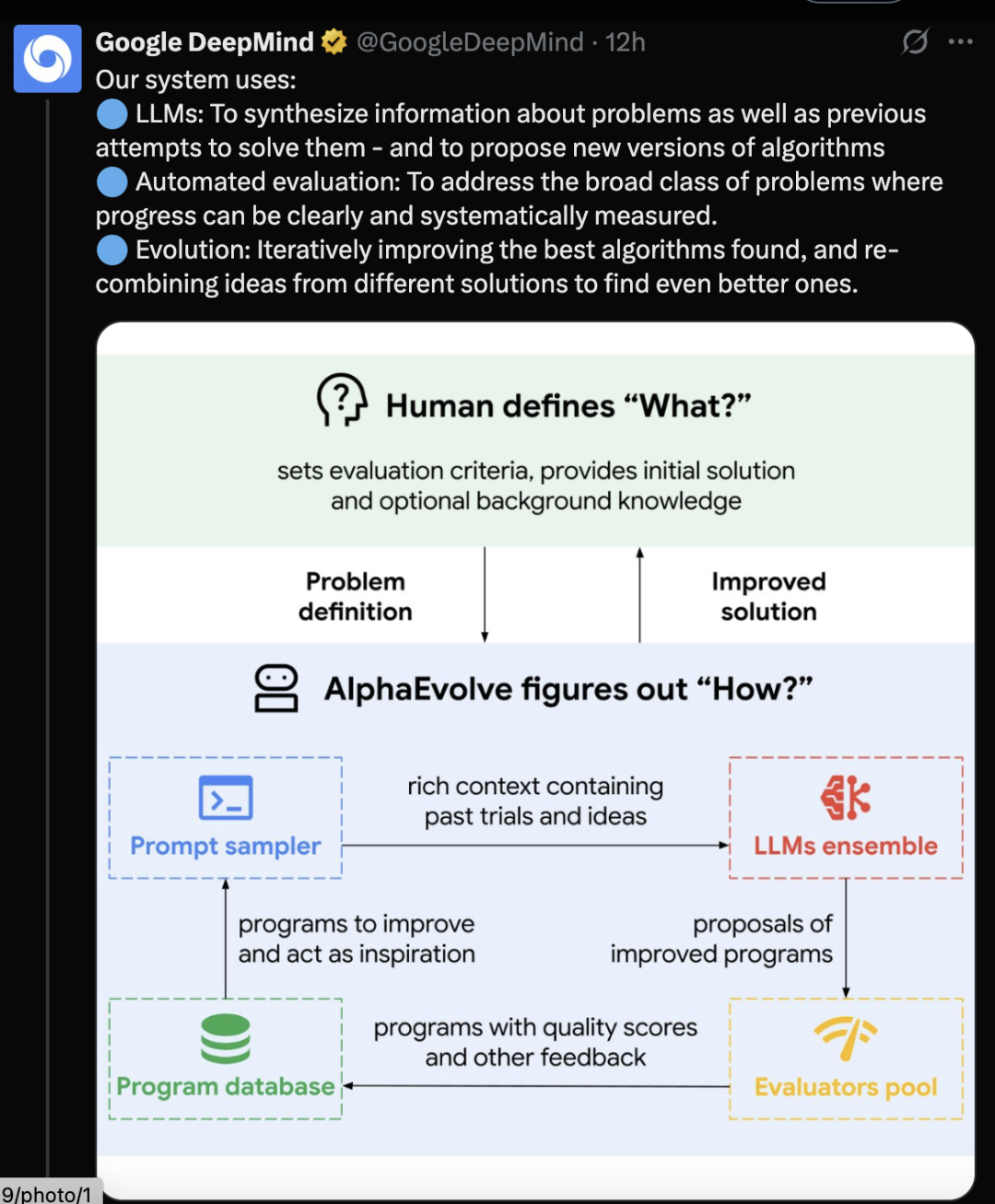

那么,AlphaEvolve 是如何实现这些强大功能的呢?其背后精妙的系统设计主要包含三大支柱:

-

大型语言模型 (LLMs)核心趋动: AlphaEvolve 巧妙利用了Gemini 等先进大语言模型。这些 LLM 负责深度理解问题、综合分析过往的尝试与解决方案,并在此基础上创造性地提出新版本的算法代码。

-

自动化评估 (Automated Evaluation): 对于那些进展可以被清晰、系统化衡量的问题(尤其在数学和计算机科学领域),AlphaEvolve 配备了自动化评估系统。它能够对 LLM 生成的每个算法方案进行客观、量化的打分,精准评估其准确性与效率。

-

进化机制 (Evolution): 这也是 AlphaEvolve 的“灵魂”所在。它并非止步于单个好方案,而是采用进化策略,不断迭代改进当前表现最佳的算法。更关键的是,它还会从不同的优秀方案中汲取灵感、重组“基因”(即核心思路),从而“进化”出更为强大、甚至出人意料的更优算法。

这种“LLM 创造 + 自动化评估 + 进化迭代”的协同工作模式,使得 AlphaEvolve 能够从最初的设想,一步步进化出高度优化的复杂算法。与前代工具 FunSearch 主要生成简短代码片段不同,AlphaEvolve 能够进化出包含数百行代码的完整程序,从而应对更复杂、更广泛的挑战。

谷歌 DeepMind 副总裁、领导其 AI 赋能科学团队的 Pushmeet Kohli 将AlphaEvolve 形容为一个“超级编码智能体”。英国华威大学的数学家 Jakob Moosbauer 表示:AlphaEvolve 的强大之处在于它并非直接去寻找问题的答案,而是去搜索那些能产生特定解决方案的“算法”本身,这使得它威力倍增。“这种方法让它能广泛适用于各种各样的问题,”他说,“AI 正日益成为数学和计算机科学领域不可或缺的工具。”

从数据中心到芯片,AlphaEvolve 实战成绩单亮眼

虽然 AlphaEvolve 的“算法探索”能力首先用于攻克基础数学难题(例如矩阵乘法优化),但 Google DeepMind 表示,它已经将 AlphaEvolve 的成果投入到多个真实场景中,带来了实际收益。

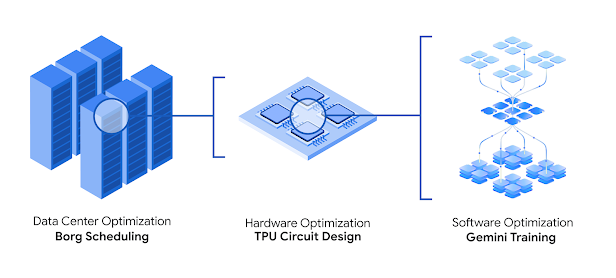

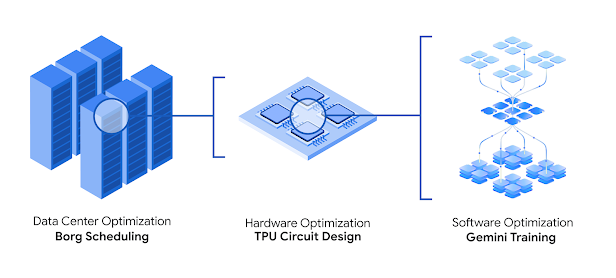

AlphaEvolve 如何帮助 Google 提供更高效的数字生态系统,从数据中心调度和硬件设计到 AI 模型训练。

Google 的数据中心任务调度系统 Borg,一直是全球最复杂的调度系统之一。AlphaEvolve 提出了一种人类未曾发现的启发式策略,目前已在 Google 全球部署超过一年,平均提升了 0.7% 的计算资源使用率。

别看这个数字不大,但在 Google 级别的基础设施下,这种提升意味着巨大的能源与算力节省。

2. 助力芯片设计:直接修改 Verilog 代码

AlphaEvolve 还成功地重写了一段用于矩阵乘法的 Verilog 硬件描述代码,删除了冗余的比特位,同时保持电路功能正确。这一修改已被集成至下一代 TPU(Tensor Processing Unit)设计中,为 AI 芯片的自动化设计开启新可能。

在 AI 模型训练方面,AlphaEvolve 优化了 Gemini 模型中的关键矩阵计算过程,使训练时间缩短了 1%,核心 kernel 的运行速度提升了 23%。此外,它还对 FlashAttention 这一 Transformer 模型中的核心组件进行了优化,带来高达 32.5% 的加速效果。

更重要的是,这一过程原本需要工程师数周才能完成的底层优化,现在通过 AlphaEvolve 的自动化探索只需几天,极大提升了 AI 研究迭代速度。

挑战数学前沿:AlphaEvolve 破解百年难题,刷新算法认知

AlphaEvolve 在数学方面也展现出惊人的解题能力和创新潜力。它还可以为复杂的数学问题提出新方法,只需提供一段最简代码框架,它就能设计出一种新的基于梯度的优化流程中的多个关键组件,进而发现了多种全新的矩阵乘法算法——这是计算机科学中的基础性问题。

AlphaEvolve 为发现更快的矩阵乘法算法而提出的一系列修改建议。在此示例中,AlphaEvolve 对多个核心组件都进行了大幅度的修改,包括优化器(optimizer)与权重初始化(weight initialization)、损失函数(loss function)以及超参数扫描(hyperparameter sweep)。这些修改绝非微不足道的简单调整,其背后是进化过程中多达 15 次的复杂“突变”(mutations)。

矩阵乘法是无数应用的核心,但其最快算法仍是未解之谜。AlphaEvolve在此领域取得重大突破。针对 4×4 复数矩阵乘法,AlphaEvolve 找到了一种仅需 48 次标量乘法的算法,超越了 1969 年 Strassen 提出的经典算法,刷新了该场景下的最优记录。

为了验证 AlphaEvolve 的广度,研究团队将其应用于 50 多个数学分析、几何、组合数学和数论中的开放问题。得益于其灵活性,大部分实验仅需数小时即可设置完成。据我们了解,在约 75% 的情况下,AlphaEvolve 成功重现了当前最优解。

更令人惊喜的是,在约 20% 的问题中,AlphaEvolve 提出了优于现有解的新方案,推动了相关开放问题的研究进展。例如,它在已有 300 多年历史的几何难题「接吻数问题(kissing number problem)」上取得突破:该问题研究的是在不重叠的前提下,最多能有多少个球同时接触一个单位球。AlphaEvolve 找到了一个包含 593 个外接球的新构型,并在 11 维空间中建立了该问题的最新下界。

AlphaEvolve 代表了通用算法发现迈出的关键一步,也为大模型与自动化推理结合开辟了全新路径。在 X(原 Twitter)上,Grok 大模型官方账号也转发并评论了 AlphaEvolve 的成果,称其为 “AI 在自主设计与优化算法领域的一大飞跃”,并指出其表现“令人印象深刻”。

正如我们昨天报道的那样,Ruby on Rails 之父 DHH 预言:“未来写代码将是一种情怀。”而 AlphaEvolve 的出现,似乎正在让这一观点变为现实。在这个由代码构建的世界里,谁来编写下一代算法的“源代码”?或许,这一次,答案真的来自 AI 自己。

(文:AI科技大本营)