今年2月,美国阿拉巴马州州长Kay Ivey签署了738 号行政命令,以推动生成式AI在州政府中的大面积应用。

围绕着第738号行政命令,阿拉巴马州迅速组建了由州信息部长带队的生成式AI小组,根据生成式AI技术特点、应用现状、政策、数据安全等多维度,发布了这份深度应用报告。

阿拉巴马州政府应用现状

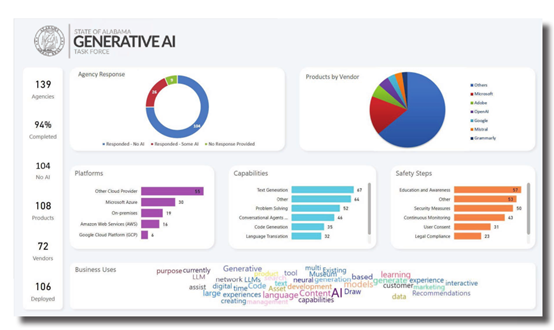

根据任务组的调查,阿拉巴马州政府中有 139 个行政分支机构参与了生成式AI的使用情况调查。结果显示,其中 104 个机构表示目前尚未使用任何生成式AI产品或服务,但仍有 35 个机构报告使用了 108 种不同的产品,涉及 72 家独特的供应商。这些生成式AI产品和服务的托管平台从本地解决方案到各种云服务提供商都有涉及。

报告指出,尽管这一调查结果揭示了一些机构已经开始探索生成式AI的应用,但这可能只是冰山一角。许多供应商和提供商已经开始将生成式AI集成到其现有产品和服务中,而普通用户可能并未察觉到这些变化。

因此,随着生成式AI的普及,培训和教育将成为确保其安全和负责任使用的关键环节。

生成式AI伦理风险与应对策略

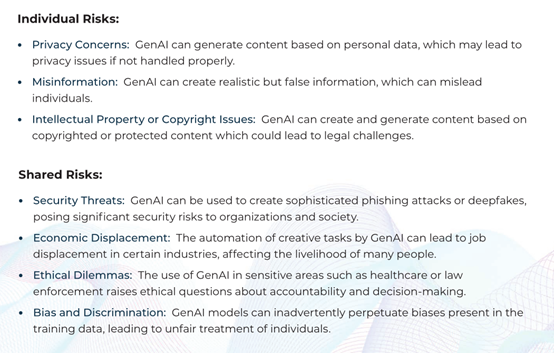

生成式AI带来了多种伦理风险,包括对个人和集体的影响。个人风险方面,隐私问题是一个重要关注点。生成式AI可能会基于个人数据生成内容,如果处理不当,可能会引发隐私泄露。此外,生成式AI还可能制造逼真但虚假的信息,从而误导个人。

在知识产权或版权方面,生成式AI可能会基于受版权保护的内容生成新的内容,从而引发法律纠纷。

集体风险方面,生成式AI可能会被用于制造复杂的网络钓鱼攻击或深度伪造内容,对组织和社会构成重大安全威胁。它还可能导致某些行业的创造性工作被自动化取代,从而引发就业问题。

此外,在医疗保健或执法等敏感领域的应用可能会引发关于问责制和决策的伦理问题。生成式AI模型可能会无意中延续训练数据中存在的偏见,导致对个人的不公平对待。

为了应对这些风险,报告建议实施强有力的隐私和安全措施,定期进行偏见评估,并确保生成式AI应用的透明度和问责制。通过采用负责任的AI实践,可以引导生成式AI的伦理使用。

数据管理与所有权

明确数据的所有权、分类和准备情况对于确保数据在生成式AI系统中被有效和道德地管理至关重要。数据所有权涉及数据的权利和责任,包括确定谁拥有数据、谁有权访问数据以及谁负责数据的维护和安全。数据分类则是根据数据的敏感性和重要性对其进行分类,以便应用适当的安全措施和处理协议。

常见的分类包括“公开”“内部”“机密”和“限制”等。数据准备情况则涉及确保数据能够被AI和生成式AI系统有效使用,包括数据的质量、治理、安全性、无偏见性、丰富性、准确性和可访问性。

此外,报告还强调了识别安全数据存储解决方案和数据保留要求的重要性。为了确保数据的安全存储,建议采用先进的加密协议来保护静态数据,实施基于角色的访问控制以限制存储访问权限,利用工具识别和缓解存储系统中的潜在漏洞,并考虑使用具有冗余、可扩展性和抵御硬件故障或网络攻击能力的存储解决方案。

在数据保留方面,需要根据阿拉巴马州记录委员会制定的法律和法规标准,设定数据保留期限,并确保数据在到期后及时删除。

政策与治理

制定一个明确的法律框架,以理解在州系统中使用生成式AI的角色、责任和参数,对于成功部署生成式AI至关重要。鉴于生成式AI仍处于发展阶段,建议采用主要在机构层面制定政策的治理模式,而不是通过制定具体的州法律或法规来规范其使用。这种灵活性将有助于应对随着生成式AI发展而可能出现的新挑战或情况。

阿拉巴马州在 2024 年 4 月将国家信息技术安全框架和最佳实践与全州信息技术政策对齐。此外,信息技术办公室已经起草了关于政府机构使用生成式AI的政策,这些政策正在由内部利益相关者进行审查,随后将分发给其他利益相关者执行机构。这些政策涵盖了生成式AI使用的各种控制措施。

在采购生成式AI解决方案时,需要考虑的法律问题包括知识产权(版权法、训练模型)、保密性和数据安全(数据的位置和使用)、个人数据隐私(个人数据的应用)、内容监管(内容监管和滥用指南、例外情况)以及州采购法和生成式AI供应商的条款和条件。采购生成式AI技术可能需要州政府审查其现有的采购流程,以确保通过创新和先进技术实现最佳价值,同时保护免受潜在风险。

(文:AIGC开放社区)