席卷全球的 AI 淘金热中,一个词正被悄悄地掏空——那就是“开放”。

《新程序员》:嗨 Matt,我们其实和你一样,刚从法国巴黎的 PyTorch Day Paris 活动回来。这是在中国举办的第一届 PyTorch Day China,所以我想请你先聊聊这次活动的举办原因。

Matt White:PyTorch 的用户遍布全球。我们有个数据,文档网站上大约 70% 到 80% 的流量都来自中国,所以我们心里清楚,这里有我们庞大的群众基础。

PyTorch Day 这个活动本身,我们希望它能成为一场全球性的运动,而不仅仅是“美国主场”。我们想做的是,推动 PyTorch 框架本身的发展,促进全球 AI 研究的进步,并鼓励大家在开源的世界里,把自己的奇思妙想不断变为现实。我们由衷地希望能看到更多来自全球的贡献,也希望 PyTorch 能在世界每个角落生根发芽。

《新程序员》:今年像中国的 DeepSeek-R1 和国外的 Llama 4 这些开源模型,都取得了非常大的进展。这些新变化,对你所说的“开放模型”的定义和策略,会带来什么样的影响?你怎么定义 AI 领域的“开放”这两个字?

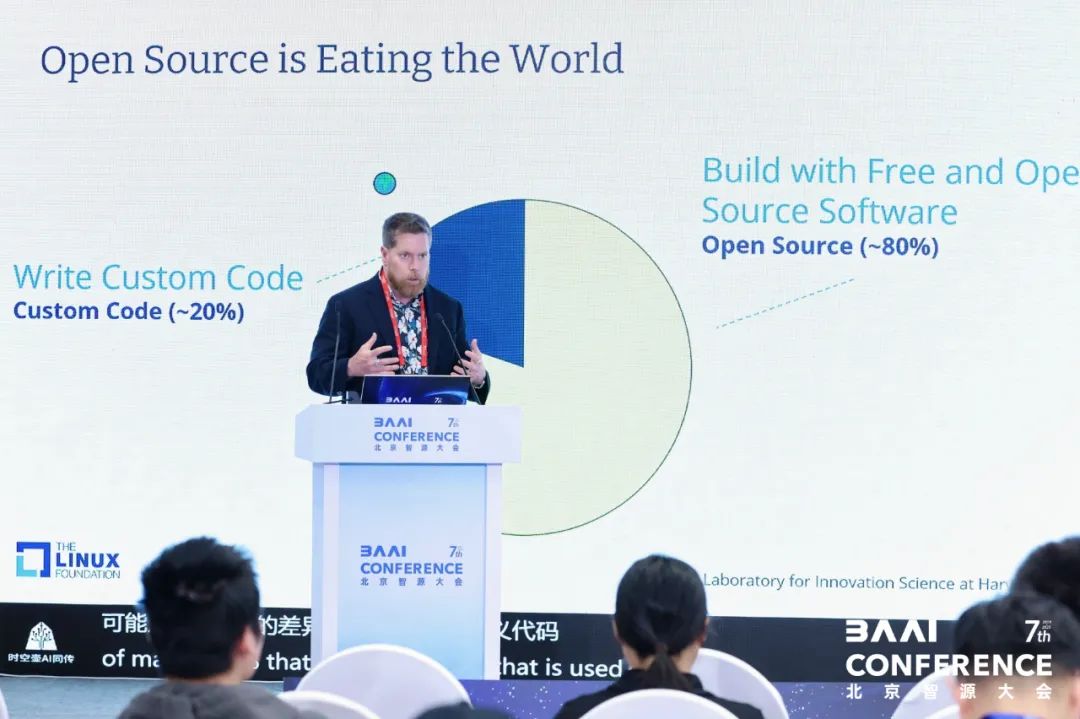

Matt White:我在演讲里(本文开头整理了 Matt 的主要演讲内容)详细谈到了“开放”这个话题。在我们看来,“开放”的核心,要透过“许可证”这面镜子来看,而不是简单地把东西往网上一扔就完事了。

总之,关键在于,许可证允许你做什么——你能用这个模型搞研究吗?能用在学校里吗?能不能把同一个模型直接拿去开公司赚钱?

我们想鼓励大家去使用那些专门为开放模型、数据和权重设计的许可证。这种许可证考虑得非常周全,它不像 Apache 2.0 或 MIT 许可证那样只盯着源代码,而是把模型架构、权重、数据集、配套的工具链,甚至所有文档都打包考虑进去了。如果你是真心实意地想投身开源,这些就是你必须借助的“舟楫”。

《新程序员》:PyTorch 基金会已经扩展成一个更大的“伞状组织”。面对 AI 智能体(Agent)和各种专用模型的迅猛发展,这种新架构如何让 PyTorch 更好地为这些新生力量保驾护航?

Matt White:这个领域的新事物确实层出不穷,我们希望能一直陪伴和支持社区,帮助他们把想法落地。AI 框架和智能体框架,都是开源发展中至关重要的阵地。说到底,我们就是要确保,市面上有足够好用的开源工具,让技术不再是少数人的专利,并且方便大家在这些框架之上,去进行“添砖加瓦”式的创新。

开放的标准和协议也同样举足轻重。我们希望大家能围绕一个通用的标准团结起来,让它随处可用、人人可享。对于这样的努力,我们绝对是鼎力支持的。

《新程序员》:你身兼 PyTorch 基金会和 Linux 基金会的领导职务,这让你有一个很独特的观察视角。在当前 OpenAI、谷歌、Meta 等巨头和 DeepSeek 这样的新锐同台竞技的背景下,你如何利用自己的身份,来促进各个开放 AI 项目之间走向合作,而不是“各立山头”?

Matt White:即使是在一个充满竞争的环境里,科技巨头们也总会为了那些对彼此都有利的事情而坐到一起。PyTorch 就是这样的项目。你看,我们的成员里有 Lightning AI、Hugging Face,也有谷歌、Meta 和微软。大家之所以愿意来,是因为他们都信赖这个平台,都相信要推动开源 AI 向前走。

这种合作其实一直都存在,就像当年的 Kubernetes 和 Linux 一样。只要你对一件事有信念,你就会持续为它投入。

在这些开放的基金会里,大家合作的水平和风度都很高。我们鼓励各方都来发声,但归根结底,你还是要为这个框架做贡献,让它对你自己的应用更有用。像英特尔、英伟达、AMD 这些公司,提升 PyTorch 框架的性能,都关乎他们的切身利益。同样的道理也适用于应用或智能体框架,几家公司可以携手打造通用的接口或协议。这能构建一个坚实、互联互通的底座,让你能安心地在上面打造自己的应用和用户体验。

《新程序员》:2025 年 AI 智能体发展很快,架构创新也很多。这些趋势对开源生态意味着什么?PyTorch 或 Linux 基金会是否能在推动相关开放标准方面扮演什么角色?

Matt White:当然能,而且这个角色至关重要。现在有不少组织已经开发出了自己的协议,并把它们开源了。但要想从一个“规范”升级为一个“标准”,下一步就是要让它摆脱单一厂商的控制,被大家广泛接受。只要一个协议还掌握在某一家手里,风险就始终存在。

Linux 基金会扮演的角色,就像一个值得信赖的“第三方公证人”。我们把不同的公司、组织和学术机构聚到一起,共同协作来制定一个标准。这能确保它的中立性,保证它持续开放、人人可用,并且有长久的生命力。如果一家公司打算投入资源去采纳某个规范,那么把它变成一个可信的标准,就能极大地降低这项投资的风险。

《新程序员》:具身智能,特别是人形机器人,在今年也进步神速,背后也有英伟达、AMD 等平台的支持。你认为开源社区和 PyTorch 在这个领域能扮演什么角色?

Matt White:这恰恰是我们大有可为的地方。这其中包含了机器人操作系统、行为模型、大脑模型、规划模型,以及编程和操作机器人或具身智能所需的各种工具。我们看到,这些模型持续不断地在使用 PyTorch 进行训练。

当然,根据具体实现方式的不同,还有很多别的机会。有些机器人会继续使用分类器、视觉或分割模型;而另一些则在用大型的“图像-行为”一体化模型。技术范式不止一种,但我们的目标始终是:提供并优化那些能让这一切成为现实的工具。同时,我们也鼓励大家将训练数据和最终模型开放共享。这就是我们扮演的角色。

《新程序员》:无论是法国站还是这次的中国站,PyTorch Day 的形式似乎都是安排十几位演讲者,每人 20 分钟。这种活动形式和讲者选择背后的考量是什么?

Matt White:对我们来说,办这个活动就是为了展示那些闪闪发光的开源项目和创新想法,同时让本土的工程师和研究者们能聚在一起,交流心得。我们也想借此机会,把社区的火种播撒得更广。几周前我们刚启动了“PyTorch 大使”计划,就是希望找到更多有热情的人,去点燃他们所在地的社区。

AI 是一场席卷全球的浪潮。我们今年挑选了几个我们认为能真正有所作为、能把大家凝聚起来的地方。而 20 分钟的分享,能让我们邀请到形形色色的人,来聊各种不同的项目、领域和经验。我们希望,这桌精心准备的“技术盛宴”,能让每个人都吃得开心。

《新程序员》:今年我们看到了很多生成式 AI 工具,比如 Cursor、Windsurf 这样的编码助手,还有各种内容生成工具。你认为企业在拥抱这些技术时,最大的机会在哪?最需要警惕的陷阱又是什么?

Matt White:当下最重要的一点,是要有人在旁边盯着(human in the loop)。

像 Windsurf 和 Cursor 这些工具,开发者用它们生成代码片段、辅助调试,但整个过程依然是在人的监督下完成的。你不会把开发一个网站的任务,完全甩手给一个智能体。万一它产生幻觉(hallucinated)了,开发者还能及时发现并修正。

另一个关键点,是我们需要一场关于“如何与这些工具协作”的全面教育。从底层的 GPU、Triton,到上层的 PyTorch、大语言模型,再到应用框架,无论你身处技术栈的哪一层,都要思考:根据我的工作和我需要解决的问题,我该如何驾驭这些新技术?

最后我想说,很多时候,最好的 AI 恰恰是那些你看不见的。比如 Adobe 的 Photoshop,里面有很多 AI 功能,但你根本不需要懂 AI 就能用它。一项技术最好的应用方式,往往是“润物细无声”的,它不会强迫用户去学习一套全新的技能。

《新程序员》:这次 PyTorch Day China 正好选在了 6 月 7 日,这是万千中国学子生命最重要的一天——高考。恰逢 PyTorch 基金会计划推出培训和认证项目,我想问问你,在 2025 年这个 AI 技术飞速演进的年份,比如氛围编码(Vibe Coding)的兴起和对 AI 智能体这类复杂系统技能的需求,未来几年 AI 从业者需要具备哪些核心能力?

Matt White:首先,也是最要紧的,是教育者们自己得先弄明白,怎么在这个 AI 时代里工作。这是我们必须开始的地方。但现在,很多老师并不知道怎么利用 AI 来为自己服务,有些人甚至把它看作一个麻烦,或者学生作弊的工具。

我们需要搞清楚,怎样才能在不剥夺学生核心能力培养的前提下,善用 AI。就像计算器的出现,并没有让学生学不好数学一样。工具可以帮我们处理一些重复性的工作,让我们能把精力集中在其他更重要的事情上。

所以,首先是“授人以渔”的老师要先学会,然后才能提供好的材料,让学生们学会如何与这些系统共事。这件事是多层面的。你是要成为 AI 工具的使用者,还是要成为研究者或创造者?在这个生态里,你可以扮演的角色非常多。

《新程序员》:在这个变革的时代,你最想对全球 AI 社区的开发者、研究者、学生和政策制定者传达的核心信息是什么?

Matt White:我想说,去拥抱 AI 带来的可能性吧。特别是生成式 AI,它能极大地增强我们的能力,让工作变得更轻松,把我们从繁琐的事务中解放出来,去专注于更有创造力和想象力的事情。

我的感觉是,如果你想看到经济发展,就应该投资开源和开放标准。同时,在监管层面要把握好一个度,既要防范风险,又要给创新和研究留足呼吸的空间。如果管得太死,最终受苦的还是我们每一个人。

《新程序员》:在你看来,当前 AI 领域最被忽视的问题是什么?

Matt White:我认为是“数字内容的真实性”危机。

一段视频到底是 AI 生成的还是真实拍摄的?你怎么去验证?像 C2PA 这样的技术提供了一种“数字水印”方案,但我们需要更宏观地看待这个问题。在社交媒体上,你可以自愿给 AI 生成的内容打上标签,但如果不打呢?它会不会让人们信以为真?这才是我们最需要警惕的地方。

我觉得我们不必担心“天网”(Skynet)降临,不必担心 AI 会统治世界,或者机器人会联合起来攻击我们。真正的危险,是眼下正在发生的事:合成的图像和视频,已经快要到以假乱真的地步了。我们该如何应对?

《新程序员》:这和“负责任的 AI”有关。深度学习三巨头之一的 Yoshua Bengio 近日在北京的演讲中也强调了这一点——他已经围绕这个话题在全球做了不少演讲了。但你似乎指出了一个更迫在眉睫的问题。

Matt White:没错。其实还有一个更近在眼前的危险,我觉得大家可能忽视了。在一个假消息泛滥的时代,我们必须反思:如何保护我们自己,不被今天的技术滥用所伤害?

(文:AI科技大本营)