在 AI 领域,如何高效地从复杂的视觉文档中检索并理解信息,一直是个难题。

传统的文本检索系统在遇到包含图片、表格、图表、复杂布局的文档时,往往力不从心。

而即使是 RAG(Retrieval-Augmented Generation)技术,在处理多模态文档时,仍然面临信息关联性不足、推理能力有限 等挑战。

今天为大家分享一款开源的专注于视觉文档的RAG系统:ViDoRAG,由阿里巴巴通义实验室联合中科大、上海交大推出的。

以 多模态混合检索 和 多智能体迭代推理 两大黑科技,重新定义了视觉文档处理的新范式,让AI像人类一样“看懂”图文,并给出精准答案!

在 GPT-4o 上,ViDoRAG 的准确率达到了 79.4%,比传统 RAG 提高了 10% 以上,在多模态信息提取、复杂文档问答等方面展现了极大的潜力。

背景环境

随着视觉文档的广泛应用,传统的RAG方法在处理这类数据时暴露出了明显短板。

首先,在检索阶段,现有方法往往难以有效整合文本和视觉特征,导致检索结果不够精准;其次,在生成阶段,模型的推理能力不足,难以应对复杂的问答需求。

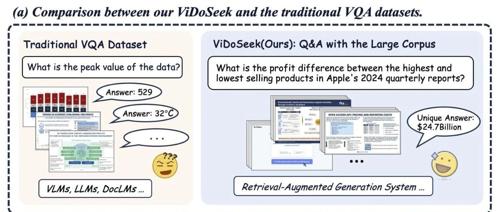

此外,现有数据集多聚焦于单张图片或单个文档的问答任务,缺乏对大规模文档集合下检索与推理能力的全面评估,这进一步限制了技术进步。

为了突破这些瓶颈,通义实验室提出了 ViDoRAG 框架,并配套推出了 ViDoSeek 数据集。这一组合不仅解决了视觉文档处理中的核心难题,还为相关研究提供了高质量的评估基准,推动了视觉文档问答领域的发展。

ViDoRAG 介绍

ViDoRAG 主要由 多模态检索 和 多智能体推理 两大核心组件构成,目标是优化从视觉文档集合中检索关键信息,并通过类人思维方式生成准确答案。

同时,团队还推出了 ViDoSeek 数据集,这是一个专门针对大规模视觉文档集合检索和复杂推理设计的高难度基准数据集。

该数据集包含 1200+ 真实问题,涵盖文本、图表、表格、布局等多种内容类型,使模型不仅要检索信息,还要进行跨文档推理和整合。

核心功能

1、多模态混合检索(GMM 模型)

-

• 结合视觉与文本特征,通过 高斯混合模型(GMM) 自适应调整检索策略,使得模型能够更精准地获取关键信息。 -

• 解决了传统 RAG 框架在处理视觉文档时的模态割裂问题,提高了检索的精准度和效率。

2、多智能体迭代推理

-

• 探索者(Seeker): 选择相关图片,初步筛选文档信息。 -

• 检查员(Inspector): 细化筛选结果,评估信息质量,并生成初步答案。 -

• 回答者(Answerer): 验证答案的准确性,并优化最终输出。

3、动态检索策略

通过 GMM 调控文档数量,在保证高质量检索结果的同时,减少不必要的计算开销,提高系统效率。

4、强大的 ViDoSeek 数据集

-

• 涵盖单跳和多跳推理任务,要求 AI 具备跨文档理解能力。 -

• 真实模拟大规模文档查询场景,全面考察 RAG 框架的检索、推理和生成能力。

实验结果

ViDoRAG 在多个任务上的表现远超传统 RAG 方法:

-

• 在 GPT-4o 评测中,ViDoRAG 准确率达到 79.4%,比传统方法提升 10% 以上。 -

• 多模态混合检索策略显著降低了错误检索率,提高了推理阶段的答案质量。 -

• 在大型文档集合中,ViDoRAG 的动态检索策略减少了 30% 计算成本,同时保证了信息召回率。

写在最后

ViDoRAG 的推出标志着视觉文档检索增强生成技术迈向新阶段。

它通过多模态混合检索和多智能体迭代推理,不仅解决了传统RAG方法的局限,还显著提升了模型在复杂视觉文档上的处理能力。

配套的ViDoSeek数据集则为相关研究提供了宝贵的评估基准。未来,通义实验室计划进一步优化系统效率、减少模型幻觉,提升响应速度和可扩展性。

如果你对视觉文档处理、自然语言处理或RAG技术感兴趣,不妨关注这个开源项目,亲自体验它的强大功能。

GitHub 项目地址:https://github.com/Alibaba-NLP/ViDoRAG

● 一款改变你视频下载体验的神器:MediaGo

● 新一代开源语音库CoQui TTS冲到了GitHub 20.5k Star

● 最新最全 VSCODE 插件推荐(2023版)

● Star 50.3k!超棒的国产远程桌面开源应用火了!

● 超牛的AI物理引擎项目,刚开源不到一天,就飙升到超9K Star!突破物理仿真极限!

(文:开源星探)